Total vernetzt

Bei allem, was ich Ihnen bisher in diesem Buch erzählt habe, habe ich ein riesiges Themenfeld sträflich ausgelassen. Dass Computer miteinander vernetzt sein können, war allenfalls bei den Smartphones ein Thema. Dabei wäre vieles, was wir heute mit Computern machen, ohne Vernetzung und vor allem ohne das “Netz der Netze” gar nicht mehr denkbar. Das Internet ist allgegenwärtig: Viele von uns sind ständig online - oft sogar mit mehreren Geräten gleichzeitig. Diese Allgegenwärtigkeit wird oft als Revolution empfunden, denn das Internet verändert viele Medien, die es seit Jahrzehnten oder gar Jahrhunderten gibt. Tageszeitungen und Zeitschriften haben seit Jahren zu kämpfen und auch das klassische lineare Fernsehen und das Radio bekommen es immer stärker zu spüren.

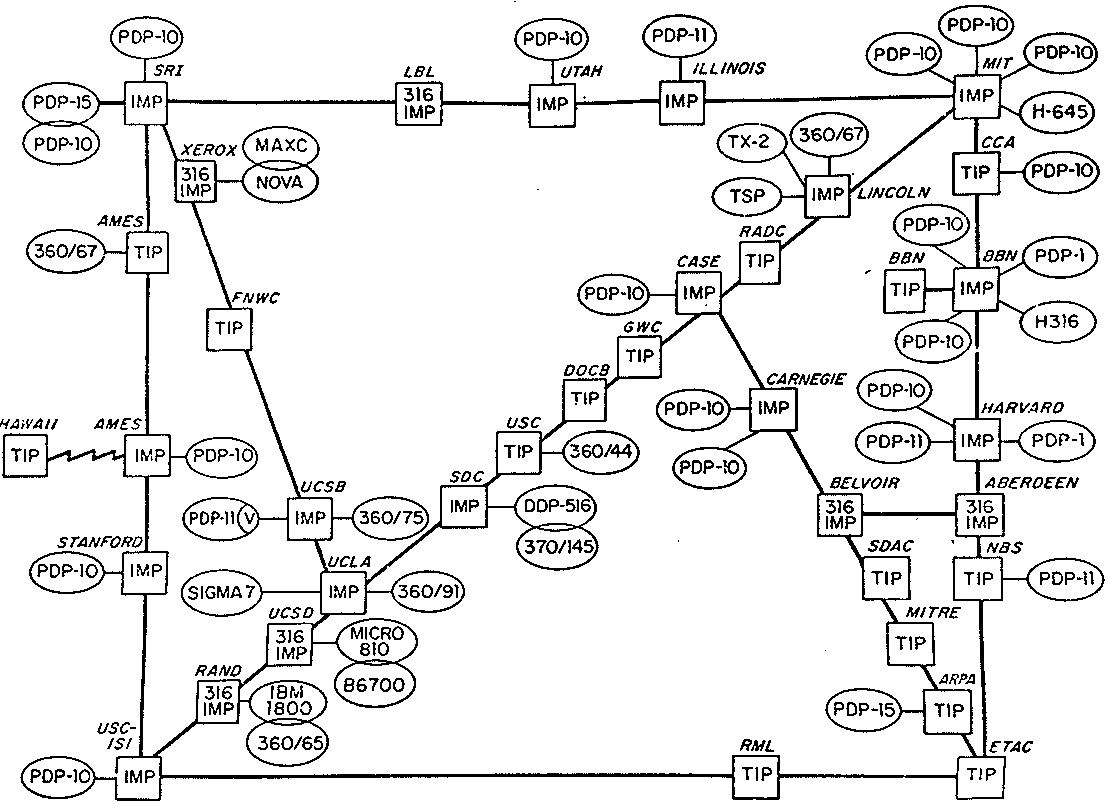

Je nach Alter erinnern Sie sich vielleicht noch an eine Zeit “vor dem Internet” oder Sie kennen Menschen, die Ihnen davon erzählen. Um welche Zeit handelt es sich dabei eigentlich? Seit wann gibt es das Internet? Die Beantwortung dieser Frage ist letztlich eine Frage der Definition. Im Jahr 1969 nahm das von der Advanced Research Projects Agency (ARPA), einer Abteilung des US-Verteidigungsministeriums, finanzierte und betriebene ARPAnet seinen Betrieb auf. Dieses Netz gilt als Keimzelle des späteren Internet. Die Verbindung zum Verteidigungsministerium erklärt sicherlich den Mythos, das Internet sei als atomkriegssicheres Computernetz für das Militär geplant worden. Zwar gab es durchaus Überlegungen zu einer ausfallsicheren Netzwerktechnik für das Militär, aber mit dem Internet und seinen Vorläufern hat das wenig zu tun. Auf der Karte sieht man das Layout des Netzes im Jahr 1973. Wenn man sich anschaut, was in den mit IMP oder TIP beschrifteten Rechtecken steht, sieht man, dass es sich nicht um militärische Einrichtungen handelt, sondern um Universitäten und andere Forschungseinrichtungen. Die ARPA hat sie über ihr Netzwerk miteinander verbunden. Sicherlich erhoffte man sich davon auch einen Innovationsschub in Forschungsbereichen, die eigentlich dem Militär vorbehalten waren, aber das Netzwerk beschränkte sich nicht darauf.

Der Zweck des ARPnet war es, den Zugriff auf die Großrechenanlagen der Forschungseinrichtungen zu ermöglichen und somit Ressourcen gemeinsam zu nutzen. Sich aus der Ferne mit einer Rechenanlage zu verbinden, war im Prinzip nichts Neues. Im Kapitel über Timesharing haben Sie bereits davon gelesen. Beim Timesharing wurden Fernschreiber und andere Terminals mit einem Zentralrechner verbunden. Dies konnte über ein direktes Kabel oder über eine Telefonleitung und ein Modem erfolgen. Beim Timesharing befindet sich auf der einen Seite der Verbindung ein Computer, auf der anderen Seite ein Terminal oder ein Fernschreiber. Mit der gleichen Technik können natürlich auch zwei Computer untereinander Daten austauschen.

Datenübertragung per Modem

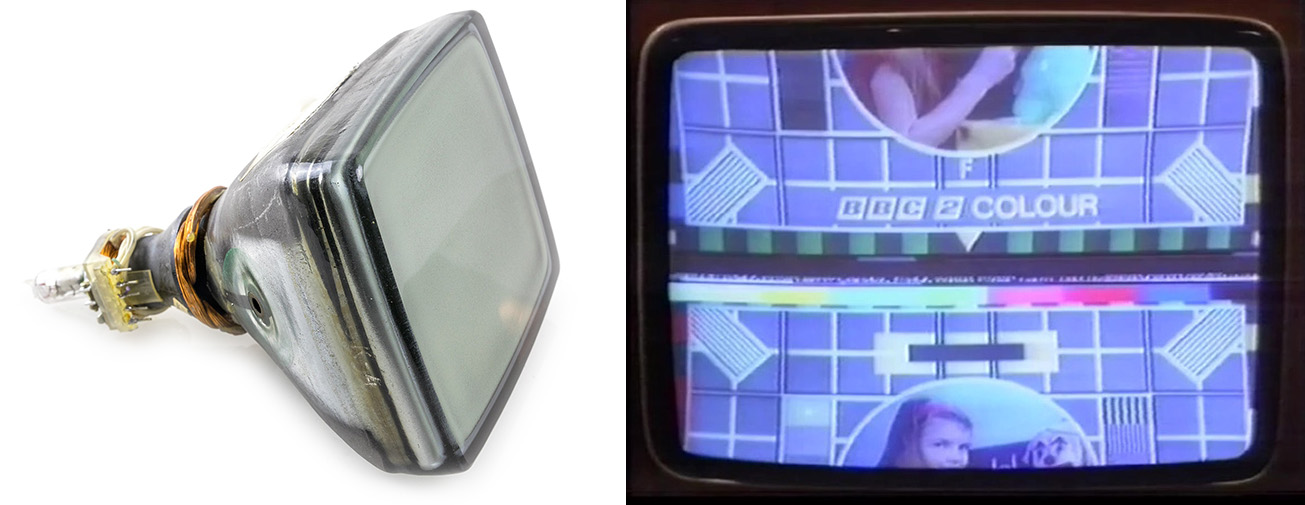

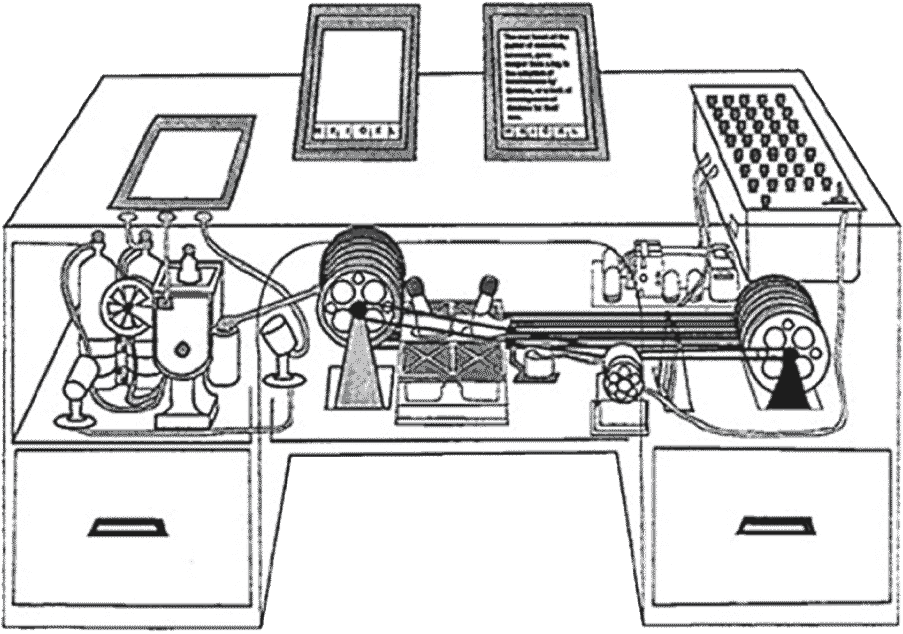

Der Begriff Modem wird Ihnen in diesem Kapitel noch öfter begegnen. Lassen Sie mich also kurz vorab erklären, was das eigentlich ist. Modems werden gebraucht, wenn man zwischen Computern Daten austauschen möchte, dafür aber eine Leitung verwenden muss, die sich für binäre Datenübertragung – Strom an oder Strom aus – nicht eignet. Modems wandeln die digitalen Daten des Computers in hörbare Töne um1, die per Telefonleitung übertragen werden. Auf der anderen Seite der Verbindung befindet sich ebenfalls ein an einen Computer angeschlossenes Modem. Dort werden die Töne, die für den Menschen nur ein unangenehmes Kreischen darstellen, wieder in digitale Daten umgewandelt, die der Computer verarbeiten kann. Oben sehen Sie einen Akustik-Koppler, ein einfaches Modem für die Übertragung von Computerdaten über eine Telefonleitung. Auch bei so einem Akustik-Koppler werden die digitalen Daten des Computers in hörbare Töne umgewandelt. Ein Computernutzer, der Daten übertragen will, hebt den Hörer ab und wählt die Nummer einer Gegenstelle, die mit einem Computer verbunden ist. Kommt die Verbindung zustande, legt er den Hörer in den Akustik-Koppler. Der Vorteil von Akustik-Kopplern ist, dass man nichts an der Verkabelung des Telefonanschlusses ändern muss, sondern sein normales Telefon verwenden kann. Es gibt aber zwei Nachteile: Zum einen ist das Ganze etwas umständlich, weil man händisch wählen muss. Vor allem aber stören Geräusche aus der Umgebung die Übertragung. Professionellere Modems wurden unter Umgehung des häuslichen Telefons direkt an die Telefonleitung angeschlossen, was sowohl praktischer ist als auch schnellere Verbindungen ermöglicht.

Pakete im Netz

Ruft man einen entfernten Computer mittels Modem an, besteht eine dauerhafte Verbindung. Ein großflächiges Computernetz kann man auf diese Art und Weise aber nicht gut aufbauen, denn so viel Kapazität, um alle Rechner mit allen anderen dauerhaft zu verbinden, hat auch das beste Telefonnetz nicht. Es wäre auch absolute Verschwendung, denn mit den allermeisten Netzwerkteilnehmern möchte man ja nicht dauerhaft Daten austauschen. Eine andere Lösung muss her.

Die Idee hinter dem Internet beruht darauf, dass einzelne Computer nicht mit allen anderen, sondern immer nur mit einigen wenigen verbunden sind, die dann wiederum mit anderen verbunden sind und so weiter. Hinzu kommt die sogenannte Paketvermittlung. Sie können sich beides mit einer Analogie erklären, denn das Internet funktioniert weniger so wie das klassische Telefonnetz, sondern ist eher mit der Paketpost vergleichbar. Stellen Sie sich vor, Sie besitzen einen Oldtimer. Diesen wollen Sie mit der Post an einen Freund verschicken. Das ganze Auto verschickt die Post aber nicht. Es ist viel zu groß. Sie nehmen das Auto also kurzerhand auseinander, packen die Einzelteile in Pakete, legen jeweils einen Zettel mit dazu, wie die Teile wieder zusammenzusetzen sind, und bringen die einzelnen Pakete zur Post. Die Pakete werden nun von der Post nicht direkt zum Zielpostamt gebracht. Dann müssten ja zwischen allen Postämtern ständig Transporter hin und her fahren. Das wäre nicht effizient. Das lokale Postamt schickt ein Paket stattdessen an ein Verteilzentrum. Dieses schickt das Paket entsprechend der Zieladresse an ein anderes Verteilzentrum weiter. Je nach Entfernung wiederholt sich der Vorgang einige Male. Da Sie ja mehrere Pakete verschicken, könnte es durchaus sein, dass das eine Paket eine bestimmte Route nimmt, ein anderes Paket aber auf einem anderen Weg ankommt. Letztlich ist der Weg, den die Pakete genommen haben, aber ganz egal. Wichtig ist, dass alle Pakete am Ziel ankommen und das Auto am Zielort wieder zusammengesetzt werden kann.

Ganz vergleichbar funktioniert auch das Internet. Wenn Sie eine Datei auf einen Server hochladen, dann wird sie in viele kleine Teile zerlegt. Diese werden dann über ein Geflecht von Verteilerrechnern, den sogenannten Switches, bis zum Ziel geschickt und dort wieder zusammengesetzt.

Natürlich konnte nicht nur die ARPA Netze betreiben, die auf diese Art und Weise funktionierten. 1981 nahm die National Science Foundation (NSF) das Computer Science Network in Betrieb. 1986 kam dann das allgemeinere NSFNet dazu. Durch die Verbindung der Netze der NSF mit dem ARPAnet und dem Anschluss internationaler Netze an das NSFNet entstand ein Netz, das die Netze verband, ein Zwischen-Netz, ein Inter-Net. Dieser Begriff wurde Mitte bis Ende der 1980er Jahre immer gebräuchlicher. Das Internet ist also fast 40 Jahre alt oder, je nach Sichtweise, auch schon über 50 wenn man das ARPAnet als Anfang nimmt. Es kommt ganz darauf an, was man als den Anfang ansehen möchte.

Sprechen die Leute, die von der Zeit vor dem Internet sprechen, also von den 1960er oder 1970er Jahren? Möglich ist das natürlich, aber auch viel spätere Zeitpunkte können durchaus gemeint sein, denn das Internet und die Netze, aus denen es hervorgegangen ist, waren bis in die 1990er Jahre hinein der breiten Öffentlichkeit und auch in der Privatwirtschaft gar nicht bekannt. In einem Bericht des ARD-Magazins Panorama von 1987 über die Tätigkeiten deutscher Hacker des Chaos Computer Club[s] ist nur allgemein von einem “Internationalen Netzwerk” die Rede. Der Begriff “Internet” hätte wohl keinem etwas gesagt. Ein Bericht des ZDF Morgenmagazins aus dem Jahr 1996 behandelt die Frage “Was ist denn Internet überhaupt?”. Von NBCs Today Show aus Amerika gab es 1995 aus heutiger Sicht Kurioses zu sehen: Der Moderator der Sendung weiß nicht, wie man das a mit dem Kringel drumherum nennt und lässt sich zur verzweifelten Frage “What is Internet anyway?” hinreißen. Seine Kolleginnen und Kollegen können ihm auch nicht so recht weiterhelfen. Erst ein Assistent aus dem Off meint zu wissen, dass es sich um ein “Computer Billboard” handelt, also um ein computerisiertes Schwarzes Brett. Wenn Leute also von “vor dem Internet” sprechen, dann kann das durchaus auch die 1980er und die erste Hälfte der 1990er Jahre einschließen. Kaum jemand, der nicht an einer Universität oder Forschungseinrichtung damit zu tun hatte, kannte damals das Internet und auch für diese Leute hatte es keine so dominante Rolle wie heute.

Die spannende Geschichte des Internet umfangreich und vollständig zu erzählen, schaffe ich hier natürlich nicht. Ich empfehle Ihnen sehr, wenn es Sie interessiert, sich das Buch “ARPA Kadabra”2 zu besorgen. Darin erfahren Sie alle technischen und nicht technischen Hintergründe und lernen die Protagonisten hinter der Entwicklung kennen. In diesem Buch fokussiere ich mich, was das Internet angeht, auf eine eher späte, aber sehr dominante Entwicklung, mit der das Netz öffentliche Wahrnehmung bekam – dem World Wide Web. Doch bevor wir dort hinkommen, gilt es, andere Vernetzungsprojekte zu betrachten, denn auch “vor dem Internet”, in den späten 1970er Jahren und in den 1980ern, konnte man bereits online gehen und einige dieser frühen Online-Dienste hatten sogar eine Nutzerschaft, deren Zahl in die Millionen ging.

Bildschirmtexte und Online-Dienste

Lassen Sie uns eine Zeitreise ins Jahr 1985 machen! Nicht politisch, nicht modisch, sondern in Sachen Computern und Kommunikationstechnik. Grundsätzlich hat sich natürlich technisch in allen Bereichen seit 1985 viel getan. Dennoch hätten wir bei unserer Zeitreise wahrscheinlich keine Probleme. Lassen wir mal die Computer beiseite, war das meiste nicht so sehr anders als heute. Genau wie heute gab es Autos und die hatten auch schon ein Lenkrad, ein Zündschloss und drei Pedale. Auch Züge und Flugzeuge gab es natürlich schon. Die Flugzeuge und Züge von 1985 funktionierten im Prinzip genauso wie heute und könnten durchaus auch heute noch betrieben werden. Das gleiche gilt auch für ein Radio oder einen Kugelschreiber. Mit all diesen Dingen hätten wir bei unserer Zeitreise kaum Probleme. Selbst mit einem Fernseher der damaligen Zeit kämen wir wahrscheinlich zurecht, obwohl es sich damals um recht wuchtige Geräte mit erstaunlich kleinem Bild handelte, die meisten Leute nur drei Programme empfangen konnten und viele Fernseher noch keine Fernbedienung hatten. Wo wir durchaus umdenken müssten, wäre der Bereich Telekommunikation. Dass man nicht whatsappen konnte, haben Sie sich wahrscheinlich schon gedacht. Smartphones gab es natürlich noch nicht. Darüber haben wir ja schon gesprochen. Das erste Mobiltelefonnetz für die größere Allgemeinheit, das analoge C-Netz, gab es erst ab 1986. Wenn wir also jemanden von unterwegs erreichen wollten, dann mussten wir uns eine Telefonzelle suchen. Die waren damals postgelb und standen an jeder Ecke. Das C-Netz wurde, genauso wie das “öffentliche Fernsprechnetz” – heute sagt man Festnetz dazu – und die Telefonzellen, von der Post betrieben.

Als jüngerer Leser mögen Sie jetzt stutzen. Was hat denn die Post mit Telefon und Mobilfunk zu tun? Heute nichts mehr, im Jahr 1985 jedoch sehr viel. Die Post hieß damals noch Bundespost. Das klingt nicht nur sehr offiziell, das war es auch. Es handelte sich um eine Bundesbehörde. Alles was mit der Post zu tun hatte, war also eine hoheitliche Angelegenheit. Die Briefträger und Paketzusteller der Bundespost waren Postbeamte und wollte man ein Paket aufgeben, tat man das nicht in irgendeiner Geschäftsstelle, sondern in einem Postamt. Den Paket-, Päckchen- und Briefdienst der Bundespost kennen Sie heute unter dem Namen Deutsche Post und zum Teil unter dem Namen DHL. Die Bundespost hatte aber viele weitere Aufgaben als das Verschicken von Briefen, Päckchen und Paketen. Zur bereits vorgestellten, sogenannten “gelben Post” kamen die sogenannte “blaue Post” – die Postbank – und die “graue Post”, die die Dienste für die elektronische Kommunikation vereinigte. Hierzu gehörte das genannte “öffentliche Fernsprechnetz”, ein Netz für Fernschreiber, Telex genannt, aber auch alle nennenswerten Rundfunk- und Fernsehsender. Sicher kennen Sie auch bei sich in der Gegend einen Rundfunk- und Fernsehturm3 oder eine große Antenne auf einer Anhöhe. Wenn Sie in Westdeutschland wohnen, wurde dieser Turm wahrscheinlich von der Bundespost errichtet und betrieben.

1995 wurde die Deutsche Bundespost privatisiert und in drei Aktiengesellschaften (Deutsche Post AG, Postbank AG und Deutsche Telekom AG) aufgespalten. Daran hat man 1985 aber noch nicht gedacht. Noch war Kommunikation in allen Bereichen eine staatliche Angelegenheit, denn die Bundespost hatte ein staatliches Monopol. Im Bereich der Briefe mag das nicht so einen großen Unterschied gemacht haben, aber in der Welt der Telekommunikation hatte dieses Monopol für die heutige Zeit eigenartige Konsequenzen. Das Telefon in meiner Familie, zum Beispiel, war im Jahr 1985 eines mit Wählscheibe4. Es stand im Flur auf einem kleinen Tischchen. Das Kabel des Telefons ging direkt in eine Dose an der Wand. Es gab keinen Stecker und auch keine Buchse. Man konnte das Telefon also nicht einfach austauschen oder außer Betrieb nehmen. Das war nicht nur schwer möglich, es war sogar verboten. Die Fernmeldeordnung bestimmte klar: “Der Teilnehmer darf die Teilnehmereinrichtungen nicht eigenmächtig ändern; unzulässig ist auch das eigenmächtige Einschalten selbstbeschaffter Apparate.” Unser Telefon war also natürlich kein selbstbeschaffter Apparat. Wie fast alle hatten wir es bei der Post gemietet und eigenmächtig haben wir es auch nicht angeschlossen. Ein Techniker der Bundespost hat dies getan.

Ähnlich wie in Deutschland war es überall in Westeuropa. In Österreich gab es die Österreichische Post- und Telegraphenverwaltung, in den Niederlanden die PTT (Staatsbedrijf der Posterijen, Telegrafie en Telefonie). In Frankreich hieß das staatliche Unternehmen DGT (Direction Générale des Télécommunications). Die Telekommunikation in Europa Mitte der 1980er Jahre war also geprägt durch ihre zentralisierte Struktur, betrieben durch meist staatliche Post- und Telekommunikationsunternehmen, die in ihrem Markt ein Monopol hatten. Das konnte ein Vorteil sein, konnte aber auch zum Nachteil werden. Beides werden wir sehen, wenn wir uns die europäischen “Vorgänger des Internets” ansehen. Der Beginn zu dieser Technik - der Videotext – lag in England und hatte erstmal gar nichts mit der Post oder mit Telefonleitungen zu tun.

Begriffsverwirrungen: Was in Deutschland vor allem von ARD und ZDF Videotext genannt wird, wird im internationalen Rahmen meist Teletext genannt. Videotex (ohne t) hingegen ist die internationale Bezeichnung für Dienste wie der deutsche Bildschirmtext, den ich Ihnen weiter hinten vorstelle. Um die Verwirrung komplett zu machen, gab es in Deutschland auch noch Teletex (ohne t) als modernere Variante des Fernschreibdienstes, der seinerseits Telex genannt wurde. Um es mir und Ihnen ein bisschen einfacher zu machen, verwende ich durchgehend die deutschen Begriffe Videotext und Bildschirmtext auch für die anderen europäischen Informationsdienste.

Eine Lücke geschickt ausgenutzt: Der Videotext

Techniker der BBC ersannen in den 70er Jahren eine Technik, um gleichzeitig mit dem Fernsehprogramm, quasi Huckepack im gleichen Sendesignal, textuelle Informationen auszuliefern. Der Dienst Ceefax (für “see facts”) ging dort bereits 1974 in den Regelbetrieb. Die private Konkurrenz ging wenig später an den Start und hieß Oracle. In Deutschland dauerte es etwas länger. Hier war man 1980 soweit.

Um es zu bewerkstelligen, neben dem normalen Fernsehbild und dem Ton auch noch ein textuelles Informationsprogramm auszuliefern, nutzte man eine Eigenschaft des Bildsignals aus, das seinerseits aufgrund einer technischen Notwendigkeit bestand. Um das Prinzip zu verstehen, muss man sich klarmachen, wie ein altes analoges Fernsehsignal an einem alten Röhrenfernseher dargestellt wird.

So ein Fernseher verwendet eine Kathodenstrahlröhre, um ein Bild anzuzeigen. Meist wird sie der Einfachheit halber Bildröhre genannt. Im hinteren Teil der Bildröhre, da wo sie ganz dünn wird, wird ein Elektronenstrahl erzeugt, der vorne auf dem eigentlichen Bildschirm auf eine Substanz trifft, die er zum Leuchten anregt. Mittels durch Spulen erzeugte Magnetfelder kann der Strahl umgelenkt werden, sodass verschiedene Bereiche des Bildschirms erreicht werden können. Damit man mit einer solchen Röhre ein flächiges Bild sieht, müssen alle Bereiche des Bildschirms von einem sehr kräftigen Elektronenstrahl regelmäßig getroffen werden. Dies geschieht beim Fernseher (und auch bei Computermonitoren) Zeile für Zeile von oben nach unten und von links nach rechts.

Stellen wir uns den Vorgang zur Verdeutlichung in einem Gedankenexperiment vor. Wir simulieren die Bilddarstellung eines Schwarz-Weiß-Fernsehers. Sie sind der Fernsehempfänger und ein Bekannter von Ihnen spielt den Fernsehsender. Er sendet Ihnen ein Bild, indem er eine Ihrer Hände ergreift und unterschiedlich stark zudrückt. In Ihrer anderen Hand halten Sie einen Stift mit einer breiten Spitze. Diesen Stift ziehen sie nun zeilenweise über ein Blatt Papier. Sie fangen in der ersten Zeile oben links an. Je stärker Sie den Stift auf das Papier drücken, desto dunkler wird es. Sie drücken immer genauso stark mit dem Stift auf das Papier, wie Ihr Bekannter Ihre Hand drückt. Dabei bewegen Sie den Stift gleichmäßig weiter. Wenn Sie am Ende einer Zeile angekommen sind, geht es in der nächsten Zeile weiter. Wenn das Blatt voll ist, haben Sie auf diese Weise ein komplettes Bild gezeichnet. Sie reißen das Blatt ab und fangen direkt oben wieder mit dem nächsten Bild an. Auf diese Art und Weise kann Ihnen ihr Bekannter eine Reihe von Bildern übertragen. Wenn das ganze schnell genug vonstatten ginge, entstünde dabei der Eindruck eines bewegten Bildes. Beim klassischen Fernsehen wurden so seinerzeit 25 Bilder in der Sekunde übertragen5.

Bilder können Sie auf diese Weise nun übertragen. Das Bild interessiert uns aber eigentlich gar nicht so sehr, denn es geht uns ja um den Text. Für den ist viel interessanter, was passiert, wenn gerade kein Bild übertragen wird. Das passiert bei unserem Gedankenexperiment, ohne dass ich es erwähnt hätte, ziemlich oft. Immer wenn eine Zeile voll ist, zum Beispiel, brauchen Sie ein klein bisschen Zeit, um den Stift an den Anfang der Folgezeile zu bewegen. Diese Zeitspanne ist nicht besonders lang. Länger dauert es dann schon, wenn ein ganzes Bild fertig ist. Sie müssen dann das fertige Bild abreißen und dann mit Ihrer Hand wieder nach oben links gehen. Während dieser Zeit können Sie kein Bild zeichnen. Man spricht beim Fernsehen hier von der vertikalen Austastlücke6. Ihr Bekannter hat in dieser Zeit aber ja immer noch Ihre Hand fest im Griff, kann Ihnen also etwas senden, Sie können damit aber nichts anfangen, denn Sie können es ja nicht zu Papier bringen. Diese Lücke, während derer kein Bild gezeichnet werden kann, macht man sich beim Videotext zu Nutze, indem man im Bildsignal digitale Daten unterbringt. Im Bild oben rechts wurde das Fernsehbild vertikal verschoben, sodass man die Austastlücke sieht. Die weiße, etwas unruhige Linie vor dem Beginn des Bildes ist das Ceefax-Signal der BBC.

Die Inhalte des Videotexts der BBC wurden von einer Redaktion beim Rundfunksender bereitgestellt. Typische Inhalte waren Nachrichten, Wetterberichte oder Sportergebnisse. Die Möglichkeiten der Darstellung waren der Technik der späten 1970er Jahre und Röhrenfernsehtechnik mit einer für heutige Verhältnisse niedrigen Auflösung entsprechend. Eine Seite bestand aus 24 Zeilen à 40 Zeichen. Ursprünglich standen nur acht Farben jeweils für Vordergrund und Hintergrund zur Verfügung. Bei diesen acht Farben handelt es sich um die Grundfarben und ihren Kombinationen, also Rot, Grün, Blau, Gelb, Cyan, Magenta, Schwarz und Weiß. Jede Seite verfügte über eine Nummer. Die nummerierten Seiten wurden vom Fernsehsender nach und nach ausgestrahlt. Man konnte an einem Fernseher mit Videotext-Decoder eine dreistellige Nummer eingeben und musste dann warten, bis die entsprechende Seite wieder gesendet wurde. Sie wurde dann dekodiert und angezeigt. Besonders wichtige Seiten, wie etwa die Übersichtsseite 100 oder Untertitel für das aktuell laufende Programm, wurden häufiger übertragen als andere, damit sie schneller aufgerufen werden konnten und häufiger aktualisiert wurden. Im Laufe der Jahre verbesserte sich die Videotext-Technik ein wenig. Mehr Farben wurden verfügbar und auch die Grafikfähigkeiten wurden etwas besser. Videotext behielt aber bis heute den Charme der 1970er und 1980er Jahre.

Trotz all seiner Einschränkungen kann man den Videotext in manchen Bereichen als altmodischen Vorgänger von Websites ansehen, denn man kann ihn ganz ähnlich nutzen. Statt im Web-Angebot der Tagesschau nach den aktuellen Nachrichten zu schauen, konnte man die entsprechende Videotextseite aufrufen und die Nachrichten lesen. Was beim Videotext aber natürlich gar nicht funktionieren kann, ist alles, was über die Seitenauswahl hinaus auf Eingaben des Nutzers basiert, denn einen Rückkanal gibt es ja nicht. Man könnte im Videotext also nie eine individuelle Fahrplanauskunft von Start- und Zielbahnhof realisieren. Es kann lediglich innerhalb der begrenzten Menge an Seiten, die übertragen wird, etwas ausgewählt werden. Diesen Nachteil kann man dadurch abschaffen, dass man das Übertragungsmedium ändert, also die Seiten nicht per Fernsehantenne, sondern z. B. per Telefonkabel ins Haus kommen lässt.

Prestel in Großbritannien

Genau das hat das UK Post Office Telecommunication, seit 1981 unter dem Namen “British Telecom”, getan und unter dem Namen “Prestel” ab 1979 angeboten. Prestel stand als Abkürzung für “press telephone”. In Sachen Darstellung hatte Prestel genau die gleichen Eigenschaften wie der Videotext. Seiten mit 24 Zeilen à 40 Zeichen konnten in acht Farben dargestellt werden. Über die Telefonleitung gab es nun aber einen Rückkanal, sodass ein Computer der British Telecom auf der anderen Seite Eingaben verarbeiten und entsprechend antworten konnte. Diese Antwort musste nicht immer eine komplette neue Seite sein. Viewdata, wie der Videotext- und Prestel-Standard betitelt wurde, verfügte über Cursor-Control-Character. Dadurch konnte durch Signale vom Postcomputer die angezeigte Seite in Teilen aktualisiert werden, ohne sie komplett neu laden zu müssen. Hiermit wurden sogar simple Animationen möglich. Was spannend klingt, war in der Praxis wohl ziemlich langweilig. Wirklich interaktive Dienste blieben die Ausnahme. Größtenteils bestand der Prestel-Dienst aus Seiten, die ganz ähnlich wie der Videotext mit einer Nummer aufgerufen wurden. Auf den Seiten gab es dann Verweise auf Unterseiten, die über ein Nummernpad aufgerufen werden konnten. Im Prinzip bot Prestel damit nicht viel mehr als das, was es schon im Videotext gab – allerdings mit einer größeren Ausrichtung auf geschäftliche Daten, wie etwa Aktienkursen. Ab 1983 kam das Feature hinzu, anderen Teilnehmern Nachrichten schicken zu können.

Wenn man der Darstellung von History Today glauben kann, kostete der günstigste Prestel-taugliche Fernseher im Jahr 1985 650 Britische Pfund. Umgerechnet auf das Jahr 2020 sind das 2320 Euro. Hinzu kamen Kosten von etwa 6 Euro pro Monat, tagsüber zusätzlich 6 Cent pro Minute zusätzlich zu den Telefonkosten und ggf. Sonderkosten für einzelne Seiten. Im Vergleich zum Btx in Deutschland, das ich Ihnen etwas später vorstellen will, war das gar nicht so viel, aber im Vergleich zum Videotext, der zwar einen etwas teureren Fernseher brauchte, aber ansonsten kostenfrei war, war Prestel ziemlich teuer. Ein Erfolg war der Dienst nicht. Über 90.000 Teilnehmer kam er nie hinaus.

Minitel/Télétel in Frankreich

Der Prestel-Dienst bot einer allgemeinen Öffentlichkeit im Prinzip die Möglichkeit, Computerdienste ohne größere Hürden zu nutzen. Besonders populär wurde der Dienst aber auf Grund des langweiligen Angebots nicht. Ganz anders sah das in Frankreich aus, und dass das so war, lag an Entscheidungen des französischen Staats in Form des staatlichen Kommunikationsunternehmens DGT (Direction Générale des Télécommunications).

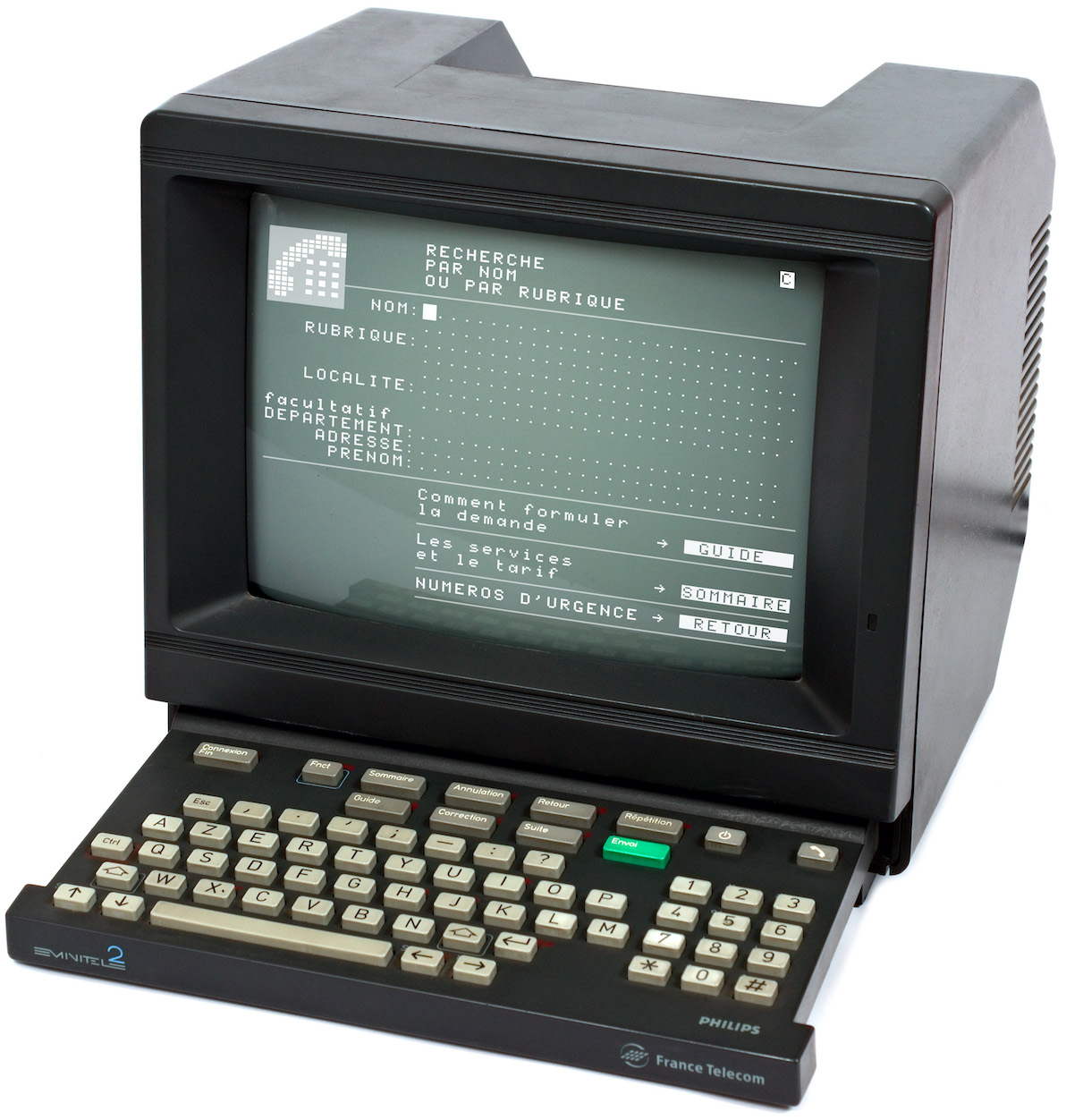

Zu Beginn der 1980er Jahre befand der französische Staat die Kommunikationsinfrastruktur des Landes für veraltet. Dies galt es zu ändern. Ein modernes Telefonnetz sollte aufgebaut werden. Teil dieses Netzes sollte ein Bildschirmtextdienst mit dem Namen Télétel werden. Technisch orientierte sich die DGT am englischen Viewdata-Standard, den sie leicht verbesserte. Maßgeblich für den späteren großen Erfolg des Dienstes waren aber nicht diese technischen Verbesserungen, sondern die Entscheidung, jedem Teilnehmer ein kleines Zugangsgerät kostenfrei zur Verfügung zu stellen. Wenn man in Frankreich einen Telefonanschluss hatte, konnte man sich fortan entscheiden, ob man ein normales Telefonbuch oder ein solches Minitel haben wollte, mit dem sich Telefonnummern natürlich viel praktischer herausfinden ließen. Und das beste: Das Ganze war sogar kostenfrei! Durch diesen Trick brachte die DGT ihr Télétel in viele Haushalte. Da der Dienst so sehr mit den Zugangsgeräten, den Minitels, verbunden wurde, wurde der Begriff Minitel im Volksmund und auch in der Werbung zum Namen für den Dienst als Ganzes. “Faites-le en Minitel!” war die Devise! 1985 hatte der Dienst bereits 2 Millionen Nutzer. Anfang der 1990er waren es 6,5 Millionen und im Jahr 2000 erreichte der Dienst mit 25 Millionen Nutzern sein Maximum. Bei 55 Millionen Einwohnern sind dies mehr als beeindruckende Zahlen.

Auch wenn die Technik für die Datenübertragung und Darstellung dem britischen Prestel sehr ähnlich war, gab es in der praktischen Anwendung doch starke Unterschiede. Das britische System war in seinen Grundzügen zentralistisch. Der große Teil der Inhalte war auf Rechnern der British Telecom abgelegt. Mittels eines sogenannten Suchbaums navigierte man durch diese Seiten. Vereinzelt gab es Computer externer Dienstleister, die über das System erreichbar waren, etwa für Fahrkartenbuchungen und Online-Banking, aber das war eher die Ausnahme. In Frankreich hingegen waren externe Dienstleister der Normalfall. Die DGT bot zwar auch ein paar eigene Dienste an, war aber ansonsten größtenteils lediglich Vermittler.

Télétel konnte über verschiedene Einwahlnummern erreicht werden, die für den Nutzer mit verschiedenen Kosten verbunden waren. Die Preise in der folgenden Aufstellung entstammen dem Gebührenkatalog von 1994.

- Unter 3611 erreichte man das Telefonbuch. Drei Minuten konnte man diesen Dienst kostenfrei nutzen, was für die allermeisten Nummernrecherchen sicher ausgereicht hat. Wenn nicht, konnte man einfach auflegen, sich neu einwählen und bekam wieder drei freie Minuten.

- Für die Services auf 3613 mussten von Kundenseite nur die normalen Telefonkosten aufgebracht werden. Diese beliefen sich auf 7,80 Francs pro Stunde (heute etwa 2,10 Euro). Die Kosten für den Télétel-Dienst selbst trug hier der Anbieter.

- Bei 3614 war es umgekehrt. Hier zahlte der Anbieter nichts, aber der Kunde musste 21,90 Francs pro Stunde aufbringen (entsprechend 6,40 Euro).

Ab 1984 wurden diese Zugangsnummern um die “Kiosque”-Dienste erweitert. Dieser Name kam nicht ganz von ungefähr. Unter der zunächst eingeführten 3615 sollten zunächst nur Presseangebote zu finden sein. Schnell kamen auch andere Anbieter dazu – teils auf 3615, andere dann auf 3616 oder 3617. Wählte man sich hier ein, wurde man nach einer Kennung für den Dienst, den “code du service” gefragt. Dieser Code war bei Télétel in der Regel ein Wort. Mit den Diensten, die so erreichbar waren, waren dann Kosten von 50 Francs pro Stunde bis zu mehreren Hundert Francs pro Stunde verbunden. Das Geld haben sich France Telecom und der Anbieter geteilt. Bei einem klassischen 3615-Angebot mit 60 Francs pro Stunde gingen 20 Francs an die Telecom und 40 Francs an den Anbieter. Der Kiosque machte den Dienst für Presse- und Diensteanbieter sehr attraktiv, erlaubte er doch, Artikel und Informationen bereitzustellen und für diese bezahlt zu werden, ohne dass zwischen jedem Kunden und dem Anbieter ein Vertrag abgeschlossen werden musste und ohne dass man jeweils Kunden-Logins brauchte, so wie es heute im Web nötig ist, wenn man die Bezahlangebote von Zeitungen und Zeitschriften im Netz nutzen möchte. Im Télétel-Kiosque brauchte es das nicht. Das Geld für die Nutzung kam automatisch von der France Télécom und die holte es sich vom Kunden über die Telefonrechnung mit Aufschlag zurück.

Durch den niedrigschwelligen Einstieg mit den “verschenkten” Geräten und dem im Prinzip kostenlosen Telefonbuch-Dienst wurden die Minitels sehr erfolgreich. Auch die angebotenen Dienste wurden teils sehr beliebt. Wer als Firma, als Bank oder Versicherung etwas auf sich hielt, musste im Kiosque verfügbar sein. Schaut man sich französische Werbung der 1980er und 1990er an, sah man daher an allen Ecken Angaben wie “3615TOYOTA”. Doch nicht nur die klassische Wirtschaft und Presse hatten Interesse an Minitel. Viele Angebote für Horoskope, Telespiele, Jobvermittlungen und nicht zuletzt Erotikangebote und die sogenannte “Messagerie”, also das Chatten, machten das Minitel beliebt und zogen manchem Franzosen und mancher Französin das Geld aus der Tasche.

Frankreich war stolz auf sein Minitel und hielt lange daran fest. Selbst als das Web schon durchaus verbreitet war, verwendeten viele Franzosen gerne weiter die kleinen Terminals, eben weil sie so gut funktionierten, man keinen Computer und keine damit auch keine Computerkenntnisse brauchte und weil viele Dienste dort schnell und einfach verfügbar waren. 2012 war es dann aber doch soweit. Télétel samt dem Telefonbuchdienst und dem Kiosque wurden eingestellt.

Bildschirmtext (Btx) in Deutschland

Télétel in Frankreich mit seinen günstigen Minitel-Geräten war ein großer Erfolg – ein so großer sogar, dass die Minitel-Popularität die Verbreitung des Web in Frankreich zunächst hemmte. Gerade aus Sicht der Anbieter ist das verständlich, denn die Möglichkeit, sehr einfach Dienste gegen Geld anzubieten, bot das Web so damals nicht und tut es an sich auch heute noch nicht.

In Westdeutschland entwickelte die Bundespost einen grundsätzlich vergleichbaren Dienst. Hier sah die Sache aber ganz anders aus. Sprichwörtlicher deutscher Perfektionismus und Bürokratie verhinderten einen Erfolg wie in Frankreich. Doch fangen wir von vorne an.

Der Dienst Bildschirmtext der Deutschen Bundespost, kurz Btx, ging nach einer Testphase in Berlin und Düsseldorf 1983 bundesweit an den Start. Das Angebot war ähnlich wie das britische Prestel hierarchisch organisiert mit vielen Informationsseiten und Unterseiten, die auf Rechnern der Bundespost gespeichert wurden. Auch externe Diensteanbieter wie Banken, Dienste der Bundespost selbst sowie Fahrplan- und Fahrkartendienste der Bundesbahn waren erreichbar. Auch einen Mitteilungsdienst gab es. Grundsätzlich sind dies gute Voraussetzungen für einen erfolgreichen Dienst. Dass es nicht so kam, lag auf der Kundenseite sicherlich an den Kosten. Das zeigt ein direkter Vergleich: Der einmalige Anschluss an Btx kostete zunächst einmal schon 55 DM (DM-Preise von Mitte der 1980er Jahre entsprechen in etwa Euro-Preisen von 2021). Für Btx brauchte man natürlich noch ein Modem. Dieses musste man bei der Post für 8 DM im Monat mieten. Ein eigenes Modem durfte man nicht betreiben. Zur Eingabe und als Anzeigegerät brauchte man dann noch einen Btx-Decoder. Das konnte zum Beispiel ein Btx-fähiges Fernsehgerät sein. Solche Fernseher waren aber mit 2500 bis 3500 DM sehr teuer und waren nie wirklich verbreitet. Ein eigenständiger Decoder, den man an einen vorhandenen Fernseher anschließen konnte, schlug immerhin noch mit 1300 DM zu Buche. Minitel-ähnliche Geräte, sogenannte BITELs oder Multitels, konnte man von der Post für sage und schreibe 48 Euro im Monat mieten. Rechnen wir zusammen, kommen wir, von den Fixkosten abgesehen, schon auf 56 DM Grundkosten pro Monat, ohne auch nur eine einzige Minute den Dienst genutzt zu haben. Diese Kosten waren in Frankreich 0 Francs. Wollten wir den Dienst nun nutzen, schlug das mit 23 Pfennig alle 8 oder 12 Minuten zu Buche, je nach Tageszeit. Rechnen wir mit einem Durchschnitt und gehen von 1 Stunde Nutzung am Tag aus, sind das nochmals 41 DM, vorausgesetzt dass wir nur kostenfreie Angebote aus dem bundesweiten Angebot oder unserem eigenen Regionalangebot7 nutzen und keine “Mitteilungen” (also E-Mails) versendeten. Das Versenden einer solchen Mitteilung kostete nämlich 40 Pfennig, das Speichern beim Empfänger, wenn man die Nachricht also nicht nur einmal lesen, sondern auch behalten wollte, 1,5 Pfennig. Briefe kosten nun einmal Porto. Auch einzelne Angebote konnten Geld kosten; von 1 Pfennig bis 9,99 DM pro Aufruf konnten anfallen. Somit war es auch in Deutschland möglich, dass Anbieter, wie etwa die Frankfurter Allgemeine Zeitung, für ihre Inhalte bezahlt werden konnten.

Btx war für Privatleute sicher zu teuer. Lohnend war es hingegen für Unternehmen, denn die Post ermöglichte geschlossene Benutzergruppen. Reisebüros etwa konnten per BTX Flüge und Hotels über spezielle Seiten buchen, die für die Allgemeinheit nicht verfügbar waren, und Handelsreisende konnten sich über BTX mit ihrem Unternehmen synchronisieren.

Technisch war das deutsche Btx komplexer sowohl als Prestel als auch als der französische Télétel-Dienst. Die Bundespost trieb mit anderen europäischen Post- und Telekommunikationsbehörden den sogenannten CEPT-Standard8 voran. Dieser Standard sorgte dafür, dass Btx erheblich schöner aussehen konnte als Prestel und Télétel. Er war aber gleichzeitig auch ein Hemmschuh, denn der Dienst wurde dadurch fehleranfälliger und in Bezug auf die möglichen Endgeräte eingeschränkter. Letzteres mag, entsprechend der Geisteshaltung einer staatlichen Behörde, die gerne alles unter Kontrolle haben möchte, sogar durchaus gewünscht gewesen sein. Im Gegensatz zum Prestel-System, das auch mit Heim- und Personal-Computern genutzt werden konnte, mussten es in Deutschland teure Spezialdecoder sein, denn die Computer der damaligen Zeit konnten CEPT nicht darstellen und waren damit auch nicht für den BTX-Dienst zugelassen.

Das Besondere am CEPT-Standard im Vergleich mit den anderen Diensten war die für damalige Verhältnisse hohe Bildqualität. Neben Textdarstellung, die sicherlich dominierte, konnten auch echte Grafiken eingebunden werden. Andere Dienste konnten Grafik allenfalls mit speziellen Grafik-Buchstaben simulieren. Ein CEPT-Bild einer Btx-Seite hatte eine Auflösung von 480x250 Pixeln und konnte auf einer Bildschirmseite 32 Farben aus einer Gesamtpalette von 4096 Farben verwenden. Mit dieser Anforderung schieden nahezu alle verbreiteten Computer Mitte der 1980er Jahre als Endgeräte aus. Im PC-Bereich herrschte noch der CGA-Standard vor. Dieser erlaubte maximal vier fest zugeordnete Farben und hatte dann nur eine Auflösung von 320x200 Pixeln; das reichte auf keinen Fall. Die seit 1984 verfügbare, aber sehr teure EGA-Grafik hätte mit 640x350 Pixeln zwar eine hinreichend große Auflösung gehabt, konnte aber nur 16 Farben aus einer Palette von 64 nutzen. Selbst das ab 1987 verfügbare VGA zeigte bei einer ausreichenden Auflösung von 640x480 nur 16 Farben (immerhin aus einer Palette von 262.144). Abseits der IBM-PC-Kompatiblen sah es nicht wirklich besser aus. Der Commodore 64 stand mit 16 festen Farben und einer Auflösung von 320x200 Pixeln auf verlorenem Posten. Die gleiche Farbzahl und Auflösung hatte auch der Atari ST, wenn er mit einem Farbmonitor betrieben wurde. Lediglich der brandneue Commodore Amiga erfüllte die Voraussetzungen zur korrekten Anzeige von Btx-Seiten im CEPT-Standard.

Durch die Kombination aus hohen Kosten, übermäßig hohen technischen Anforderungen und viel Bürokratie wurde Btx in Deutschland nicht der Erfolg, den das Minitel in Frankreich der DGT brachte. Mit dem Aufkommen des World Wide Web ging der Dienst zunächst in T-Online auf und wurde dort T-Online Classic genannt. 2001 wurde er dann größtenteils eingestellt. Lediglich für den Bereich des Online-Banking blieb die alte Technik noch bis 2007 in Betrieb, denn Banken schätzten die technischen Eigenschaften des geschlossenen Dienstes. Wer die Btx-Seite einer Bank anwählte, war durch seine Zugangskennung bei der Telekom bekannt. Die Bank musste nur eine Zuordnung von Zugangskennungen zu Konten machen und brauchte sich ansonsten nicht um die Absicherung der Kommunikation oder ähnliches kümmern. Der wilde Westen des World Wide Web bot diese so wohltuende Geschlossenheit nicht.

Btx in Österreich

Mit Prestel, Télétel und Bildschirmtext habe ich Ihnen, glaube ich, die wichtigsten Vertreter dieser frühen Variante von Online-Diensten nahegebracht. Es lohnt sich aber, einen kleinen Abstecher zu machen in Deutschlands südliches Nachbarland Österreich, denn hier ging man einen anderen Weg als in Frankreich und in Deutschland.

Die Österreichische Post und Telegraphenverwaltung (PTV) betrieb einen auf dem gleichen CEPT-Standard wie in Deutschland basierenden Dienst, der auch ebenfalls Bildschirmtext hieß. Der Dienst war allerdings etwas günstiger als in Deutschland. Das macht ihn für sich genommen noch nicht interessant. Besonders und damit herausragend war aber die österreichische Einschätzung zum Endgerät. Während man in Frankreich ja auf ein sehr einfaches, kleines Gerät setzte und dieses kostenfrei abgab und während man in Deutschland sehr restriktiv in Sachen Endgeräten vorging und diese teuer verkaufte oder vermietete, entwickelte die PTV zusammen mit der Universität Graz unter Leitung des Informatik-Professors Hermann Maurer einen eigenen Btx-Decoder namens Mupid (Mehrzweck Universell Programmierbarer Intelligenter Decoder). Ein Mupid konnte von der PTV gemietet werden. Dafür musste man einmalig 1000 Schilling aufbringen und dann 130 Schilling pro Monat bezahlen (18,17 Euro in 2021).

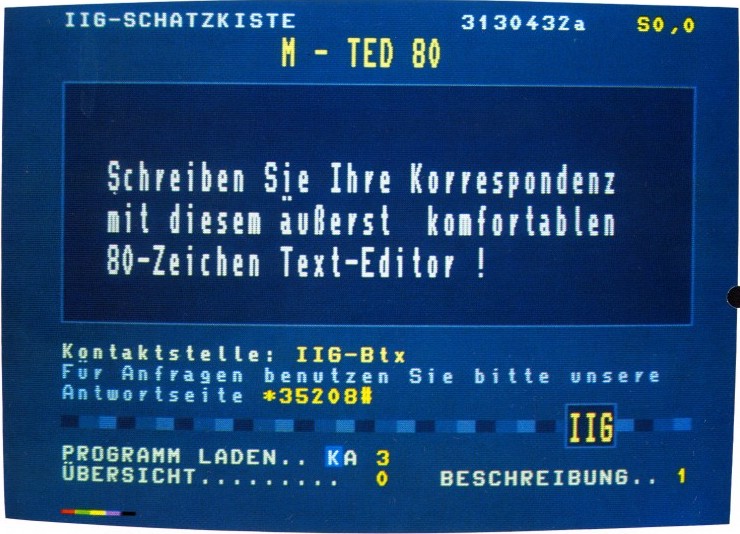

Hier abgebildet sehen Sie die zweite Version des Mupid. Die erste Version wurde noch für die Testphase des Btx-Dienstes hergestellt, als man noch den englischen Prestel-Standard nutzte. Das abgebildete Gerät erschien 1984 nach der Umstellung auf CEPT. Es sieht aus wie ein typischer Heimcomputer der Zeit und, wie ich finde, sogar wie ein ziemlich modern designter. Der Mupid sah aber nicht nur wie ein Heimcomputer aus, er war auch einer oder er konnte zumindest einer werden, wenn man ihn mit Zusatzgeräten versah.

Ein Mupid wurde über ein Kabel an einen Fernseher angeschlossen. Ebenfalls angeschlossen werden musste, zumindest wenn man Btx-Seiten ansehen wollte, das von der PTV gemietete Modem. Der Mupid selbst verfügte über einen Z80-Prozessor. Den kennen Sie schon aus einer ganzen Reihe von Heimcomputern. Er ist kompatibel zum Intel 8080, also dem Computer, der nicht zuletzt mit dem Altair 8800 den Anfang des Personal-Computer-Zeitalters mit einläutete. Mit 128 KB Arbeitsspeicher war das Gerät ganz ordentlich ausgestattet. Schloss man ein separat erhältliches Diskettenlaufwerk an, konnte man auf dem Mupid tatsächlich CP/M und die zugehörige Software laufen lassen und hatte dann einen Heimcomputer. Unter den CP/M-Computern war der Mupid allerdings ein ganz besonderer, denn eigentlich sind CP/M-Systeme ja stets reine Textsysteme. Der Mupid hingegen verfügte über für die damalige Zeit durchaus beeindruckende Grafikfähigkeiten in Bezug auf Farbanzahl und Auflösung. Um Btx-Seiten im CEPT-Standard darstellen zu können, durfte das ja auch nicht anders sein.

Der Mupid konnte also sowohl Btx-Decoder als auch Heimcomputer sein. Der Clou bestand nun aber darin, diese beiden Eigenschaften miteinander zu verbinden. Im Btx-Modus konnte ein Mupid nämlich mehr als es ein “dummer” Decoder konnte. Er vermochte es beispielsweise, vektorbasierte Zeichnungen anzuzeigen oder Eingaben auf dem Decoder zu überprüfen, ohne sie übertragen zu müssen. Verfügte man über ein Diskettenlaufwerk, ließen sich mit dem Mupid Btx-Seiten auf Diskette speichern. Diese konnten dann ohne Telefonkosten zu verursachen gelesen werden. Mit der passenden Software ließen sich Btx-Seiten sogar auf dem Mupid erstellen und auf die Postcomputer übertragen.

Auch ohne Diskettenlaufwerk konnte auf einem Mupid Software ausgeführt werden. Diese kam dann direkt aus dem Btx auf den Rechner. Der Screenshot oben zeigt, wie das aussah. Sogenannte Telesoftware, wie die oben angekündigte einfache Textverarbeitung konnten aus dem Btx geladen und dann auf dem Mupid ausgeführt werden. Auch ein BASIC-Interpreter zum Programmieren kam so auf das Gerät. Software konnte, egal ob von Diskette oder aus dem Btx geladen, den Dienst als Datenverbindung und als Speicherort nutzen, also Daten aus dem Btx empfangen oder dorthin senden. Mit diesen Eigenschaften ließen sich spannende Szenarien umsetzen, wie diese Pressemitteilung aus dem Jahr 1986 zeigt:

EDV-Ausbildungsinitiative aus Graz als Weltpremiere.

Die Arbeitsgemeinschaft für Datenverarbeitung (ADV), die größte österreichische Vereinigung von Computeranwendern, stellt anlässlich der Grazer Btx-Tage (19.02. - 22.02.86 im Kongreßsaal Messegelände) ein von der steirischen Landesgruppe der ADV (Präsident Dr.J.Koren) initiiertes neuartiges Ausbildungsprogramm für jedermann vor.

Angelehnt an das weitverbreitete Taschenbuch “EDV für jedermann” von J. Koren und W. Thaller wurde unter der wissenschaftlichen Betreuung von o. Univ. Prof. Dr. H. Maurer (TU Graz) ein 20-teiliger Kurs zur Einführung in die wichtigsten Aspekte der EDV erarbeitet: die 20 Lektionen sind im Bildschirmtextsystem (Btx) der österreichischen Post gespeichert und sind daher österreichweit über die Telefonleitung (zum Telefonortstarif) abrufbar. Jede Lektion wird zunächst in den von der Post mietbaren Btx-Computer MUPID geladen und dort (ohne weitere Telefonverbindung) durchgearbeitet.

Im Gegensatz zu einem gedruckten Fernkurs bietet diese Art der Wissensvermittlung die anschauliche Darstellung von Abläufen durch bewegte Grafik (deren Geschwindigkeit vom Benutzer gesteuert wird, die wiederholbar ist, und vieles mehr) und die direkte Kontrolle des erarbeiteten Wissens durch Fragen, die der Btx-Computer MUPID stellt und die vom Benutzer beantwortet werden sollen. (MUPID kontrolliert, ob die Antworten stimmen!) Durch die Verwendung von Btx als “Lektionenbibliothek” ist es dem Lernenden möglich, Kommentare und Verbesserungsvorschläge an den Kursersteller elektronisch zu vermitteln, die auf gleichem Wege gegebenenfalls beantwortet werden: das Institut für Informationsverarbeitung wird diese Art der Betreuung probeweise durchführen. Übrigens, die ADV denkt auch daran, Prüfungen (mit entsprechenden Zeugnissen) für diesen Kurs anzubieten.

Sicherlich war diese Form des Lernens mit dem Computer nicht die Speerspitze der Forschung. Mit experimentellen, universitären Systemen waren ähnliche Szenarien auch schon vorher und auch ausgefeilter möglich. Spannend und innovativ an dem Ansatz in Verbindung mit Btx und Mupid ist aber, dass sowas nun alltagstauglich in einem öffentlichen Dienst und damit potenziell für jeden verfügbar wurde, ohne dass komplexeste Technik angeschafft werden musste. Mit dem französischen Minitel wäre das so nicht gegangen, denn die einfachen Geräte konnten ja keine Software ausführen und im deutschen Btx wäre es auch nicht gegangen, denn hier gab es kein flächendeckend verbreitetes, “intelligentes” Gerät wie den Mupid.

Der Mupid hatte ein faszinierendes Konzept. Die Entwickler um Hermann Maurer dachten sowohl in Sachen Technik als auch in Sachen Einsatzszenarien erheblich weiter, als dies in vielen anderen Ländern der Fall war. Sie brachten die Idee der Kommunikationsinfrastuktur und die des Heimcomputers zusammen und kreierten damit einen niedrigschwelligen Zugang mit Potenzialen, die eine größere Öffentlichkeit erst Jahrzehnte später für sich entdeckten. Dies erreichten sie mit einem freundlichen, einfachen Gerät, also ohne dass man zwangsläufig zum Computerspezialisten werden musste.

Fazit

Man kann durchaus von den Bildschirmtexten einiges lernen. Dazu gehört zum Beispiel, dass “das Internet”, und hier meine ich jetzt das WWW, zwar sicherlich vieles veränderte, aber nun auch nicht aus heiterem Himmel über uns kam. Die Zeit war offensichtlich reif für digitale Mediendienste wie den Bildschirmtext. Eine Betrachtung der Dienste zeigt auch, dass es möglich ist, Technologie dieser Art in einer Art und Weise bereitzustellen, die die technischen Hürden beim Kunden niedrig halten, denn für die Nutzer von Prestel, Btx oder Télétel war es ein einfaches Leben ohne ständige Sicherheitsupdates und ohne dass man von ihnen verlangt hätte, ein Betriebssystem zu beherrschen. Man erfährt auch, und das ja nicht zum ersten Mal, dass sich nicht immer das technisch Bessere durchsetzt, sondern oft auch das Verfügbarere, Einfachere und Niedrigschwelligere. Man lernt, dass zentralisierte Systeme großartig sein können und Kreativität fördern, wenn sie die Infrastruktur für individuelle, kreative Anbieter und Kunden bieten, aber dass solche Systeme zum Hemmschuh werden, wenn sie bürokratisch und unflexibel gestaltet sind. Letztendlich lehrt einen das Beispiel des österreichischen Btx, dass man durch Blicke über den Tellerrand, durch intelligente Kombinationen das Bekannte neu denken kann und sich dann neue Nutzungsmöglichkeiten ergeben.

Online-Dienste und Bulletin Board Systems

So attraktiv die Bildschirmtext-Dienste auch scheinen mögen, blieben sie doch eine ziemlich europäische Angelegenheit. Es gab einige Ableger in Asien und auch in den USA gab es vereinzelte Projekte, die aber lokal blieben und meist auch nicht lange überlebten. Dort gab es jedoch Online-Dienste und sogenannte Bulletin Board Systeme, die einen anderen Ursprung haben als die Bildschirmtexte in Europa.

Die Grundidee hinter Online-Diensten ist fast so alt wie die der interaktiven Computer selbst. Erinnern wir uns: Beim Time Sharing teilten sich viele Teilnehmer die Rechenzeit des Computers, der sie reihum bediente. Dazu bedienten sie sich Terminals – zu Beginn meist Fernschreiber, später dann eigene Geräte mit Tastatur und Bildschirm. Man konnte den Computer aus der Ferne nutzen, ohne die eigentliche Anlage je sehen zu müssen. Innerhalb eines Firmensitzes oder eines Universitätscampus war dies durch das Legen eines direkten Kabels zur Rechenanlage möglich, doch lag es ja nun auch nahe, die Dienste auch aus größerer Entfernung anzubieten. Schließlich gab es bereits ein landesweites Kommunikationsnetz in Form des Telefonnetzes. Mittels Modems konnten über dieses Telefonnetz sowohl Computer miteinander als auch, und darum geht es ja hier, Terminals mit entfernten Computern verbunden werden. Man konnte sich so von entfernten Orten mit Firmen- oder Universitätscomputern verbinden. Die Terminals selbst konnten nichts weiter als Textzeichen anzeigen und Tastatureingaben verschicken. Wenn das gut klappte, wirkte es so, als säße man direkt vor Ort am Terminal.

Diese Technik, um aus Entfernung auf Timesharing-Computersysteme zugreifen zu können, wurde zu einer Geschäftsidee, denn nicht jeder, der vielleicht davon profitieren könnte, hatte Zugang zu einem Timesharing-System. Vor allem viele kleinere Firmen konnten sich weder eigene Computer leisten noch hatten sie Zugang zu universitären Rechnern. Sehr zupass kam ihnen da das Angebot von Timesharing-Anbietern. Das waren Firmen, die es zu ihrem Geschäftsmodell machten, Computersysteme zu betreiben, auf die man sich gegen Gebühr aus Entfernung verbinden und auf denen man dann seine Programme laufen lassen konnte. Solche Firme gab es in kleiner Größe oder auch als große Player, wie etwa das schon 1969 gegründete CompuServe. Über das Telefonnetz konnte man sich von vielen großen Städten der USA auf die zentralen Timesharing-Computer von CompuServe verbinden und seine Programme laufen lassen. Diese Programme konnten ganz individuell sein. Viele Firmen brauchten aber natürlich ganz ähnliche Dienste und viele Dienste konnten gerade auch vom zentralen Charakter des Anbieters profitieren.

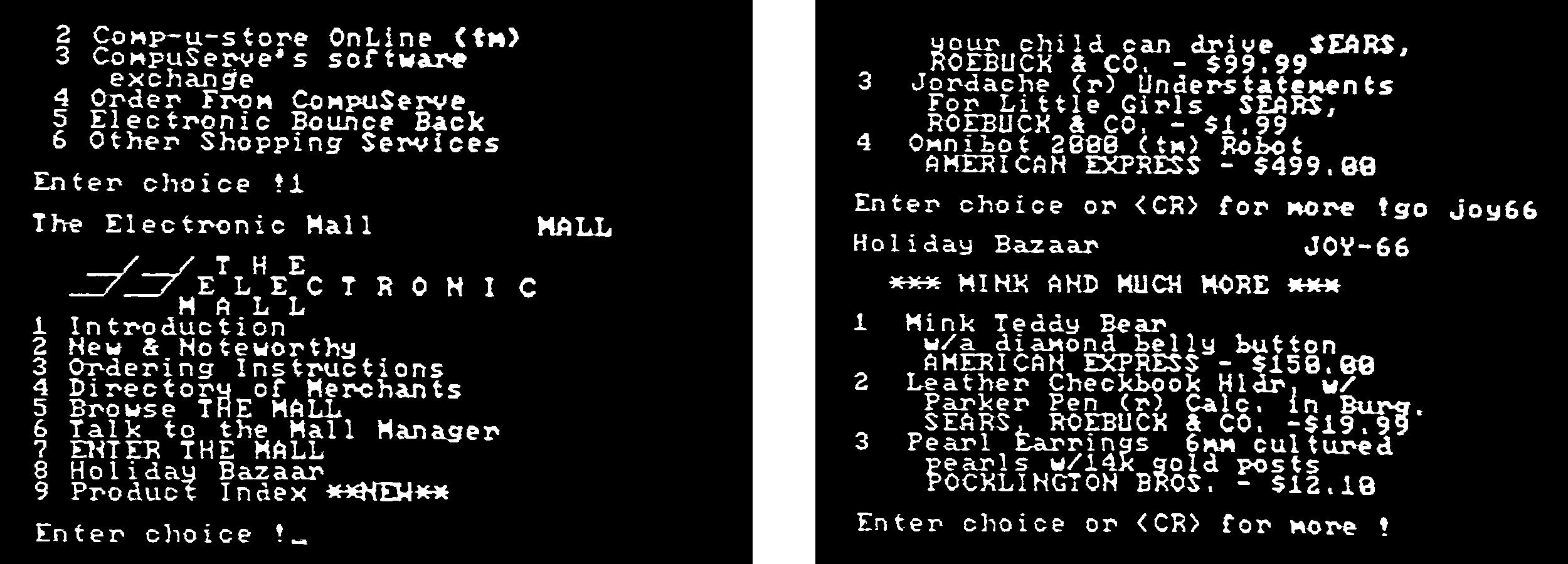

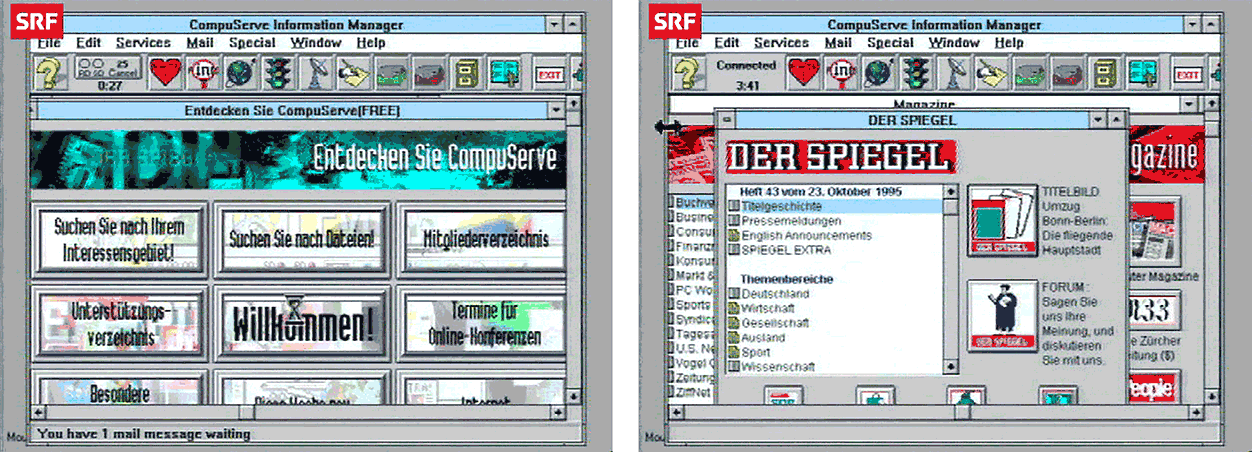

Ende der 1970er Jahre wurde CompuServe so von einem Timesharing-Anbieter zu einem Onlinedienst mit Zugriff auf Finanzinformationen, auf Banking, auf Lexika und Nachschlagewerke, auf Nachrichtenangebote und mit der Möglichkeit, zwischen den Teilnehmern Nachrichten zu verschicken. Zugang erlangte man nun nicht mehr mit Fernschreibern und Terminals, sondern mit aufkommenden Personal- und Heimcomputern. Das Ergebnis war bis in die 1990er Jahre, ganz wie der Großteil der Nutzungsschnittstellen der damaligen Computer, textbasiert. Mit dem Aufkommen grafischer Nutzungsschnittstellen änderte sich dies natürlich. CompuServe-Inhalte wurden nun in Fenstern und mit einer grafischen Nutzungsschnittstelle angezeigt. Andere Anbieter kamen hinzu. Bekannt sind America Online (AOL) und das Microsoft Network (MSN).

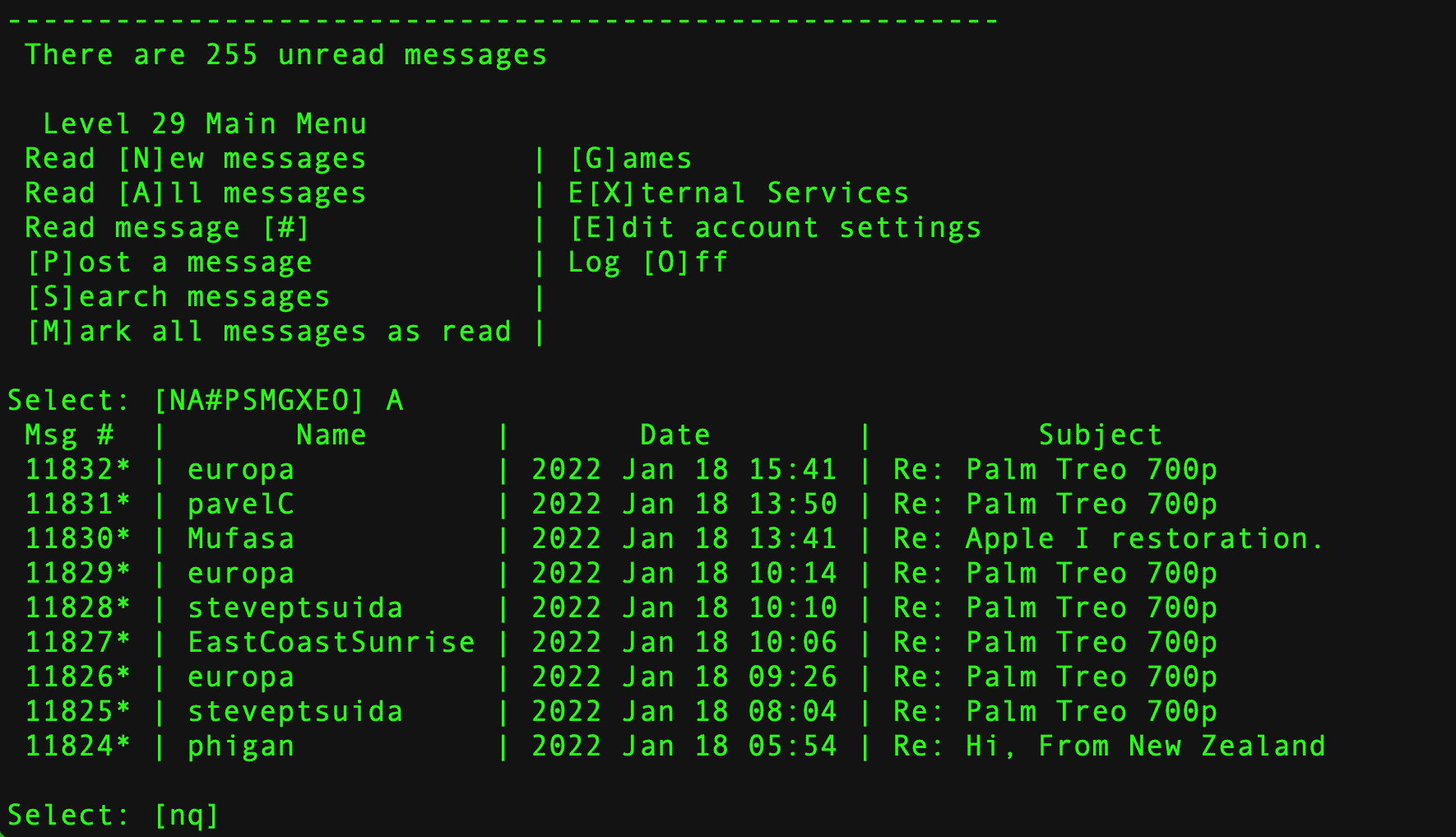

Einen regelrechten Gegenentwurf zu den großen Online-Diensten, die von großen Anbietern gepflegt wurden und stark kommerzielle Zwecke erfüllten, bildeten die BBS, die Bulletin Board Systems. Im deutschen Sprachraum wurde dieser Begriff erstaunlicherweise weder im englischen Original noch in der Übersetzung “Nachrichtenbrett-Systeme” verwendet. Stattdessen verwendete man mit “Mailbox” einen anderen englischen Ausdruck, der gar nicht besonders gut passt, denn private Briefe standen nie im Mittelpunkt der Systeme.

Hinter BBS-Systemen standen keine großen, kommerziellen Anbieter, sondern oft Privatleute oder allenfalls kleinere Firmen. Als das erste System dieser Art wird das Computerized Bulletin Board System (CBBS) angesehen. Ab 1978 konnte es im Raum Chicago per Modem angewählt werden. Man erreichte dann einen Altair-artigen Computer, um die digitale Version eines schwarzen Bretts einzusehen und dort Nachrichten zu hinterlassen. Diese namensgebende Funktionalität wurde im Laufe der Jahre ergänzt um private Nachrichten von einem Teilnehmer an einen anderen, die Möglichkeit, Software für den eigenen Heimcomputer herunterzuladen und oft sogar um einfache Online-Spiele und Chats. Ein solcher Chat war natürlich nur dann möglich, wenn das BBS-System über mehr als eine Leitung verfügte, denn nur dann konnten ja mehrere Teilnehmer gleichzeitig verbunden sein. Das war bei Weitem nicht bei allen BBS-Systemen der Fall. Typische BBS-Systeme waren häufig Heimcomputer von Technikbegeisterten. In den 1980er Jahren waren es oft IBM-kompatible PCs, die mit Microsofts DOS betrieben wurden. Auch C64-Systeme wurden gerne als BBS-Server eingesetzt. Diese Computer waren mit einem oder vielleicht auch mal mit zwei Modems ausgestattet. Nutzer des Systems brauchten ebenfalls ein Modem und konnten dann von ihrem Heimcomputer aus den BBS-Rechner anrufen und Daten austauschen. Oft war dieses Modem nur ein einfacher Akustikkoppler. Gerade in Deutschland hatte man, wenn man nichts Illegales machen wollte, auch kaum eine andere Wahl, denn Privatleute durften ja keine eigenen Modems an das Telefonnetz anschließen.

Ein BBS-System war eine Insel mit einem eigenen Angebot. Viele BBS-Systeme boten aber den sogenannten NetMail-Dienst an. Man konnte mit diesem Dienst Nachrichten an die Teilnehmer anderer BBS-Systeme schicken. Dies geschah natürlich noch nicht über das Internet, das zum damaligen Zeitpunkt ja noch nahezu rein auf Forschungseinrichtungen beschränkt war und damit weit weg war von dem, was man mit Heimcomputern machte. Vielmehr schlossen sich die BBS-Systeme selbst in Netzwerken zusammen. Verfasste man eine Nachricht an einen Teilnehmer in einem anderen BBS-System, wurde diese nicht sofort zugestellt, sondern erstmal zwischengespeichert. Irgendwann in der Nacht dann riefen sich die BBS-Computer untereinander an und tauschten die Nachrichten aus.

BBS-Systeme waren natürlich weit weniger professionell als die amerikanischen Online-Dienste oder die europäischen Bildschirmtext-Dienste. Das konnte aufgrund der Struktur ja auch nur so sein. BBS-Systeme stehen in einer ähnlichen Tradition wie die Personal Computer. Im Kapitel über den Altair 8800 habe ich Ihnen die Situation Ende der 1970er Jahre erläutert, als sich in den USA Bastler in Clubs zusammentaten, um ihre eigenen Rechner zu bauen und damit dafür zu sorgen, dass Computer nicht mehr nur eine Sache von Militär, Industrie und Verwaltung waren, mit der die normale Bevölkerung nichts zu tun haben sollte. Man kann das Ziel dieser Clubs regelrecht als Versuch eines Befreiungsschlags ansehen. BBS-Systeme haben einen ganz ähnlichen Charakter. Es waren nun nicht professionelle Firmen oder Postorganisationen, die die Welt der computerisierten Kommunikation eröffneten, sondern Technikbegeisterte und Hobbyisten, die mit ganz einfachen Mitteln die Welt verändern wollten.

Auf der Höhe ihrer Popularität ging die Anzahl der BBS-Systeme in den USA in die Zehntausende, mit Millionen regelmäßiger Nutzer. Zusammengenommen hatten die BBS-Systeme mehr Nutzer als Online-Dienste wie CompuServe. So mag es einen auch nicht wundern, dass das neue Betriebssystem Windows 95 im Jahr 1995 zwar noch keinen Webbrowser enthielt, aber sowohl einen Zugang zu Microsofts Online-Dienst MSN als auch ein Terminalprogramm, mit dem man ein angeschlossenes Modem ansteuern und mit einem BBS-System verbinden konnte. All dies sollte sich bald ändern, denn BBS-Systeme und Onlinedienste bekamen Konkurrenz durch lokale ISPs, Internet Service Provider. Das World Wide Web lief den etablierten Angeboten in nur wenigen Jahren den Rang ab.

Das World Wide Web

Mit der steigenden Popularität des Internets durch das World Wide Web ging die Zeit der Bildschirmtextsysteme, der Online-Dienste und der BBS-Systeme zu Ende. Das Internet hat seine Anfänge im Bereich von Universitäten und Wissenschaftsorganisationen. Es hat an sich keine Nutzungsschnittstelle, sondern ist eine reine Infrastruktur, die die Nutzung verschiedenster Dienste ermöglicht. Der wohl ursprünglichste Internetdienst hat den Namen telnet und erlaubt es Nutzern, sich über das Netz auf entfernten Computern anzumelden und diese fernzusteuern, den eigenen Computer also als Terminal für entfernte Großrechner zu verwenden. Der Dienst trat an die Stelle der Einwahl auf entfernte Computer über eine Telefonleitung. Über die Jahre kamen viele weitere Dienste hinzu. Einer der bekanntesten ist der E-Mail-Dienst, den wir ja auch heute noch nutzen. Vom FTP, dem Dienst zum entfernten Zugriff auf Dateien, wird im Kapitel Verteilte Persistenz noch die Rede sein. In diesem Kapitel soll es hauptsächlich um den Dienst gehen, der heute so dominant ist, dass er in der Öffentlichkeit allgemein für das Internet steht. Wir beginnen unsere Betrachtung des Internets aber – so kennen Sie das von mir schon – nicht direkt mit dem Web, sondern mit einer Parallelentwicklung und werden wieder sehen, dass die Zeit für bestimmte Entwicklungen offensichtlich reif war.

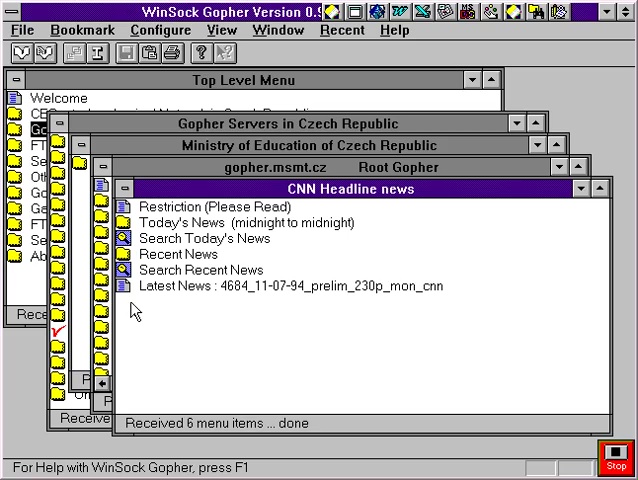

Ein Gopher wühlt sich durch Dokumente

Anfang der 1990er Jahre entstand an der Universität von Minnesota in den USA ein Dienst zur Verfügbarmachung von Text-Dokumenten. Dem Dienst wurde der Name Gopher (gesprochen Goffer) gegeben. Der Name ist etwas eigenartig. Schlägt man im Wörterbuch nach, findet man die “Taschenratte”. Der Hintergrund hinter der kuriosen Namensgebung ist vielschichtig. Das Maskottchen der Universität und des Staats Minnesota spielt mit hinein, aber auch umgangssprachliche Definitionen des Wortes und die Eigenart von Gophern, sich “durchzuwühlen”, spielt eine Rolle. Die offizielle Beschreibung von Gopher9 führt aus:

gopher n. 1. Any of various short tailed, burrowing mammals of the family Geomyidae, of North America. 2. (Amer. colloq.) Native or inhabitant of Minnesota: the Gopher State. 3. (Amer. colloq.) One who runs errands, does odd-jobs, fetches or delivers documents for office staff. 4. (computer tech.) software following a simple protocol for burrowing through a TCP/IP internet.

Der Zweck und die Charakteristik von Gopher erklären sich durch seine Herkunft als universitäres Informationssystem gut. Hier gilt es natürlich, viele Dokumente verfügbar und diese auf eine ordentliche, gut verständliche Art und Weise erschließbar zu machen. Man entschied sich dazu, die Dokumente in einer hierarchischen Struktur darzustellen, einer Organisationsform, die aus Bibliotheken und Verwaltung schon bekannt war. Auch dies erläutert die Beschreibung von Gopher sehr schön:

A hierarchical arrangement of information is familiar to many users. Hierarchical directories containing items (such as documents, servers, and subdirectories) are widely used in electronic bulletin boards and other campus-wide information systems. People who access a campus-wide information server will expect some sort of hierarchical organization to the information presented.

Das Gopher-System der Universität von Minnesota war technisch sehr simpel gestaltet. Im Vordergrund standen Textdateien, die in einer einfachen, hierarchischen Struktur organisiert waren und mit Volltextindizes leicht durchsucht werden konnten. Das System sollte zum einen leicht verständlich sein und zum anderen wenig Ressourcen benötigen. Wie das aussah, sehen Sie zum Beispiel auf obiger Abbildung. Hier werden die Indizes von Gopher-Seiten unter Windows 3.1 gezeigt. Aufgrund der Einfachheit der Struktur ließ sich der sogenannte Gopher-Space aber auch sehr einfach auf reinen Textterminals erobern. Gerade an Universitäten mit ihren Unix-Terminals war dies nicht zu vernachlässigen.

Gopher ist heute weitgehend unbekannt. Der Dienst wurde vom World Wide Web regelrecht überrollt. Als ein Grund dafür gilt auch, dass die Universität von Minnesota sich anschickte, mit der Technologie Geld verdienen zu wollen und sie nicht mehr frei zur Verfügung zu stellen. Dieser wirtschaftliche Faktor mag sicher eine Rolle gespielt haben, obgleich es nie wirklich dazu kam, dass Geld für die Gopher-Technologie verlangt wurde. Im Zusammenhang betrachtet scheinen mir andere Faktoren viel wichtiger gewesen zu sein. Die reine hierarchische Struktur und der starke Fokus auf Textdateien, die noch nicht einmal in Sachen Farbe und Schriftart angepasst werden konnten, passten nicht so recht zum aufkommenden Multimedia-Zeitalter. Firmenpräsenzen, aber auch Vereins- und Privat-Gopher-Seiten wären schon einigermaßen öde gewesen.

Das frühe World Wide Web

Die Grundidee hinter der Entwicklung des World Wide Web ist der von Gopher an der Universität von Minnesota gar nicht unähnlich, denn in beiden Fällen ging es letztlich um das Zugänglich-Machen von Informationsinhalten. Der britische Informatiker Tim Berners-Lee und sein belgischer Kollege Robert Calliau konzipierten und entwickelten das WWW am CERN in Genf. CERN steht für Conseil Européen pour la Recherche Nucléaire und ist das größte europäische Kernforschungszentrum. Bekannt ist es vor allem für seine großen Teilchenbeschleuniger. Die vielleicht einflussreichste Entwicklung des CERN ist aber bei Weitem nicht so kompliziert wie Teilchenphysik.

Man kann sich gut vorstellen, dass am CERN schon seit jeher viele Computer genutzt, viele Informationen abgelegt und viele Dokumente geschrieben wurden. So beschreibt es auch das Proposal für das WWW aus dem Jahr 199010:

At CERN, a variety of data is already available: reports, experiment data, personnel data, electronic mail address lists, computer documentation, experiment documentation, and many other sets of data are spinning around on computer discs continuously.

Das Problem war aber die Verbindung der Informationen.

It is however impossible to “jump” from one set to another in an automatic way: once you found out that the name of Joe Bloggs is listed in an incomplete description of some on-line software, it is not straightforward to find his current electronic mail address. Usually, you will have to use a different lookup-method on a different computer with a different user interface. Once you have located information, it is hard to keep a link to it or to make a private note about it that you will later be able to find quickly.

Berners-Lee und Calliau wollten mit ihrem System also ein sehr konkretes Problem am CERN lösen. In der heutigen Geschichtserzählung, auch betrieben von Tim Berners Lee selbst, erscheint das mitunter anders. Die Wikipedia spricht zum Beispiel von seiner “vision of a global hyperlinked information system”. Ob es die gegeben hat, wann es sie gegeben hat und ob nicht aus dem späteren Erfolg dann ex post die Gedanken der Vergangenheit zu einer Vision verklärt wurden, wird hier nicht zu klären sein. Interessanter jedenfalls wird die Geschichtsbetrachtung, wenn man nicht von geniegleichen Visionären ausgeht, sondern wenn man, wie auch beim Rest der Computergeschichte, Beweggründe, Kontexte und Einflüsse betrachtet.

Betrachtet man das WWW rein von der technischen Seite her, war es nicht besonders innovativ und visionär, sondern im Gegenteil ziemlich einfach. Web-Technologie bestand nur aus zwei Spezifikationen, einer für Server, die das Übertragungsprotokoll HTTP beherrschen mussten, und einer weiteren für Terminalprogramme, Browser genannt, die die Auszeichnungssprache HTML interpretieren können mussten.

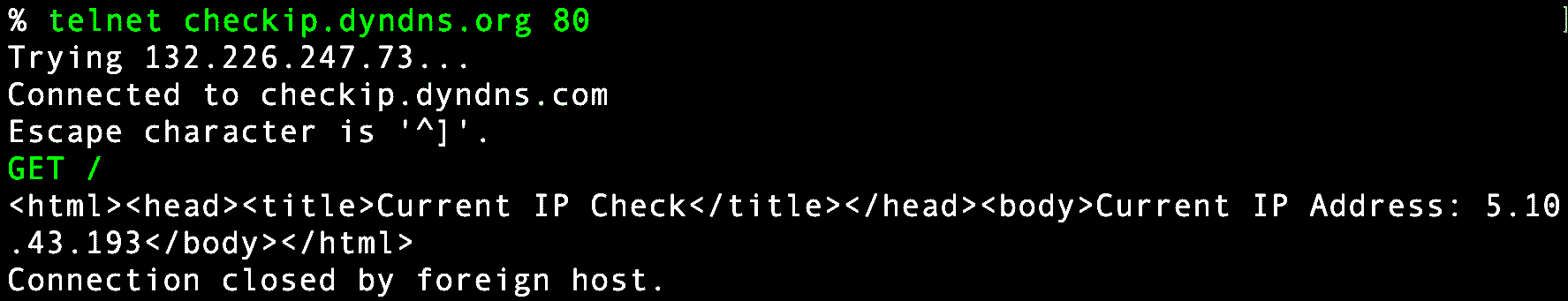

Die Hauptfunktionalität von HTTP-Servern ist das Ausliefern von Dokumenten. Dieser Prozess läuft sehr simpel ab. Stellen Sie sich einen HTTP-Server vor wie jemanden, der vor einem Telefon sitzt. Sie können diese Person anrufen. Nach dem Abnehmen sagen Sie ihr, welches Dokument Sie vorgelesen haben möchten. Die Person am anderen Ende liest das Dokument vor und legt direkt wieder auf. Diesen Vorgang sehen Sie in der Abbildung oben. Dort wurde ein Webserver ohne Browser angefragt, sodass man mitlesen kann, welche Daten gesendet und empfangen werden. In den ersten Zeilen sehen Sie in grün, dass hier eine Verbindung zum Port 80 des Rechners, der unter checkip.dyndns.org erreichbar ist, aufgebaut wird. Der Computer “nimmt ab” und erwartet, dass man ihm sagt, was man will. “GET /” bedeutet nicht weniger als “Gib mir die Hauptseite!”11. Hätte der Server auch ein Impressum zu haben, könnte man zum Beispiel “GET /impressum.html” anfragen und würde entsprechend bedient. Unter der Anfrage sehen Sie die Antwort in Form eines sehr einfachen HTML-Dokuments. Danach beendet der Server direkt die Verbindung.

Wenn ein Browser eine Anfrage über HTTP an einen Server schickt, kriegt er eine Antwort. Das haben Sie gerade gesehen. Meist war und ist das wie oben reiner Text. Auch der Text, den Sie hier gerade lesen, könnte so übertragen werden. Es ergäben sich aber Einschränkungen, wenn man auf einfache Zeichen beschränkt bliebe. Grundsätzlich besteht ein reiner Text zwar aus einer Aneinanderreihung von Buchstaben, Zahlen, Leerzeichen und einigen Sonderzeichen. Dokumente wie das, das Sie gerade lesen, bestehen aber aus mehr als nur einer solchen Aneinanderreihung. Sie haben auch eine Struktur, die sich in sichtbaren Eigenschaften offenbart. Der Satz, den Sie gerade lesen, ist Teil eines Absatzes, etwas weiter oben und auch weiter unten finden Sie Überschriften verschiedener Hierarchieebenen. Sie erkennen sie an der Formatierung mit großer oder fetter Schrift. An mancher Stelle wird durch Änderung des Schriftstils etwas besonders herausgestellt. Die Textzeichen, die von einem HTTP-Server kommen, können selbst aber nicht groß, klein, kursiv oder fett sein. Bei reinem Text ist in Sachen Formatierung nicht mehr möglich als bei einer alten Schreibmaschine oder einem Fernschreiber. Es gibt nur Buchstaben, Zahlen, Sonderzeichen, Leerzeichen und Zeilenumbrüche. Damit ein Browser daraus einen formatierten, strukturierten Text machen kann, muss man in den Text etwas hineinschreiben, was nicht direkt angezeigt wird, was aber die Struktur beschreibt. Genau das macht HTML, die Hypertext Markup Language. Wir schauen uns zunächst einmal ein paar Beispiele an. Keine Angst, Sie müssen dafür nicht zum Programmierer werden.

Die Originalfassung von HTML von Tim Berners-Lee definierte 22 sogenannte Tags, die genutzt werden konnten, dem Text Struktur zu geben. Das englische Wort “Tag” übersetzt sich als “Etikett”. Man klebt also quasi Etiketten an den Text, um seine Struktur zu beschreiben. Das sah dann zum Beispiel so aus:

<TITLE>Ein einfaches Dokument</TITLE>

2: <H1>Dies ist

3: HTML

4: <P>Dies ist ein sehr einfaches HTML-Dokument.

5: <P>Zu HTML gibt es viel zu sagen. <HP1>Das Wichtigste sind die Tags</HP1>.

6: <H2>Tags!

7: <P>Die erste Version hat 22 Tags: TITLE, NEXTID, A, ISINDEX, PLAINTEXT,

8: LISTING, P, H1, H2, H3, H4, H5, H6, ADDRESS, DL, DT, UL, LI, MENU

9: und DIR. 14 davon sind auch heute noch aktuell.

In Zeile 1 wird der Dokument-Titel bestimmt. Alles, was zwischen <TITLE> und </TITLE> steht, ist der Titel des Dokuments. Bei aktuellen Browsern ist das der Text, der in der Titelzeile des Fensters bzw. als Beschriftung des Tabs angezeigt wird. Zeile 2 beginnt mit <H1>. Das sagt dem Browser, dass alles, was danach kommt, eine Überschrift der ersten Ordnung ist, also der obersten Ebene. Browser zeigen Überschriften in der Regel in großer, fetter Schrift an. Zeilenumbrüche werden in HTML übrigens ignoriert. Dass das Wort “HTML” in einer eigenen Zeile steht, hat also keine Konsequenz in der Darstellung. Eine Überschrift würde da wieder aufhören, wo </H1> steht. Das hat man sich hier aber gespart. Also endet die Überschrift da, wo eine andere Textart beginnt. Das ist in Zeile 4 der Fall, denn da beginnt mit <P> ein Absatz (auf Englisch paragraph). Ähnlich sieht es in Zeile 5 aus. Hier beginnt ein neuer Absatz; der davor endet also automatisch. Interessant ist, was im zweiten Teil der Zeile passiert, denn hier steht Text zwischen <HP1> und </HP1>. HP steht für “highlighted phrase”. Es handelt sich also um Text, der besonders herausgestellt wird. Er könnte zum Beispiel fett dargestellt werden12. Zeile 6 definiert wieder eine Überschrift, dieses Mal eine der zweiten Ordnung, also etwas kleiner in der Darstellung. In Zeile 7 folgt dann wieder ein Absatz.

Das ist alles keine Hexerei, oder? Man kann sich das Ganze eigentlich so vorstellen, als würde einem jemand den Text durchgeben, den man in einer Textverarbeitung wie Word eingeben soll. Die Tags sind dann immer Hinweise, welche Formatierungsknöpfe man drücken soll. Bei H1, H2 und P wählt man jeweils die Formatvorlagen für Überschriften und Absätze aus und bei HP1 klickt man auf fett. Mehr ist es zunächst einmal gar nicht. Das eigentlich Interessante an HTML, weswegen das Ganze für das CERN interessant war und was auch den Namen Hypertext Markup Language erklärt, zeigt dieses Beispiel:

<H2>Links

<P>Das Wichtigste an HTML sind die <A HREF=links.htm>Links zu anderen

Ressourcen</A>. Mehr erfahren Sie, wenn Sie auf den Link klicken.

Die erste Zeile definiert wieder eine Überschrift. Das kennen wir schon. Dann folgt ein Absatz – auch schon bekannt. Interessant ist dann <A HREF=links.htm> bis </A>. Hier handelt es sich um einen Link, also eine Verknüpfung zu einem anderen Dokument. Der Text dazwischen, also “Links zu anderen Ressourcen”, kann angeklickt werden. A steht für “anchor”. Danach folgt ein Attribut HREF für “hypertext reference” und dahinter steht dann, wohin dieser Link führt, nämlich zum Dokument mit dem Namen links.htm. Wählt ein Nutzer den Link aus, kontaktiert der Browser per HTTP den Server und sendet den Befehl GET /links.htm. Die Antwort wird wieder ein HTML-Dokument sein, das der Browser anzeigen kann. Ein Anker konnte nicht nur Ausgangspunkt eines Links, sondern auch dessen Ziel sein. In dem Dokument links.htm könnte zum Beispiel <A NAME=wichtig><H1>Wichtige Links</H1></A> stehen. Man könnte den Link oben dann zu <A HREF="links.htm#wichtig"> ändern. Er würde dann direkt zum Anker im Zieldokument springen.

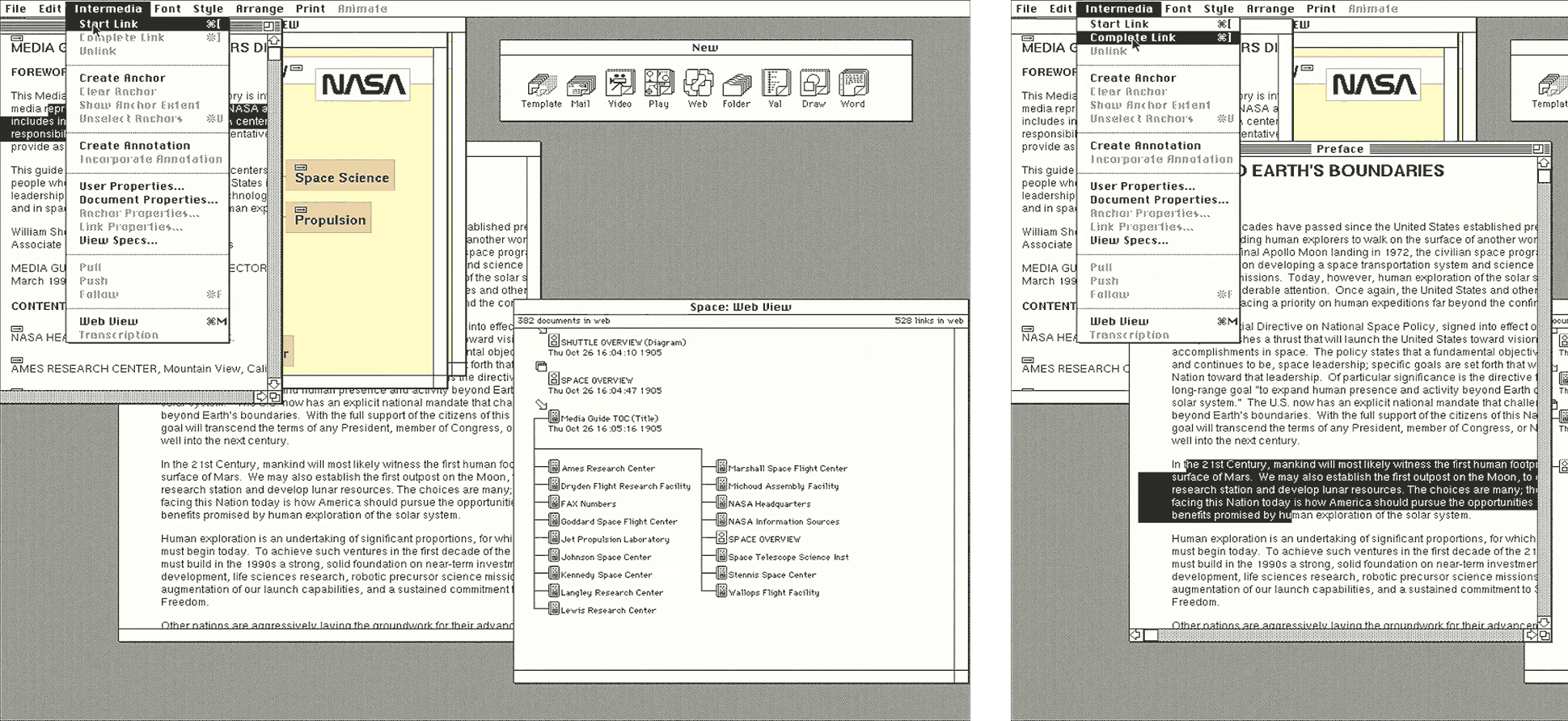

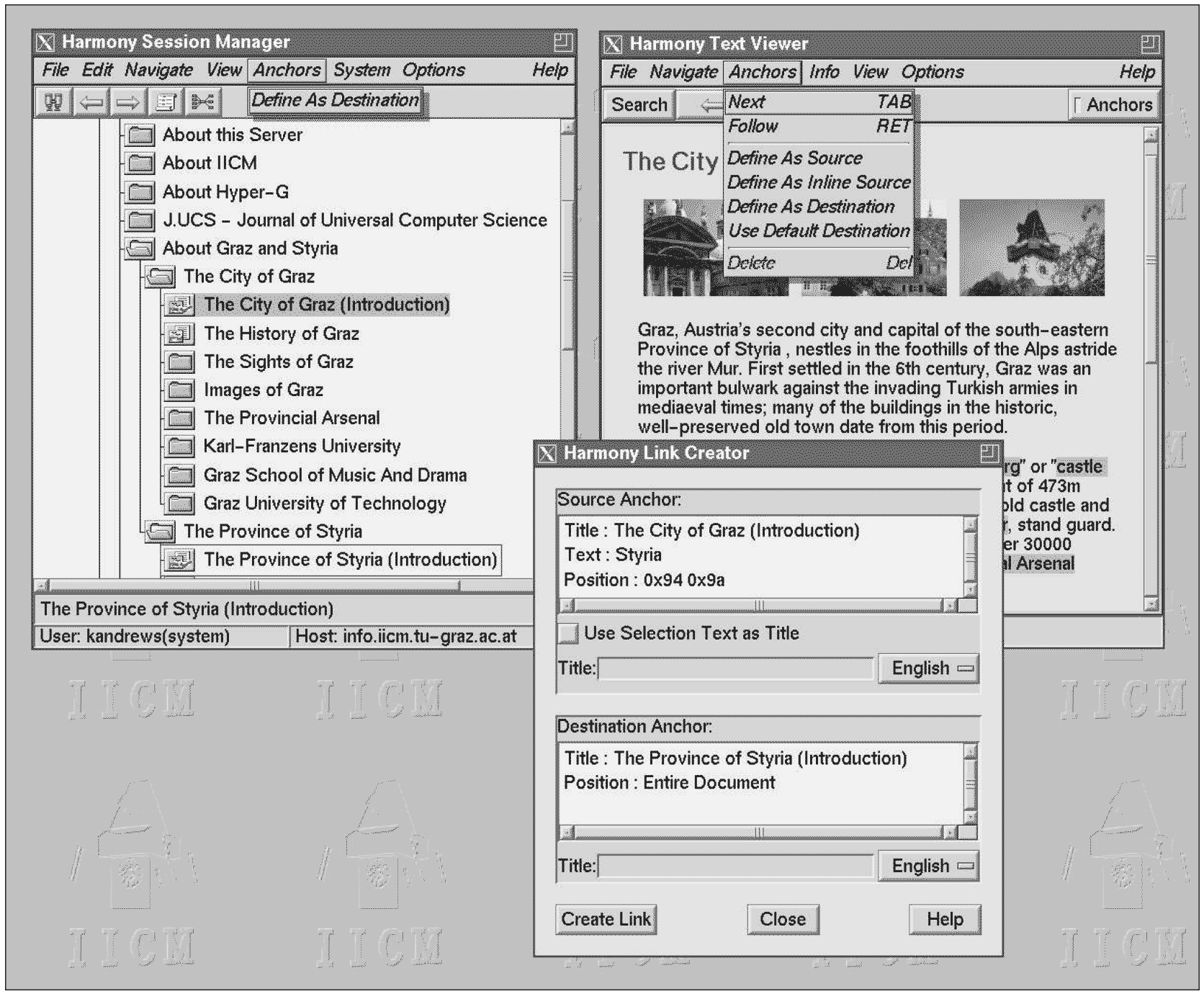

Die ganzen komischen Abkürzungen, die Sie hier kennengelernt haben, HREF für “hypertext reference”, HTML für “hypertext markup language”, HTTP für “hypertext transport protocol” haben das merkwürdige Wort Hypertext gemeinsam. Über Hypertext wurde in den 1980ern und 1990ern sehr viel geforscht. Viele Hypertext-Systeme wurden entwickelt, von denen heute selbst unter Informatikern kaum noch jemand etwas weiß. Weiter unten erzähle ich Ihnen mehr darüber, welche Potenziale hinter Hypertext stecken. Beim World Wide Web bedeutet Hypertext nicht mehr als das, was ich Ihnen gerade bereits erläutert habe, nämlich die Möglichkeit, in ein Textdokument sogenannte Anker einzubauen, die Start- und Endpunkte von Verknüpfungen sein können.

Mit dem, was ich bis hierher erläutert habe, habe ich das frühe Web technisch fast vollständig beschrieben. Charakteristisch für das WWW war nicht seine technische Finesse, sondern gerade seine extrem technische Einfachheit und Offenheit. Nicht nur war es recht einfach, eigene Webserver und Browser zu programmieren, durch die Dezentralität war es auch möglich, einen eigenen Server einzurichten. Insofern man über einen dauerhaften Internetzugang verfügte, was am Anfang natürlich vor allem an Universitäten, später dann bei vielen Unternehmen und dann nach und nach bei mehr und mehr sogenannten “Hostern” der Fall war, konnte man einen Server ans Netz anschließen und war damit Teil des World Wide Web, ohne dass es irgendeiner zentralen Koordination bedurft hätte und dieser Server mit irgendwelchen anderen Webservern etwas zu tun haben müsste.

Typisch gerade für das frühe WWW war, dass ein Server in der Regel nicht mehr tat, als Dateien, die auf einer großen Festplatte gespeichert waren, so auszuliefern, wie sie waren. Von vornherein war allerdings auch vorgesehen, dass über Webserver und Browser auch Zugriff auf bereits vorhandene Systeme realisiert werden konnte. Damit das funktionierte, musste ein Server so programmiert werden, dass er mehr konnte als einfach nur Dateien versenden. Er musste vorhandene Systeme im Hintergrund aufrufen, die erhaltenen Informationen aufarbeiten und HTML-garnierten Text an den Browser schicken. Dadurch wurde es möglich, über das Web auch auf die Inhalte von existierenden CERN-internen Hilfesystemen, auf eine Informationssuchmaschine und sogar auf das Telefonbuch zuzugreifen. Die Proposals für das WWW weisen darauf hin, dass das Telefonbuch dann z. B. Links zwischen Personen, Abteilungen und Arbeitsgruppen beinhalten könnte. Natürlich sind diese Beispiele recht simpel, aber, wenn man es nüchtern betrachtet, liegt hier die Grundlage für das, was man später Web-Anwendung nennen sollte, also eine webbasierte Nutzungsschnittstelle für eine komplexe Anwendungslogik im Hintergrund.

Da das WWW zunächst vor allem für das CERN entwickelt wurde, fehlten ihm Eigenschaften, die für eine allgemeine Nutzung durchaus vieler Features nötig gewesen wären. Der erste Browser für das WWW, der von Tim Berners-Lee selbst geschriebene Browser, der verwirrenderweise auch selbst den Namen “World Wide Web” trug, konnte nicht nur Webseiten anzeigen, sondern diese auch ändern. Das klappte sowohl bei HTML-Dateien auf der lokalen Festplatte als auch über HTTP. Was fehlte, war jegliche Art von Zugriffsbeschränkungen. Im Proposal heißt es dazu:

[The project will not aim] to use sophisticated network authorisation systems. Data will be either readable by the world (literally), or will be readable only on one file system, in which case the file system’s protection system will be used for privacy. All network traffic will be public.

[…]

Discussions on Hypertext have sometimes tackled the problem of copyright enforcement and data security. These are of secondary importance at CERN, where information exchange is still more important than secrecy. Authorisation and accounting systems for hypertext could conceivably be designed which are very sophisticated, but they are not proposed here.

Diese Lösung mochte CERN-intern funktionieren; sobald das World Wide Web allerdings wirklich “worldwide” wurde, wurde dieser Mangel kritisch. Stellen Sie sich einmal vor, Sie könnten die Website der Tagesschau aufrufen und den Text einer Nachricht einfach ändern und er wäre dann für jeden geändert, ohne dass an irgendeiner Stelle überprüft würde, wer Sie sind und ob Sie überhaupt berechtigt sind, diese Änderung vorzunehmen. Die praxisuntaugliche Funktionalität zum Ändern des Inhalts von Websites, wie Berners-Lee sie umsetzte, fehlte dann logischerweise bei nahezu allen öffentlichen Servern und Browsern.

Die Geschichte der Browser

Den Browsern und ihrer Entwicklung kam in der Geschichte des World Wide Web eine große Rolle zu. Das Web wurde nicht zentral kontrolliert. Daher konnte keiner wirklich bestimmen, was Webtechnologie ist und was nicht. Verschiedenste Nutzergruppen und Anbieter hatten natürlich ganz unterschiedliche Vorstellungen darüber, was die Technik leisten sollte. Der Wettstreit unter verschiedenen Browser-Entwicklern wurde gleichermaßen zu einem Innovationstreiber als auch zu einem Spaltpilz.

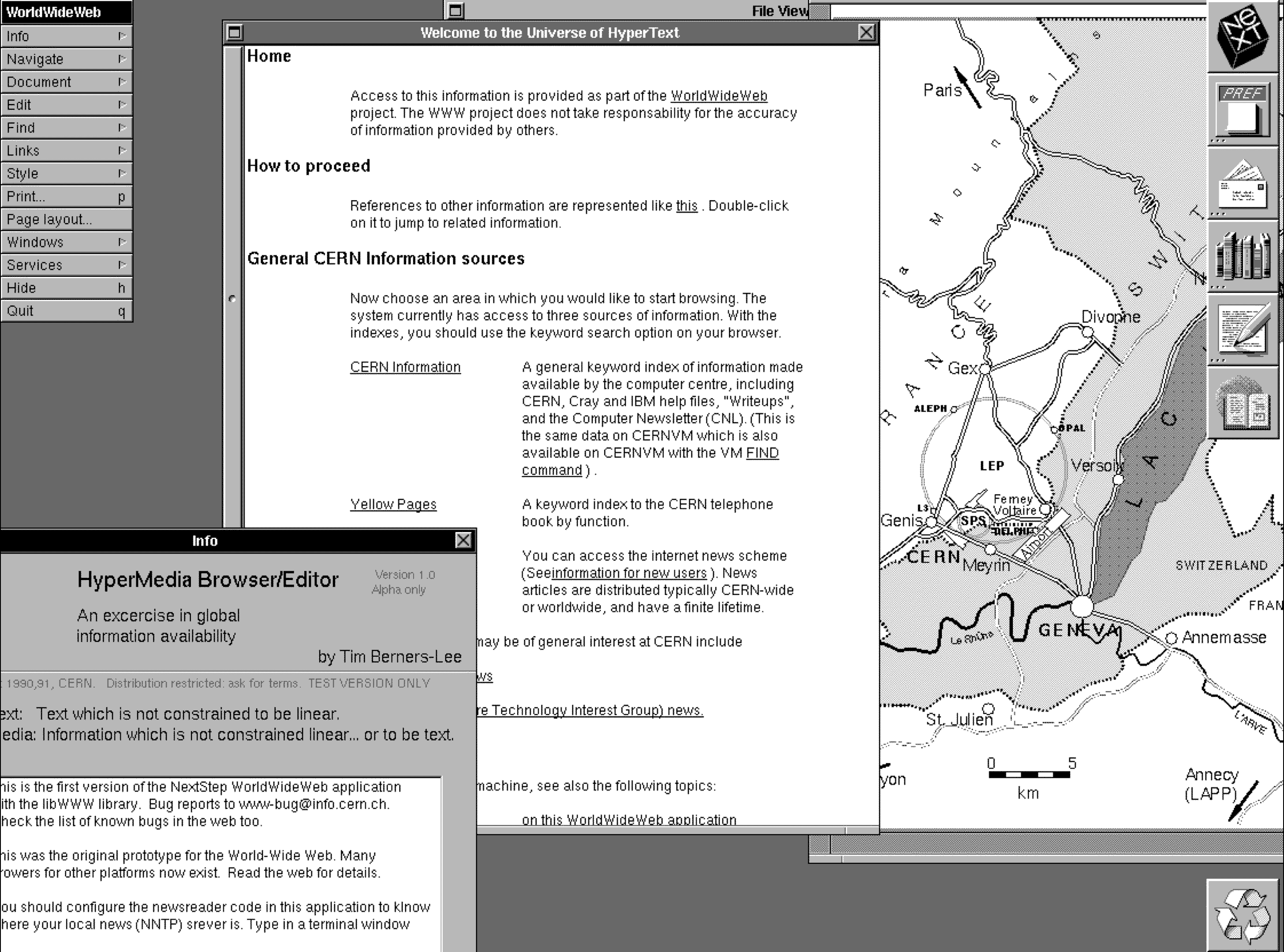

Die ersten Browser wurden am CERN entwickelt. Neben einem Browser für reine Textterminals war das vor allem der Browser “World Wide Web” von Tim Berners-Lee, von dem oben schon die Rede war. Er entwickelte die Software für NeXT-Computer, die ich Ihnen in meiner Geschichtserzählung bisher vorenthalten habe. Die Firma NeXT gehörte dem Apple-Mitgründer Steve Jobs, der bei Apple zwischenzeitlich in Ungnade gefallen war. Ende der 1990er Jahre kaufte Apple die Firma inklusive Jobs selbst und dem NeXT-Betriebssystem, das die Grundlage für Mac OS 10 darstellte.

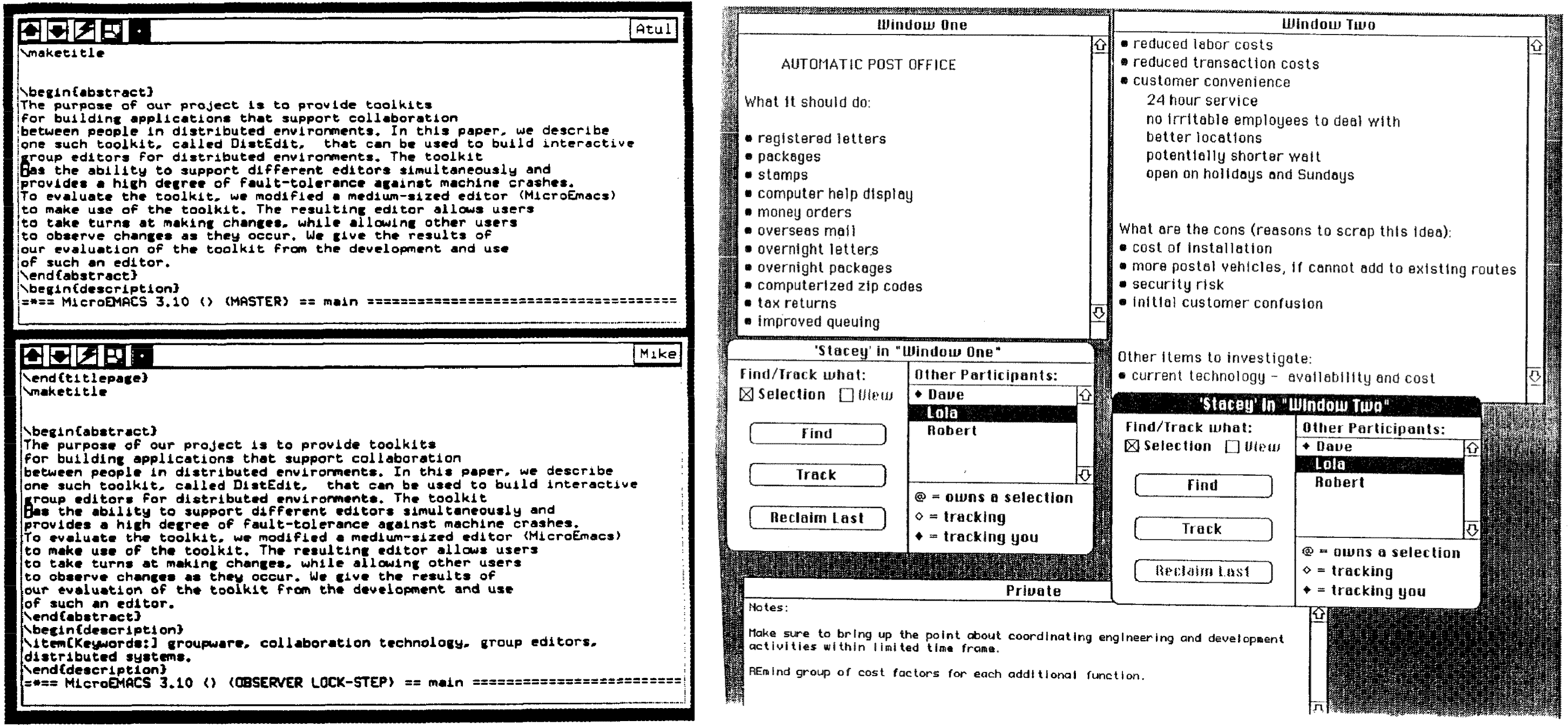

Hier sehen Sie den Browser “World Wide Web”. Zu sehen sind zwei Fenster mit Webinhalten, von denen eines ein Bild zeigt. Das Bild befindet sich in einem Extrafenster. Bilder als Teil des Textes konnte der Browser nicht anzeigen und HTML sah dies zunächst einmal auch gar nicht vor, was natürlich selbst für nüchterne wissenschaftliche oder wirtschaftliche Dokumente eine gehörige Einschränkung war. Sollten Bilder verfügbar gemacht werden, wurden sie einfach verlinkt und konnten dann durch Anklicken in einem neuen Fenster geöffnet werden.

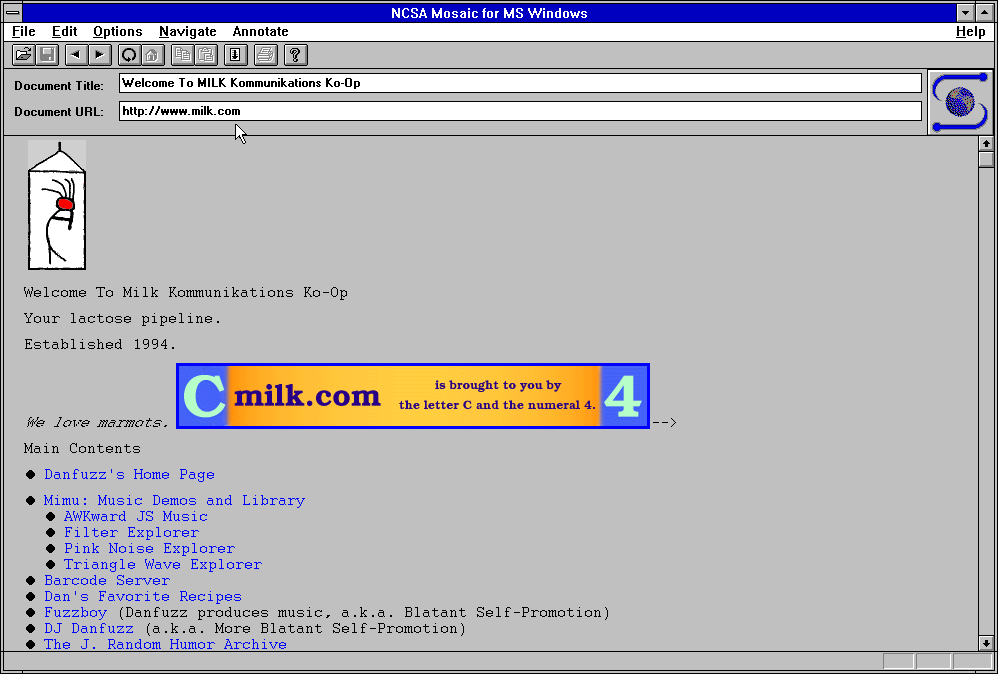

Nach einigen frühen Browserentwicklungen an Universitäten und Hochschulen, von denen die meisten für verschiedene Unix-Betriebssysteme entwickelt wurden, war der Browser NCSA Mosaic von 1993 derjenige, der für die frühe Popularität des WWW sorgte. Auch Mosaic war ein Universitätsprodukt, denn das National Center for Supercomputing Applications (NCSA) ist eine Organisation, die an der University of Illinois Urbana-Champaign angesiedelt ist. Die Software war allerdings nicht nur für Universitäten interessant, denn sie war einfach zu bedienen, einfach zu installieren und stand nicht nur für Unix, sondern auch für den Apple Macintosh und für Microsoft Windows zur Verfügung. Das herausragende Feature des Browsers war sicherlich die Anzeige von Bildern innerhalb des HTML-Dokuments. Persönlich sehr spannend finde ich aber eine Funktionalität, die in späteren Browsern gänzlich verloren gegangen ist und an der man die Herkunft von Mosaic im Wissenschaftsumfeld noch gut erkennen kann. Mosaic erlaubte es nämlich, Webdokumente mit Kommentaren zu versehen und das, wie im Folgenden beschrieben13, nicht nur persönlich, sondern auch in Arbeitsgruppen und sogar öffentlich.

Mosaic provides a mechanism whereby any piece of information on the Internet – in other words, any document that can be named by a URL – can be annotated with voice or textual comments. Such annotations are persistent across sessions and can themselves be annotated. There are several possible levels, or domains, of annotations: personal, workgroup, public, and global. Personal annotations are stored in the local file space of the user who makes the annotations and are visible only to that user. This is the default annotation domain.

Persönliche Anmerkungen wurden also lokal auf der Festplatte abgespeichert. Wollte man in einer Arbeitsgruppe Anmerkungen teilen, musste man sich einen entsprechenden Annotation-Server installieren.

Workgroup annotations are shared among a fairly small, fairly local group of people working together on a common problem. This is the type of asynchronous collaboration originally envisioned as a core capability of Mosaic. NCSA has developed a prototype workgroup annotation server that enables this type of collaboration. New annotations, if they are placed in the “workgroup domain” by the user making the annotation, are registered with the annotation server. Each time any member of the group accesses the annotated document, the annotation will then appear as a hyperlink virtually inlined – transparently merged, on the fly – into the bottom of the document.

Auch für allgemein-öffentliche Anmerkungen hatten die Programmierer von Mosaic Lösungen vorgesehen. Leider sind die entsprechenden Funktionalitäten nie wirklich zu Ende entwickelt worden. Die große Zeit des Browsers Mosaic war in der schnelllebigen Zeit des frühen Web wohl auch nicht lang genug, als dass sich ein solches Feature im größeren Sinne hätte durchsetzen können. Mehr auf Privatleute und die allgemeine Wirtschaft ausgelegte Browser setzten andere Prioritäten.

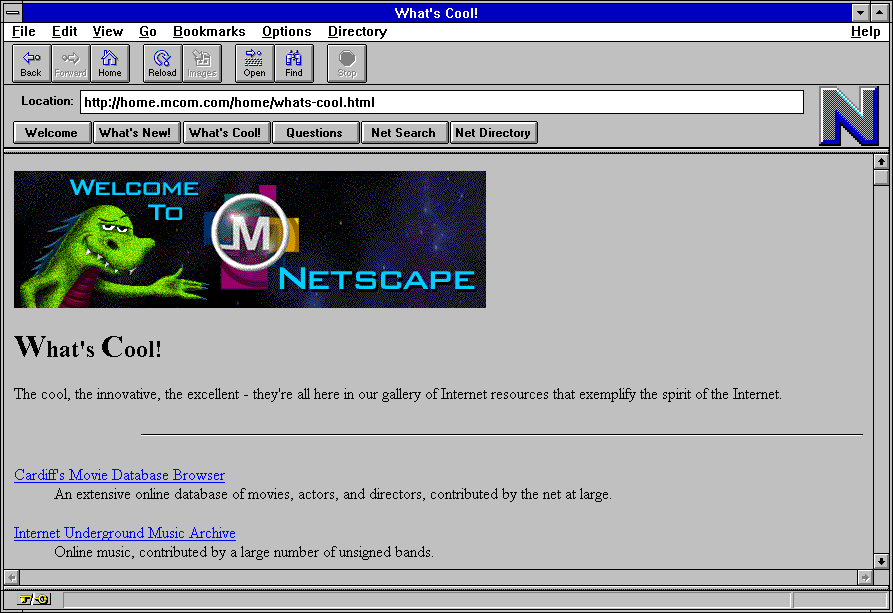

Im Jahr 1994 bereits erschien die erste Version des Netscape-Browsers14. Unter der Leitung von Marc Andreessen, einem der Hauptentwickler von Mosaic, wurde ein komplett neuer Browser entwickelt, der nun gar nichts mehr mit Universitäten zu tun hatte. Die Gestaltung der Nutzungsschnittstelle hatte höhere Priorität. Verwendet man mit den heutigen Nutzungsgewohnheiten Mosaic und Netscape15, kommt einem der Wechsel zu Netscape wie eine Offenbarung vor. Auf der Abbildung von Mosaic oben sehen Sie über dem Mauszeiger die Web-Adresse, die sogenannte URL. Was aussieht, wie eine auch heute noch bekannte Eingabezeile, ist gar keine. Es handelt sich um eine reine Ausgabe. Wenn sie eine Website öffnen wollen, müssen sie dies über das Öffnen-Menü tun und die Adresse dann ganz genau angeben, mit http:// vorweg. Ohne funktioniert es nicht. Beim Netscape dann hat die Adresszeile ihre heutige Funktionalität und auch andere heute selbstverständliche Features findet man, etwa die Möglichkeit, Lesezeichen anzulegen. Sehr prominent direkt als Button verfügbar (der 5. in der Buttonleiste) ist eine Funktion, die heute fast unverständlich wird: das Nachladen von Bildern.