Kleine Computer im Büro

Ende der 1970er und Anfang der 1980er Jahre spielte die elektronische Datenverarbeitung in vielen Firmen zwar bereits eine immer größer werdende Rolle, die Schreibtische in den Büros waren aber noch meist computerfrei. Die Ergebnisse von Computer-Auswertungen wurden meist in Papierform weiterverarbeitet. Wenn es eine interaktive Computernutzung gab, fand diese an Terminals statt, die mit einem firmeneigenen Großrechner oder einem leistungsstarken Minicomputer wie einer PDP-10 verbunden waren. Allenfalls eine Entwicklungsabteilung oder ein Labor hatte einen eigenen Minicomputer. Als Ende der 1970er Jahre mit dem Altair und der 1977-Dreifaltigkeit Computer für Bastler und Privatleute verfügbar wurden, entdeckte auch manch kleiner Betrieb die Technik für sich und optimierte seine Verwaltung durch den Einsatz eines kleinen Computers. Zuvor war für diesen Anwenderkreis ein Computer weit jenseits alles Finanzierbaren. Große Unternehmen, die seit langem große Rechenanlagen betrieben, sahen in den neuen, kleinen Computern indes keinen Sinn. Sie galten eher als Spielzeug denn als ernsthaftes Arbeitsgerät. Diese Einschätzung sollte sich bald ändern. Der Meinungswandel kam interessanterweise nicht durch bessere oder schnellere Hardware oder gar dadurch, dass die Firmenbosse Teil einer vorgeblichen Revolution sein wollten. Verantwortlich waren vielmehr einige wenige Software-Anwendungen, die für die kleinen Rechner verfügbar waren. Diese Programme allein rechtfertigten die Anschaffung der kleinen Computer für den Büroeinsatz.

Apple II und VisiCalc

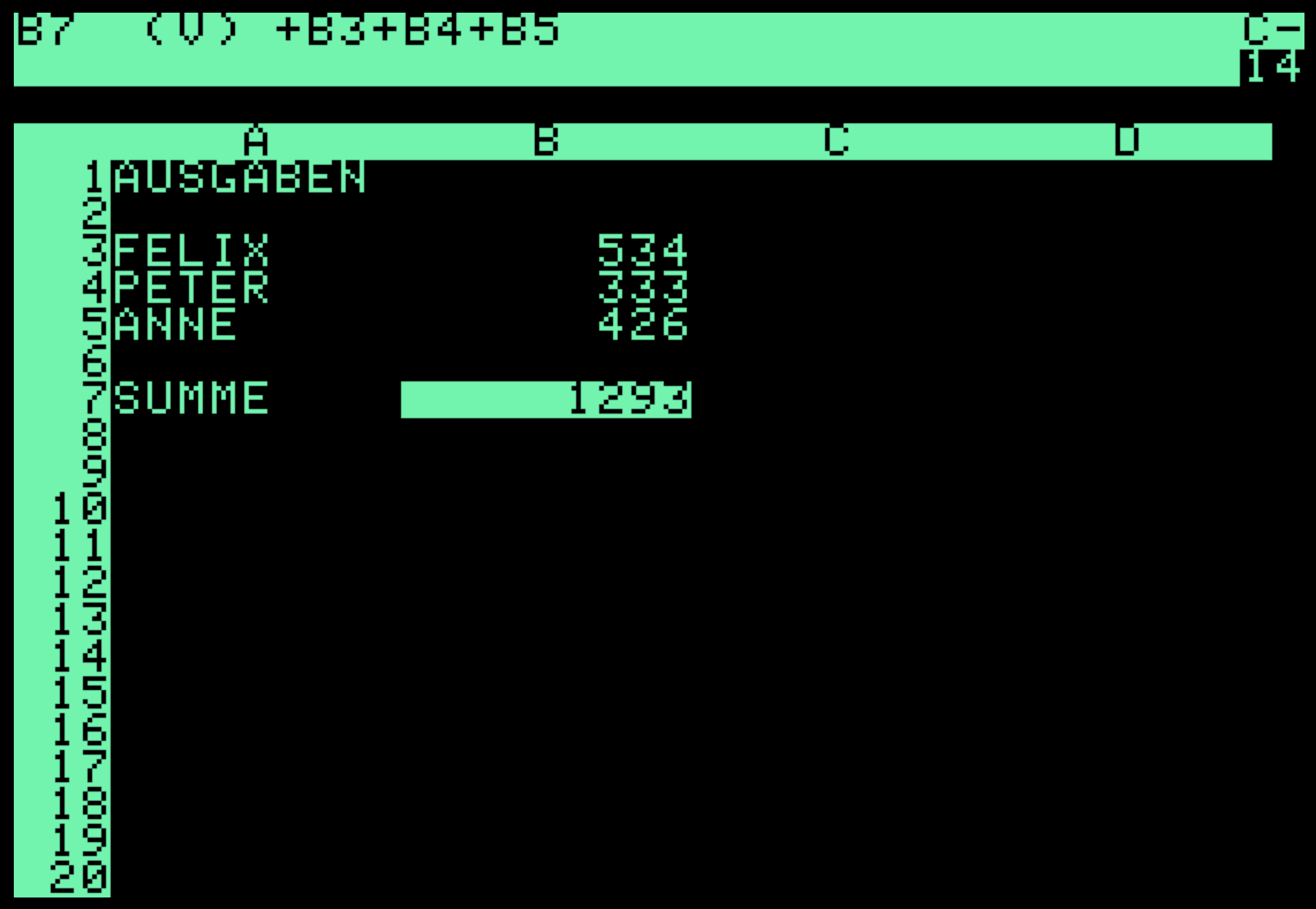

Das vielleicht wichtigste dieser neuen Programme, die es nur auf den neuen kleinen Computern gab, war das 1979 von Dan Bricklin und Bob Frankston entwickelte Programm „VisiCalc“. Bricklin bezeichnete das Programm seinerzeit als „a magic sheet of paper that can perform calculations and recalculations“. Es handelte sich um die erste Tabellenkalkulations-Software nach heutigem Maßstab. Schaut man sich die Software heute an, ist die Ähnlichkeit mit Excel von Microsoft bestechend. Nach dem Starten der Anwendung wird der Großteil des Bildschirms durch ein Tabellenblatt in Anspruch genommen. In die Zellen der Tabelle können Texte, Zahlenwerte oder auch Formeln eingetragen werden. Jede Zelle ist durch Angabe der Zeile (als Nummer) und der Spalte (als Buchstabe) identifizierbar und auch innerhalb von Berechnungen referenzierbar. Die Werte in einer Zelle können somit in Formeln genutzt werden. Werden die referenzierten Werte geändert, aktualisieren sich auch automatisch alle aus diesen Werten berechneten Zellinhalte. All das kennen Sie heute genau so aus Programmen wie Excel, LibreCalc oder Google Spreadsheets.

Das Herausragende an VisiCalc war nicht, dass Berechnungen angestellt werden konnten oder dass die Rechenergebnisse in Tabellenform präsentiert wurden. Auch andere Software-Produkte ermöglichten das. Das Überzeugende für die Nutzer war vielmehr die Interaktivität der Software. Am besten kann man sich das klarmachen, wenn man sich überlegt, wie eine einfache Berechnung mit und ohne VisiCalc durchgeführt werden konnte.

Sollte eine Berechnung wie die oben zu sehende mit einer klassischen Software auf einem Time-Sharing-System durchgeführt werden, mussten zunächst die Eingabedaten erzeugt werden. Dafür erstellte man eine Datei, in der die von den einzelnen Personen getätigten Ausgaben entsprechend einer festgelegten Notationsweise abgelegt wurden. In einer anderen Datei wurde nun definiert, wie die Daten zu verrechnen sind, hier also, dass eine Summe zu bilden ist. Auf der Kommandozeile startete man dann die Auswertungs-Software und erhielt, der Konfiguration entsprechend, etwa eine tabellarische Aufbereitung der Berechnung und des Ergebnisses. Sollte nun ein Wert geändert werden, musste die Datei mit den Eingabewerten bearbeitet und die Auswertung neu durchgeführt werden. Bei VisiCalc war es nun ganz anders: Sowohl Eingabewerte als auch Berechnungsvorschriften waren als Objekte am Bildschirm sichtbar. Sie konnten vom Nutzer selbst ohne Programmiereingriffe oder komplexe Editor-Operationen erstellt und angepasst werden, indem der Eingabefokus einfach auf die entsprechende Zelle gesetzt wurde. Sollten Änderungen gemacht werden, musste nur der Wert oder die Formel geändert werden. Alle abhängigen Werte aktualisierten sich sofort. Es mussten keine Programme geändert werden, es gab keine komplexen Codierungen und auch die „unfreundliche“ Kommandozeile musste nicht genutzt werden. Die einfache Änderbarkeit, die permanente Sichtbarkeit von Eingabe, Ausgabe und Verarbeitungsvorschriften und die schnelle Aktualisierung konnten gar nicht hoch genug eingeschätzt werden, ermöglichten sie doch Nutzungsszenarien, die vorher gar nicht denkbar waren. Bei Kreditberechnungen etwa konnte einfach mit Zinssatz und Rückzahlung gespielt werden. Die Änderungen wurden sofort sichtbar und erlaubten so ein exploratives Vorgehen, das bei der alten Lösung so mühselig gewesen wäre, dass es faktisch unmöglich war.

VisiCalc lief auf dem Apple II und zunächst auch nur auf diesem. Dass die Software gerade für diesen Computer entwickelt wurde, hatte offenbar wenig damit zu tun, dass er so besonders gut geeignet gewesen wäre. Mit einem Commodore PET oder einem TRS-80 wäre es sicher genau so gut gegangen. Bob Frankston entwickelte das Programm nur deshalb für den Apple II, weil auf dem Time-Sharing-System des MIT, das er für die Entwicklung nutzte, ein entsprechender Cross-Assembler zur Verfügung stand, der Maschinencode für den Apple II erzeugen konnte. Er konnte also komfortabel den leistungsfähigen Rechner zur Programmierung nutzen und dann das Programm auf dem günstigen Personal Computer ausführen.

Die Nutzungsschnittstelle von VisiCalc

Wenn man sich VisiCalc heute auf einem echten Apple II oder in einem Emulator ansieht, hat man sofort eine Vorstellung davon, wie es sich bedient. Die Art der Zellennummerierung und die Art und Weise, wie berechnet wird, ist in einem aktuellen Excel nahezu identisch. Probleme hat man allerdings wahrscheinlich erst einmal mit dem Bewegen des Cursors, was dem Umstand geschuldet ist, dass frühe Apple II nur zwei Tasten zur Cursor-Steuerung hatten. Man konnte mit ihnen folglich entweder nur horizontal nach rechts und links oder vertikal nach oben und unten steuern. Mit der Leertaste schaltete man in VisiCalc daher zwischen horizontal und vertikal um. Auf dem obigen Screenshot ist in der rechten oberen Ecke an dem Minus-Zeichen zu sehen, dass gerade der horizontale Modus aktiv ist. Die Eigenarten der Cursorbewegung in VisiCalc waren zwar seltsam, stellen einen Nutzer aber nicht vor allzu große Probleme. Größere Probleme bekam man aber, wenn man versuchte, eine Datei zu laden oder zu speichern, denn ganz im Gegensatz zum im Altair-Kapitel besprochenen WordStar zeigte VisiCalc dem Nutzer nur sehr unzureichend an, welche Optionen verfügbar waren. So spannend und innovativ die Software von der Funktionalität her war, so sehr war sie, was die Erschließbarkeit der Funktionen anging, ein Kind ihrer Zeit. Man musste die notwendigen Eingaben und Kommandos entweder kennen oder das Handbuch nutzen, um das Programm zu bedienen. Das Beispiel des Ladens einer Datei zeigt das gut:

Um eine Datei zu laden, musste man das Programm zunächst in den Kommando-Modus versetzen. Wie das ging, stand allerdings nirgendwo. Man musste wissen oder nachschlagen, dass man dazu / eintippen muss. Wenn man das getan hat, zeigte VisiCalc in der ersten Bildschirmzeile an, welche Kommandos eingegeben werden konnten. Man erfuhr, dass man B, C, D, F, G, I, M, P, R, S, T, V, W oder - wählen konnte – mehr nicht. Mit dieser Information war man aber natürlich nicht viel schlauer als vorher und musste wieder ausprobieren oder nachlesen. Tat man das, erfuhr man, dass man nun S für storing und dann L für load eingeben konnte, um eine Datei zu laden. Auch das Beenden hatten Bricklin und Frankston dem „Storing“ zuordnet. Der Befehl dafür lautete im Ganzen /SQ.

Dass Bricklin und Frankston ein so komplexes Programm wie eine Tabellenkalkulation auf einem doch relativ schwachbrüstigen Rechner wie dem Apple II realisieren konnten, ist nicht zu gering einzuschätzen. Tabellenkalkulationen sind heute so selbstverständlich, dass das Innovative an dem Konzept nicht mehr offensichtlich ist: Bei VisiCalc wurden Zahlen, Texte und Formeln in Zellen geschrieben. Die Daten waren damit nicht nur Werte in Variablen, die auf Anforderung ausgegeben werden konnten, sondern standen stabil am Bildschirm als räumlich manipulierbare und referenzierbare Objekte zur Verfügung. Änderungen an Zellen und Werten wurden nicht nur sofort angezeigt, anstatt erneut per Befehl zur Anzeige gebracht werden zu müssen, sondern auch alle anhängigen Zellen wurden automatisch aktualisiert. Das ganze angezeigte Blatt wurde komplett neu durchgerechnet und war folglich immer aktuell. Sie mussten nie eine Neuberechnung manuell anstoßen. VisiCalc bot also nicht nur räumliche Objekte, sondern erfüllte vor allem auch das Potenzial der Responsivität. Der Clou der Software lag in der Kombination dieser beiden Potenziale. Dass die Informationen in den Arbeitsblättern in räumlich eindeutige, per Koordinaten ansprechbare und referenzierbare Zellen abgelegt wurden, erlaubte auch Nicht-Computerkundigen, Berechnungen zu „programmieren“, ohne eine komplexe Programmiersprache zu kennen oder gar wissen zu müssen, wie der Computer im Inneren funktioniert. Damit eine solche responsive Aktualisierung möglich war, mussten Bricklin und Frankston austüfteln, wie sie die Daten der Arbeitsblätter geschickt im Speicher ablegen konnten, um eine schnelle Neuberechnung und Aktualisierung zu erreichen, ohne dass die Neuberechnung für eine merkliche Verzögerung bei der Bedienung sorgen würde.

Dieses kleine Wunder in Sachen Interaktivität brauchte keinen leistungsstarken experimentellen Rechner in einem Labor, sondern lief auf einem „billigen“ Apple II mit 32 KB Arbeitsspeicher und auch nur auf diesem Gerät. Die teuren Time-Sharing-Systeme im Rechenzentrum hatten nichts Vergleichbares. VisiCalc allein war daher für manche Firma Grund genug, Apple IIs für den Büroeinsatz zu erwerben.

CP/M auf den Apple II – Der Computer im Computer

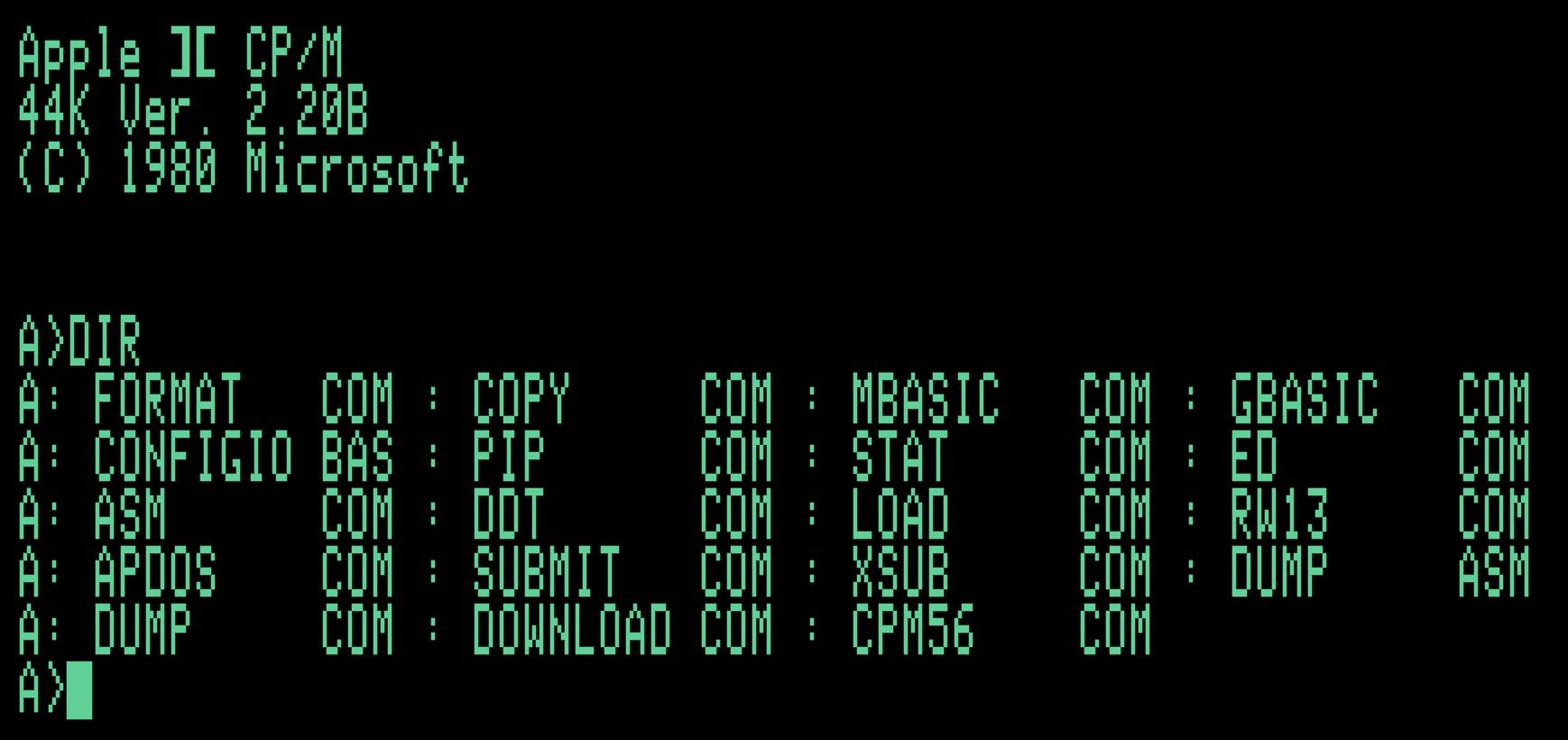

Im Kapitel über den Altair 8800 haben Sie WordStar kennengelernt. Auch diese Textverarbeitung war eine Anwendung, die die Anschaffung eines Computers für den Büroeinsatz rechtfertigen könnte, denn WordStar ermöglichte es einem Büroangestellten mit Personal Computer, einen Text selbst zu tippen und zu formatieren, ohne selbst eine Schreibmaschine nutzen zu müssen oder auf eine Sekretärin zuzugreifen, die ein aufgenommenes Diktat abtippt. WordStar wurde allerdings nicht für den Apple II, sondern für das Betriebssystem CP/M entwickelt. Dieses Betriebssystem lief aber nicht auf dem Apple II, denn dieser verfügte nicht über einen Prozessor, der zum Intel 8080 kompatibel war. Firmen, die Personal Computer für den Büroeinsatz anschaffen wollten, standen damit vor einem Dilemma. Für den Apple II gab es VisiCalc, aber die anderen attraktiven Programme – neben WordStar auch das Datenbanksystem dBase und viele Programmierumgebungen und Compiler – liefen unter CP/M.

Die Lösung dieses Problems kam von einer anderen Seite, als man es vielleicht vermuten würde. Techniker von Microsoft entwickelten eine als „SoftCard“ bezeichnete Einsteckkarte für den Apple II. Die Karte verfügte über einen eigenen zum Intel 8080 kompatiblen Zilog-Z80-Prozessor. Die restliche Schaltung auf der Einsteckkarte diente dazu, die Hardware des Apple II so „umzubiegen“, dass sie für den Prozessor der Karte wie ein typischer CP/M-Rechner wirkte. Es handelte sich gewissermaßen um einen Computer im Computer. Eingesteckt in einen Apple II ermöglichte die Karte also das Ausführen von CP/M auf einem Apple-Gerät. Ein entsprechend angepasstes CP/M und Microsofts BASIC-Interpreter wurden mitgeliefert (MBASIC.COM und GBASIC.COM auf dem Screenshot oben), sodass auch für den Altair oder andere CP/M-Rechner entwickelte BASIC-Software sofort auf dem Apple II lauffähig war. Zusätzlich ausgestattet mit einer Einsteckkarte, die auf dem Bildschirm achtzig Zeichen pro Zeile verfügbar machte und zusätzlichen Arbeitsspeicher bereitstellte, liefen nun auch WordStar und dBase auf dem Apple II. Die Erweiterungsoption blieb kein Nischenprodukt, sondern wurde massenhaft erworben. Die SoftCard war damit ein großer Erfolg. Im Jahr 1980 war sie Microsofts größte Einnahmequelle und durch die Karte und spätere Nachbauten wurde der Apple II der CP/M-Rechner mit der größten Verbreitung.

IBMs Weg zum Personal Computer

Mit dem Apple II und CP/M zogen die ersten Personal Computer in Büros und Unternehmen ein. Apple, Commodore, MITS (der Hersteller des Altair) und die anderen Hersteller von Personal Computern waren für die Firmenwelt genauso neu wie für Privatleute. Natürlich gab es auch vorher schon Computer in Wirtschaftsunternehmen, doch waren ganz andere Firmen in diesem Markt aktiv. Neben der Firma Digital Equipment (DEC) mit ihren beliebten Großrechnern und Minicomputern gab es etwa Computer von Bull, Nixdorf und vor allem vom Branchen-Primus IBM. Die Firma stand regelrecht synonym für große Rechenanlagen in Militär, Verwaltung und Universitäten. Unzählige Entwicklungen in der Computertechnik, wie Festplatten, Multitasking und Paralleles Rechnen gehen auf IBM-Erfindungen zurück oder wurden, wenn von IBM schon nicht erfunden, dann zumindest dort zur Marktreife gebracht. IBMs Computer waren vor allem große Rechenanlagen, aber auch Minicomputer waren im Angebot. Verbreitet war in den 1970er Jahren zum Beispiel der Minicomputer System/3 Model 6.

Ende der 1970er und Anfang der 1980er Jahre drangen nun die neuen Firmen mit kleinen, flexiblen Produkten in den angestammten Bereich von IBM vor. Es dauerte einige Jahre, bis IBM antwortete und seinen eigenen Personal Computer herausbrachte. Die populäre Computergeschichte stellt diesen Fakt, dass IBM erst vier Jahre nach Apple, Commodore und Tandy und sechs Jahre nach dem Altair 8800 einen Personal Computer im Angebot hatte, so dar, dass IBM kleinen Computern nichts abgewinnen konnte und nur große Rechner für beachtenswert hielt. Diese Darstellung wurde sicherlich noch vom Marketing der Firma Apple unterstützt. Im Rahmen der Einführung des Apple Macintosh im Jahre 1984 etwa behauptete Steve Jobs:

In 1977, Apple, a young fledgling company on the west coast invents the Apple II, the first personal computer as we know it today. IBM dismisses the personal computer as too small to do serious computing and unimportant to their business.

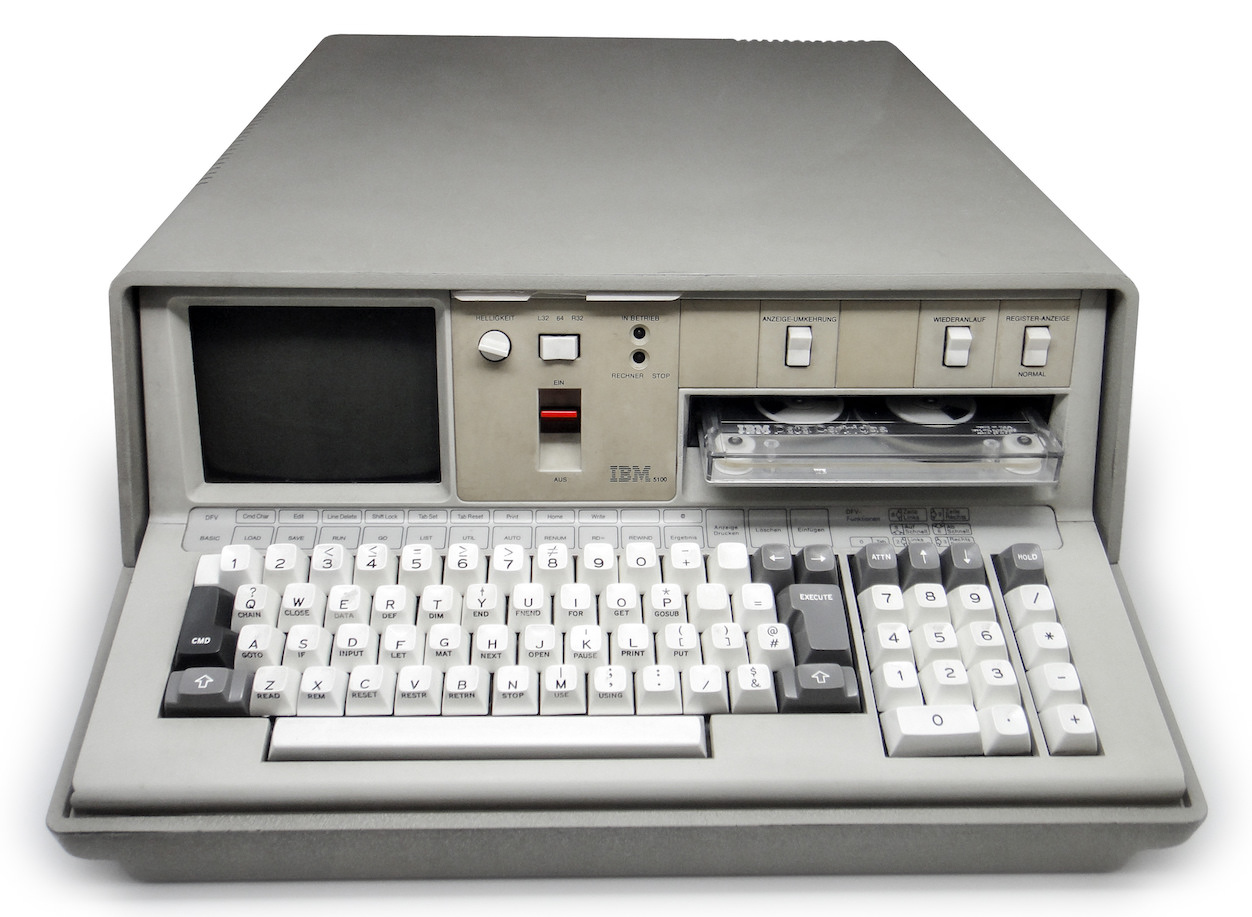

Hier ist wohl Steve Jobs’ typisches „Reality Distortion Field“ am Werke gewesen7. IBMs vermeintliche Geringschätzung kleiner Computer fand ihren Eingang in manches Buch und manche Dokumentation. Ganz so einfach war es aber nicht. In der Tat hatte IBM mit seinen Computern nicht die Privatperson im Blick. IBM baute Computer für Firmen, keine Heimcomputer. Das hieß aber nicht, dass man keinen Sinn in einem kleinen Computer sah. Das konnte schon deswegen nicht der Wahrheit entsprechen, weil IBM schon seit 1973 einen mobilen Computer entwickelte und diesen ab 1975 verkaufte. Dieser Computer, der IBM 5100, ist heute nahezu vergessen. Es handelte sich um einen tragbaren Computer mit einer ausklappbaren Tastatur, einem eingebauten Bildschirm und einem Bandlaufwerk für Daten und Programme. Warum IBM mit diesem Computer nicht der Marktführer bei den Personal Computern wurde, ist natürlich letztendlich teilweise Spekulation, doch liegen einige Gründe nahe.

Unter anderem war der Rechner mit 16.000 Dollar (in 2021er Kaufkraft entsprechend 79.800 Dollar) extrem teuer. Eine wichtige Rolle spielt meiner Ansicht nach aber auch die Software, bzw. das Fehlen derselben. Als um die Jahre 1979 und 1980 herum die ersten Personal Computer Einzug in die Firmenwelt hielten, hatte sich diese neue Rechnergattung weniger in der Hardware, sondern vor allem durch Software wie VisiCalc, WordStar und Co. von früheren Rechnergenerationen emanzipiert. Rechner wie ein ausgebauter Altair 8800 mit Diskettenlaufwerk, Terminal und CP/M, ein Commodore PET, ein Apple II oder TRS-80 waren keine reinen Fortführungen der Geräte der 1960er und 1970er. Es handelte sich nicht um abgespeckte, verkleinerte Großrechner und auch nicht um billigere Minicomputer, sondern um ein neues Konzept kleiner, autarker Rechner auf der technischen Grundlage von Mikroprozessoren, mit eigener Software und eigenen Nutzungsweisen.

Der 5100 war kein solcher Rechner. Er war ein kompakter, mobiler Computer, der Programme für IBM-Minicomputer und IBM-Mainframes ausführen konnte. Damit das möglich war, baute IBM Interpreter für die Programmiersprachen APL und BASIC ein. Mittels Schalter konnte zwischen den beiden Programmiersprachen umgeschaltet werden. Der APL-Compiler entsprach dem der System/370-Großrechner und der implementierte BASIC-Dialekt wurde auch auf den System/3-Minicomputern verwendet.

IBM hatte 1975 beim 5100 also eher einen Einzelnutzer-Mini-Großrechner im Angebot als einen Personal Computer. Dabei blieb es aber nicht, denn auf den 5100 folgten eine ganze Reihe weiterer Rechner. Betrachtenswert war der System/23 Datamaster. Dieser ab dem Juli 1981 verkaufte Computer war ein Schreibtischrechner mit zwei integrierten Diskettenlaufwerken. Das Gerät konnte mit vielen bürotypischen Anwendungen wie Buchhaltungssoftware und Textverarbeitung ausgestattet werden. Der Datamaster war IBM-typisch teuer und zielte auf die typische IBM-Kundschaft, also auf Firmenkunden ab. Im Fokus standen allerdings nicht die Unternehmen mit einem großen Rechenzentrum, sondern vor allem kleine Firmen ohne Erfahrung mit elektronischer Datenverarbeitung. Der Rechner wurde mit einer sehr gut verständlichen Anleitung ausgeliefert und Software wurde so gestaltet, dass sie ohne komplizierte IT-Begrifflichkeiten auskam. Diesen Computer könnte man durchaus Personal Computer nennen. Mit einem Preis von 9.000 Dollar, was inflationsbereinigt auf das Jahr 2021 über 26.500 Dollar entspricht, war das System allerdings weit teurer als typische Personal Computer, und mit der Möglichkeit, zwei Nutzer an zwei Konsolen gleichzeitig zu bedienen, gingen die Möglichkeiten des Systems über das hinaus, was man üblicherweise einem Personal Computer zuschrieb. Der Datamaster blieb einige Jahre im Angebot von IBM, wurde aber bereits einen Monat später vom IBM 5150, dem „IBM Personal Computer“ in den Schatten gestellt.

Der IBM PC und ein Betriebssystem von Microsoft

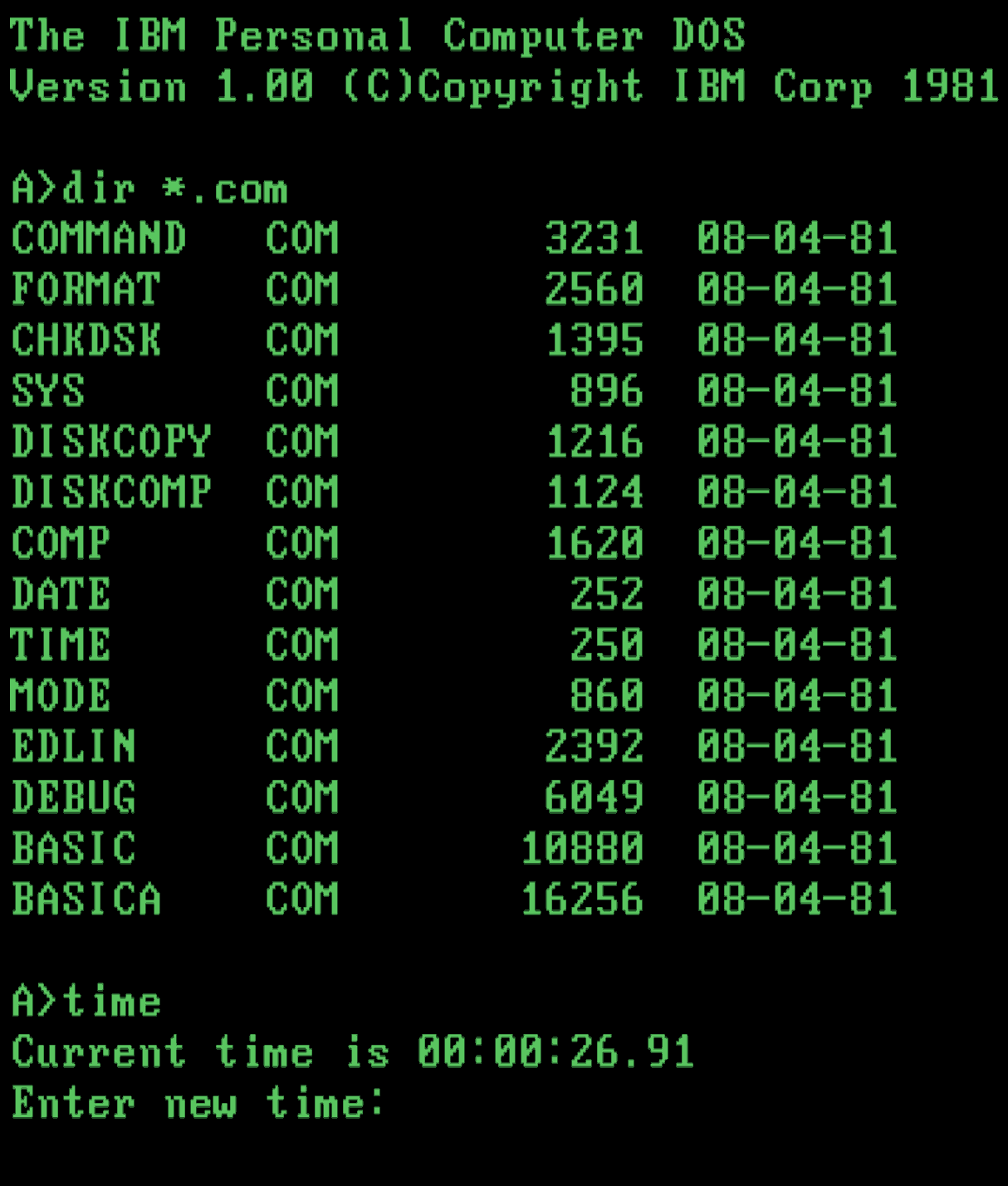

Im August 1981 war es soweit: IBM brachte den Rechner „IBM 5150 Personal Computer“ auf den Markt, der den Begriff „Personal Computer“ prägte und dessen direkte Nachfolger heute noch genutzt werden. Fast jeder PC, den Sie heute kaufen können ist ein Rechner, der zu diesem Ur-PC kompatibel ist. Sie könnten den Rechner im Prinzip also mit dem ursprünglichen DOS starten und die Software von 1981 laufen lassen. Von 2006 bis 2020 verwendeten auch alle Apple Macintoshs diese Architektur.

Vergleicht man die technischen Daten des 5150 mit denen typischer Computer der damaligen Zeit, erscheint er nicht besonders herausragend. Als Prozessor kam ein Intel 8088 zum Einsatz. Dieser arbeitete intern mit 16-Bit-Daten, hatte aber einen 8-Bit-Daten-Bus. Um 16 Bit aus dem Speicher zu lesen, musste der Prozessor also zwei Ladevorgänge durchführen. Intel hätte auch einen 8086 mit 16-Bit-Daten-Bus nehmen können. Dann wäre der Speicherzugriff schneller, der Speicher allerdings auch teurer gewesen. Der 8088-Prozessor verwendete eine Adresslänge von 20 Bit. Da jede Adresse 8 Bit Daten bezeichnete, was einem Byte entspricht, hätte der IBM PC also theoretisch 220 Bytes, also 1 MB Arbeitsspeicher adressieren können. Kaufte man 1981 allerdings einen PC, war dieser bei Weitem nicht so gut ausgebaut. Man konnte den Rechner mit 16 KB oder mit 64 KB bestellen. Eine Erweiterung war zwar bis 640 KB möglich, aber natürlich auch sehr teuer.

Man konnte einen IBM PC seinerzeit gänzlich ohne Diskettenlaufwerk und ohne Betriebssystem erwerben und betreiben, denn in jeden IBM PC und dem Nachfolgerechner PC XT war ein Microsoft-BASIC direkt in die Hardware eingebaut. Schaltete man den Rechner ohne Diskettenlaufwerk oder ohne eingelegte Betriebssystemdiskette ein, startete automatisch das Cassette BASIC von Microsoft. Es konnte also wie beim Apple II oder einem Commodore PET sofort mit dem Programmieren begonnen werden. Programme konnten mit dem eingebauten BASIC von Kassette gelesen und darauf gespeichert werden. Der PC verfügte dazu über eine Buchse auf der Rückseite, an die ein handelsüblicher Kassetten-Recorder angeschlossen werden konnte. Kaum jemand benutzte den Rechner jedoch so, denn für diese eingeschränkte Arbeitsweise war er viel zu teuer. Software für den Rechner wurde nahezu zu 100 % nicht auf Kassette, sondern auf Diskette angeboten. Die allermeisten ausgelieferten PCs verfügten daher über mindestens ein Diskettenlaufwerk. Zwei Laufwerke waren sehr verbreitet und vereinfachten die Bedienung des Rechners im Alltag. Auch die Diskettenlaufwerke des IBM 5150 waren im Vergleich zur Konkurrenz übrigens nicht sehr besonders. Das ursprüngliche Laufwerk, das die Disketten nur einseitig beschreiben konnte, brachte 160 KB auf einer Diskette unter. Zum Vergleich: Der Apple II konnte zu dieser Zeit schon seit einigen Jahren 140 KB auf einer Diskettenseite speichern. Man lag also etwa im gleichen Leistungsbereich.

Ein IBM PC war im Vergleich zu anderen Personal Computern vergleichsweise teuer. Die günstigste Variante mit 16 KB Arbeitsspeicher, CGA-Grafik (siehe unten) und ohne Diskettenlaufwerk kostete 1.565 Dollar (entsprechend 2021: 4.620 Dollar). Mit dieser Variante des Rechners konnte man allerdings fast nichts anfangen, außer eigene BASIC-Programme zu programmieren, zu speichern und zu laden. Das hätte man an anderer Stelle günstiger bekommen können. Ein voll ausgestatteter Rechner mit Betriebssystem, Diskettenlaufwerk und 64 KB Arbeitsspeicher kostete locker das Doppelte. Für Privatleute war dieser Rechner dann aber unerschwinglich und letztendlich wohl auch nicht gedacht, denn der Zielmarkt von IBM waren seit jeher Wirtschaftsunternehmen, die die Firma seit Langem kannten und auch vor allem für IBMs Wartungsverträge schätzten.

Zur Business-Ausrichtung des IBM PCs passten auch die weiteren technischen Eigenschaften. Der Rechner hatte zum Beispiel keine nennenswerte Klangausgabe. Es gab zwar einen Lautsprecher, doch dessen Aufgabe war es eher, bei einer fehlerhaften Eingabe zu piepsen. Im Grafikbereich gab es zwei Ausstattungsmöglichkeiten. Bei der Verwendung eines „Monochrome Display Adapters“, kurz MDA, konnte der Rechner nur Text in zwei Helligkeitsstufen darstellen. Auf dem verwendeten Monitor entstand dabei ein scharfes, nicht flackerndes Bild mit einer guten Zeichendarstellung in grüner oder bernsteinfarbener Schrift auf schwarzem Grund. Die MDA-Karte bot auch eine Schnittstelle zum Anschluss eines Druckers, der natürlich auch im Firmenumfeld wichtiger war als zu Hause. Die Alternative zum MDA-Adapter war die Verwendung eines Color Graphics Adapters, kurz CGA. Auch der CGA-Adapter erlaubte die Darstellung von 80 Zeichen pro Textzeile. Die Zeichendarstellung war hier allerdings ein wenig gröber. Dafür verfügte der Textmodus über sechzehn Farben, die, ganz im Gegensatz zum Apple II, auf entsprechenden Monitoren gut lesbar dargestellt werden konnten. CGA-Grafik verfügte natürlich auch über echte Grafikmodi: 640 x 200 Pixel konnten monochrom und 320 x 200 Pixel bei vier Farben8 dargestellt werden. Leider hatte sich IBM hier für sehr ungeschickte Farbpaletten entschieden. Wirklich schöne Grafik war in CGA daher nicht möglich und für Spiele war ein IBM PC mit CGA-Ausgabe sicher nicht ideal. Natürlich gab es Spiele für den IBM PC mit CGA-Grafik. Eine wirkliche Plattform für Spiele im Heimbereich wurde der PC allerdings erst Jahre später.

Ein Betriebssystem muss her!

Für einen gut ausgestatteten IBM PC mit einem oder zwei Diskettenlaufwerken brauchte es ein Betriebssystem. Beim Datamaster im gleichen Jahr war noch ein BASIC-Interpreter mit integrierten Befehlen für das Diskettenhandling die Hauptinteraktionskomponente. Beim PC entschied man sich für ein von einer Programmierumgebung unabhängiges Betriebssystem. IBM hatte kein Betriebssystem für den Rechner, entwickelte es aber auch nicht selbst, sondern lizenzierte ein System von Microsoft, das Microsoft eigentlich selbst auch noch gar nicht hatte. Der Programmierer Tim Patterson hatte ein Betriebssystem für die 8086er-Linie von Intel-Prozessoren entwickelt und sich dafür die Bedienweise und einige der zentralen Konzepte bei CP/M von Digital Research abgeschaut. Sein Betriebssystem 86-DOS sah CP/M zum Verwechseln ähnlich. Viele der von CP/M bekannten Befehle funktionierten auch unter dem neuen Betriebssystem. Die Ähnlichkeit der Systeme bestand auch auf der Architekturebene, was bedeutete, dass CP/M-Programme relativ leicht auf 86-DOS übertragen werden konnten. Microsoft kaufte das Betriebssystem und lizenzierte es unter dem Namen PC-DOS an IBM. Viele, teils in sich widersprüchliche, Geschichten ranken sich darum, wieso IBM ein Betriebssystem von Microsoft orderte und nicht auf das etablierte CP/M von Digital Research zurückgriff. Je nach Einstellung erschien dann Bill Gates von Microsoft als der gerissene Geschäftsmann, der seine Konkurrenz mit einem schlechten Produkt aus dem Markt drängte, oder aber es wird behauptet, dass Gary Kildall von Digital Research die IBM-Verantwortlichen habe sitzen lassen und daher selbst schuld gewesen sei, nicht zum Zuge gekommen zu sein. Lesen Sie diese Geschichten gerne an anderer Stelle nach, aber glauben Sie nichts von dem, was Sie da lesen, denn fünf verschiedene Erzählungen geben sieben verschiedene Versionen der gleichen Geschichte wieder. Die Wahrheit ist kaum noch festzustellen, wahrscheinlich aber ohnehin viel langweiliger als die spannenden Geschichten.

Microsofts DOS wurde fortan mit jedem neuen IBM PC, der über ein Diskettenlaufwerk verfügte, vertrieben. Es gilt allgemein als Geniestreich von Microsoft, dass IBM seinerzeit nicht die exklusiven Rechte an dem Betriebssystem erhielt. Microsoft durfte es auch anderen Unternehmen lizenzieren und tat dies auch. Da der IBM-Rechner großteils aus Standardkomponenten bestand, kamen bald viele Klone (die sogenannten IBM-Kompatiblen) auf den Markt, auf denen DOS, dann unter dem Namen MS-DOS, lauffähig war.

Die Software macht den Unterschied!

Es ist bemerkenswert, dass die frühen Personal Computer zwar über Betriebssysteme verfügten, die stark der alten Fernschreiber-Bedienweise von Time-Sharing-Systemen entsprachen, der Siegeszug von Personal Computern in Büros aber auf einer Reihe von Anwendungen beruhte, die über diesen Kommandozeilen-Stil weit hinausgingen. Das war schon beim Apple II und bei den CP/M-Geräten so. Sowohl VisiCalc, Wordstar als auch dBase zeichneten sich dadurch aus, dass sie die Potenziale interaktiver Computersysteme zu einem weit höheren Grad erfüllten als das Betriebssystem, auf dem sie liefen. Alle drei Anwendungen boten ihren Nutzern eine räumliche Nutzungsoberfläche mit Objekten, die am Bildschirm dauerhaft dargestellt und an ihrem Anzeigeort bearbeitet werden konnten. Im Vergleich zu den Nutzungsoberflächen von heute wirken sie zwar altmodisch und kompliziert, doch war vieles von dem, was es heute gibt, hier schon angelegt. Sie stellten die alten Time-Sharing-Oberflächen mit Fernschreibern oder Glass-Terminals weit in den Schatten. Der IBM PC und sein Betriebssystem MS-DOS bzw. PC-DOS brachten in Sachen Nutzungsschnittstelle nichts Neues. Das Betriebssystem war sehr stark an CP/M angelehnt, was ja seinerzeit seine Eigenschaften vom Großrechner-Time-Sharing-System TOPS-10 geerbt hatte. Arbeiten mit dem Kommandozeilen-Interpreter von DOS fühlte sich daher an, wie die Nutzung eines Großrechners mittels Fernschreiber. Die Möglichkeiten der räumlichen Anordnung von Objekten am Bildschirm wurden nicht genutzt. Zwar konnte der Computer mit einer CGA-Grafikkarte im Grafikmodus betrieben werden und das im monochromen Modus sogar in für damalige Verhältnisse ganz ordentlicher Auflösung, das Betriebssystem und die meisten Anwendungen machten davon aber kaum Gebrauch. Grafikausgabe wurde in Spielen und in Anwendungen für die Darstellung von Inhalten verwendet, etwa für die Anzeige eines Diagramms in der Tabellenkalkulation „Lotus 1-2-3“.

IBM-Computer und die vielen günstigen Kompatiblen wurden in der Geschäftswelt ein großer Erfolg. Die populäre Business-Software aus der Apple-II- und CP/M-Welt wurde übertragen. VisiCalc, WordStar und Co. waren also auch unter DOS verfügbar. Im Laufe der Jahre wurden sie durch Konkurrenzprogramme verdrängt, die vor allem von der Grafikfähigkeit und von der Möglichkeit, den Rechner mit mehr Speicher zu bestücken, profitierten. WordStar blieb recht lange am Markt, bekam aber schon 1982 mit WordPerfect und 1983 mit Microsoft Word Konkurrenz. VisiCalc verlor schnell an Bedeutung. Microsofts erster Versuch einer Tabellenkalkulation namens „Multiplan“ konnte 1982 zwar noch nicht viele Anhänger finden, aber das 1983 erschienene Lotus 1-2-3 lief VisiCalc schnell den Rang ab. Es stand innerhalb kürzester Zeit genauso synonym für Tabellenkalkulation wie vorher VisiCalc und heute Excel. Das große neue Feature von Lotus 1-2-3 im Vergleich zu VisiCalc war vor allem, dass sich nun Diagramme und Business-Grafiken darstellen ließen.

Die Menge, der für den IBM PC verfügbaren Software wuchs in kurzer Zeit extrem an. Neben vielen Programmen aus dem Büro- und Firmenbereich standen natürlich schnell auch allerlei Entwicklungsumgebungen zur Verfügung. Eine Übersicht über alle nennenswerten Software-Produkte der frühen IBM PC-Zeit zu geben, führt an dieser Stelle natürlich viel zu weit. Es kann aber durchaus spannend sein, sich alte Software aus dieser Zeit exemplarisch anzuschauen. Natürlich wirkt ihre Nutzungsschnittstelle heute altmodisch, aber mitunter verfügte die alte Software über interessante Eigenschaften, die man sich heute wieder wünschen würde.

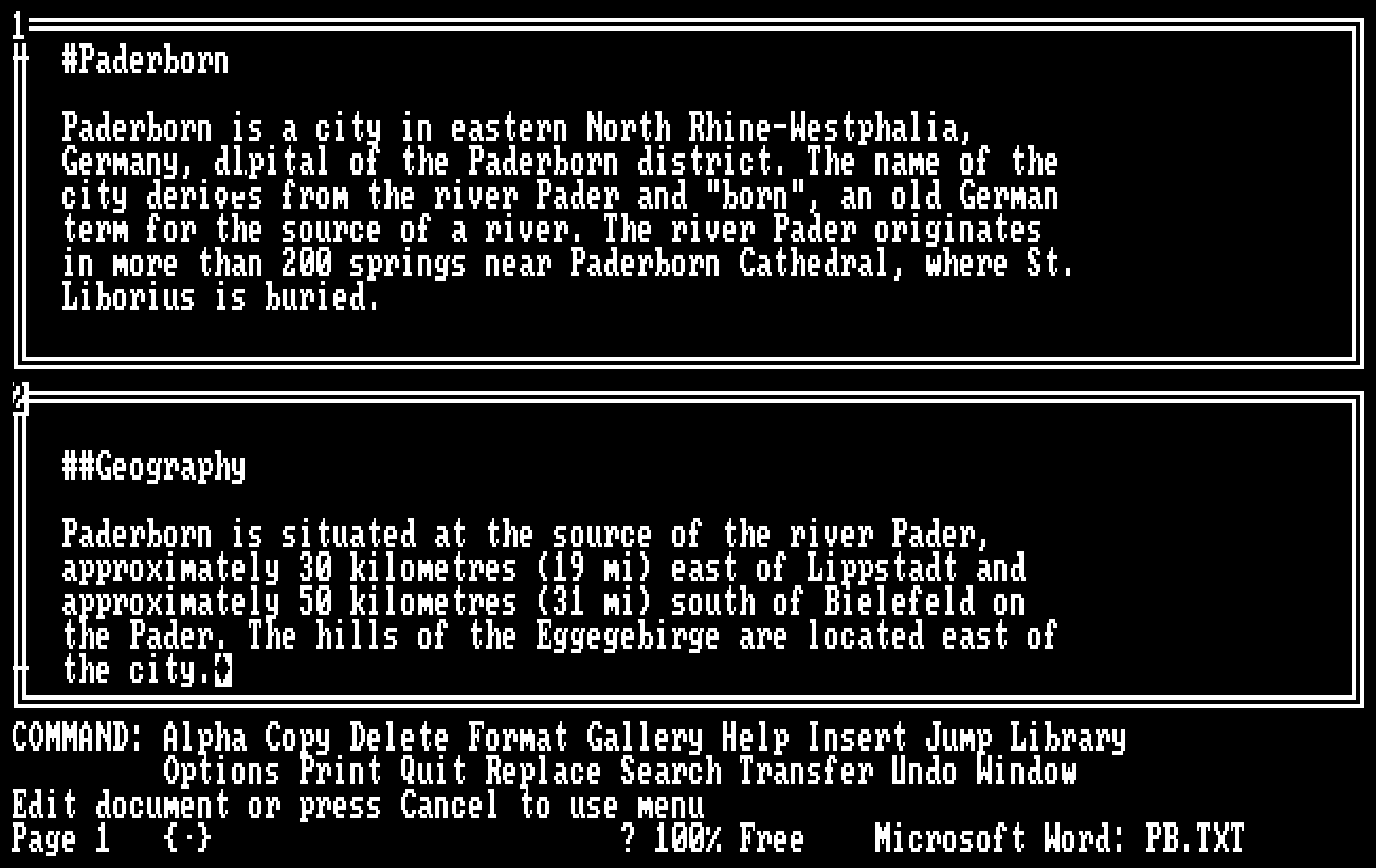

Als ein Beispiel für eine interessante Nutzungsschnittstelle schauen wir uns hier einmal die frühen Versionen von Microsoft Word an. Die erste Version von Word erschien 1983. Die Abbildung zeigt diese erste Version mit seiner sehr typischen Nutzungsschnittstelle. Von Version 1 bis 5 verwendete Microsoft für Word einen Design-Stil, den Microsoft als Standard-Schnittstelle für viele seiner Programme verwendete. Oben befand sich der Inhaltsbereich der Software. Hier sah man etwa den gerade zur Bearbeitung geöffneten Text. Am unteren Bildschirmrand befand sich stets ein Kommandobereich. Durch Drücken von ESC gelangte man in diesen Bereich. Alle hinter dem Wort „COMMAND:“ stehenden Worte entsprachen einer Funktion oder einem Untermenü. Aufgerufen werden konnte die Funktion oder das Untermenü durch das Eingeben des Anfangsbuchstabens. Um einen markierten Textblock zu kopieren, tippte man also ESC und dann C. Alternativ konnten die Kommandos auch ohne vorheriges Drücken der ESC-Taste mit einer Maus ausgewählt werden. Kaum jemand verfügte 1983 jedoch über eine Maus, die als Standard-Eingabegerät erst ein Jahr später mit der Vorstellung des Apple Macintosh überhaupt Verbreitung fand. Bis sie auch bei IBM PCs und Kompatiblen zum Standard gehörte, dauerte es noch bis in die 1990er Jahre.

Das Beachtenswerteste an den frühen Word-Versionen war nicht der Kommandobereich. Die Bedienung damit funktionierte und ermöglichte, sich die Funktionalität des Programms zu erschließen, war allerdings nichts wirklich Besonderes. Spannend waren aber einige Funktionalitäten der Software. Eine sehr interessante Funktion versteckte sich beispielsweise hinter „Window“. Hatte Microsoft zu diesem frühen Zeitpunkt schon Nutzungsschnittstellen mit Fenstern? Wie man auf der Abbildung sieht, erlaubte es Word in der Tat, den Bildschirm in mehrere Bereiche, die Microsoft „Fenster“ nannte, aufzuteilen und darin zum Beispiel verschiedene Dateien anzuzeigen. Das ist für sich genommen nichts Besonderes. Jede moderne Textverarbeitung bietet Ihnen diese Möglichkeit. Spannend ist aber, dass zwei Fenster dieser Art auch das gleiche Dokument anzeigen konnten. Die Abbildung oben zeigt in beiden Fenstern die gleiche Datei „PB.TXT“ an. Diese zwei Fenster im gleichen Dokument machen es möglich, in einem Bereich etwa den Anfang des Textes anzuzeigen, in dem man vielleicht ankündigt, was man alles schreiben möchte, während man im anderen Bereich weiter unten im Dokument schreibt und die gegebenen Versprechen erfüllt. Als ich bei einer Erkundung der alten Word-Version in einem Emulator diese Funktion fand, war ich begeistert. So eine Funktion hätte ich gerne in aktuellen Textverarbeitungen. Umso erstaunter war ich, denn ich fand diese Funktion auch in späteren Word-Versionen – und zwar in allen Versionen von Word bis zum heutigen Tage. Die Funktion ist aber bei Weitem nicht mehr so prominent und mir deshalb nie aufgefallen. Man findet sie in aktuellen Word-Versionen im Ribbon „Ansicht“ unter „Neues Fenster“ bzw. „Teilen“ und in älteren im entsprechenden Menü.

Ebenfalls sehr interessant waren die Funktionen zum Ausschneiden und Einfügen. Die entsprechenden Befehle hießen Copy, Delete und Insert, wobei Delete dem heutigen „Ausschneiden“ entsprach. Bemerkenswert war, was passierte, wenn man einen Block markiert hatte und dann Copy oder Delete aufrief. Man wurde nämlich aufgefordert, diesem Schnipsel einen Namen für das „Glossary“ (auf deutsch etwa „Textbausteine“) zu geben. Es gab also nicht wie heute eine einzige Zwischenablage, in der immer nur ein Inhalt vorhanden ist und bei der ein neuer Inhalt den vorherigen überschreibt, sondern eine richtige Sammlung von Text-Schnipseln, die verfügbar bleiben. Diese Schnipselsammlung konnte man in der Software einsehen und beim Einfügen konnten beliebige Schnipsel eingesetzt werden. Dafür musste man den vergebenen Namen kennen oder aus der Liste auswählen. Das Glossar, also die Schnipselsammlung, war im Gegensatz zur modernen Zwischenablage überdies auch nicht flüchtig. Es konnte unabhängig vom Dokument abgespeichert und dann bei der nächsten Nutzung der Textverarbeitung wiederverwendet werden. So eine Schnipselsammlung mit ihrer komplexen Logik des Kopierens und Einfügens, die viel mehr dem typischen Umgang mit Texten entspricht als der heutige von Apples „Lisa“ übernommene Umgang mit der Zwischenablage, würde ich mir in modernen Textverarbeitungen wünschen – und, oh Wunder, es gibt auch auch diese Funktionalität noch in modernen Word-Versionen (unter dem Namen „Schnellbausteine“). Sie hat allerdings inzwischen ihre Verbindung mit der Zwischenablage und ihren Operationen verloren.

Der PC als Heimcomputer?

Heute sind die allermeisten Computer, die man zu Hause hat und die nicht Smartphones oder Tablets sind, direkte Nachfahren des IBM PC. Zum damaligen Zeitpunkt am Anfang der 1980er Jahre war der IBM PC für den Heimanwender hingegen noch ziemlich uninteressant. Ein heimtauglicher Rechner musste günstig sein, vielleicht das Programmieren ermöglichen, er musste aber vor allem für Spiele geeignet sein. Mit guter Ausstattung war der IBM PC sehr teuer, aber trotzdem nicht sehr spieletauglich und mit schlechter Ausstattung war er immer noch teuer, dann aber in jeder Hinsicht völlig unattraktiv. Wer es auf Spiele abgesehen hatte, war mit einer der damals aufkommenden Spielekonsolen besser bedient, und wer einen Computer zum gelegentlichen Spielen, für eigene Programmierexperimente und für die gelegentliche Textverarbeitung nutzen wollte, konnte mit einem Apple II mehr anfangen. Interessant waren auch ein VIC 20 (in Deutschland unter dem Namen VC 20 verkauft) oder ein Atari 800. Diese beiden gehörten zur neuen Rechnerklasse der Heimcomputer, deren bekanntester Vertreter der Commodore 64, kurz C64, werden sollte, und die wir uns im kommenden Kapitel genauer anschauen wollen.