Grundlagen

In den ersten drei Kapiteln stellen wir den Ansatz und die grundlegenden Konzepte vor, von denen wir unsere konkreten Hinweise zur ergonomischen Gestaltung von Nutzungsoberflächen ableiten. Dabei werden wir auch den Begriff der Interaktion präzisieren. Diese Kapitel bilden die Grundlage für viele Gestaltungsempfehlungen, die wir hier aber noch nicht vertiefen. Wenn Sie in erster Linie an den praktischen Hinweisen interessiert sind, können Sie diese drei Kapitel überspringen und direkt mit der Praxis starten. Wir empfehlen Ihnen jedoch nachdrücklich, diese Kapitel zu lesen, denn damit werden nicht nur die praktischen Forderungen verständlicher, sondern auch allgemeingültig begründet. Mit diesem Wissen lassen sich die praktischen Beispiele nicht nur leichter erschließen, sondern es liefert auch den nötigen Hintergrund, um die jeweiligen Gestaltungshinweise auf Techniken und Anwendungsbereiche zu übertragen, die wir in diesem Buch nicht behandeln.

Differenzerfahrung und Artefaktgebrauch

Zum besseren Verständnis und zur kritischen Bewertung eines Werkes ist es hilfreich, die zugrundeliegende Sichtweise oder auch Philosophie der Autoren zu kennen. Sichtweisen beleuchten bestimmte Aspekte oder Phänomene, lassen dafür aber andere im Dunkeln. Dabei geht es nicht um einzelne Fakten oder Befunde, sondern um die Frage, welche als relevant oder dem Zweck angemessen ausgewählt und wie sie mit anderen in Beziehung gesetzt werden. Je nach Zwecksetzung und Sichtweise eröffnen sich unterschiedliche Zugänge, wobei oftmals mehr als eine Sichtweise hilfreich sind.

Im Bereich der Softwareergonomie stammen viele Theorieansätze aus der Psychologie. Der unsrige tut dies nicht, denn wir arbeiten nicht in der Psychologie, sondern in der Informatik oder, im weitesten Sinne, in der Technikentwicklung. Damit ist für uns auch der Gegenstand ein anderer: Nicht das Entwickeln theoretischer Grundlagen zum Verstehen menschlichen Handelns ist unser Erkenntnisziel, sondern die ergonomische Gestaltung von Software. Wir gehen deshalb sowohl in der Praxis als auch bei der Erarbeitung unseres konzeptuellen Rahmens von der physischen Umwelt des Menschen sowie der Anreicherung dieser Umwelt mit Geräten, Instrumenten und Formalismen aus. Dabei interessiert uns vor allem, welche ihrer Eigenschaften und Merkmale neue oder erweiterte Handlungsoptionen eröffnen (Potenziale) und welche sich als hinderlich oder gar belastend erweisen. Diese Kopplung zwischen menschlichem Denken1 und der Umwelt des Menschen steht für uns im Kern aller Überlegungen, denn schließlich sind Nutzungsschnittstellen eines Computers nichts anderes als technisch gestaltete physische Arbeitsumgebungen. Da es vorrangig um die Unterstützung geistiger Prozesse geht, sprechen wir in Analogie zum Werkzeugbegriff auch von Denkzeugen.

Der erste Teil unserer Grundlagen beschäftigt sich mit dem Konzept der Differenzerfahrung, mit dem wir die Brücke zwischen menschlichem Handeln und der Rolle von Denkzeugen schlagen. Das Konzept der Differenzerfahung dient uns seit vielen Jahren als Forschungsparadigma nicht nur hinsichtlich der Gestaltung von Nutzungsschnittstellen, sondern auch bei der hypothesengeleiteten Entwicklung von Softwaresystemen, angefangen bei der Entwicklung schulischer und universitärer Lehr-/Lernumgebungen über virtuelle Forschungsumgebungen bis hin zur Konzeption neuartiger Interaktionstechniken2. Mithilfe dieses Konzepts ist es uns gelungen, Potenziale von Denkzeugen zu identifizieren und darauf aufbauend Gestaltungskonzepte zu formulieren.

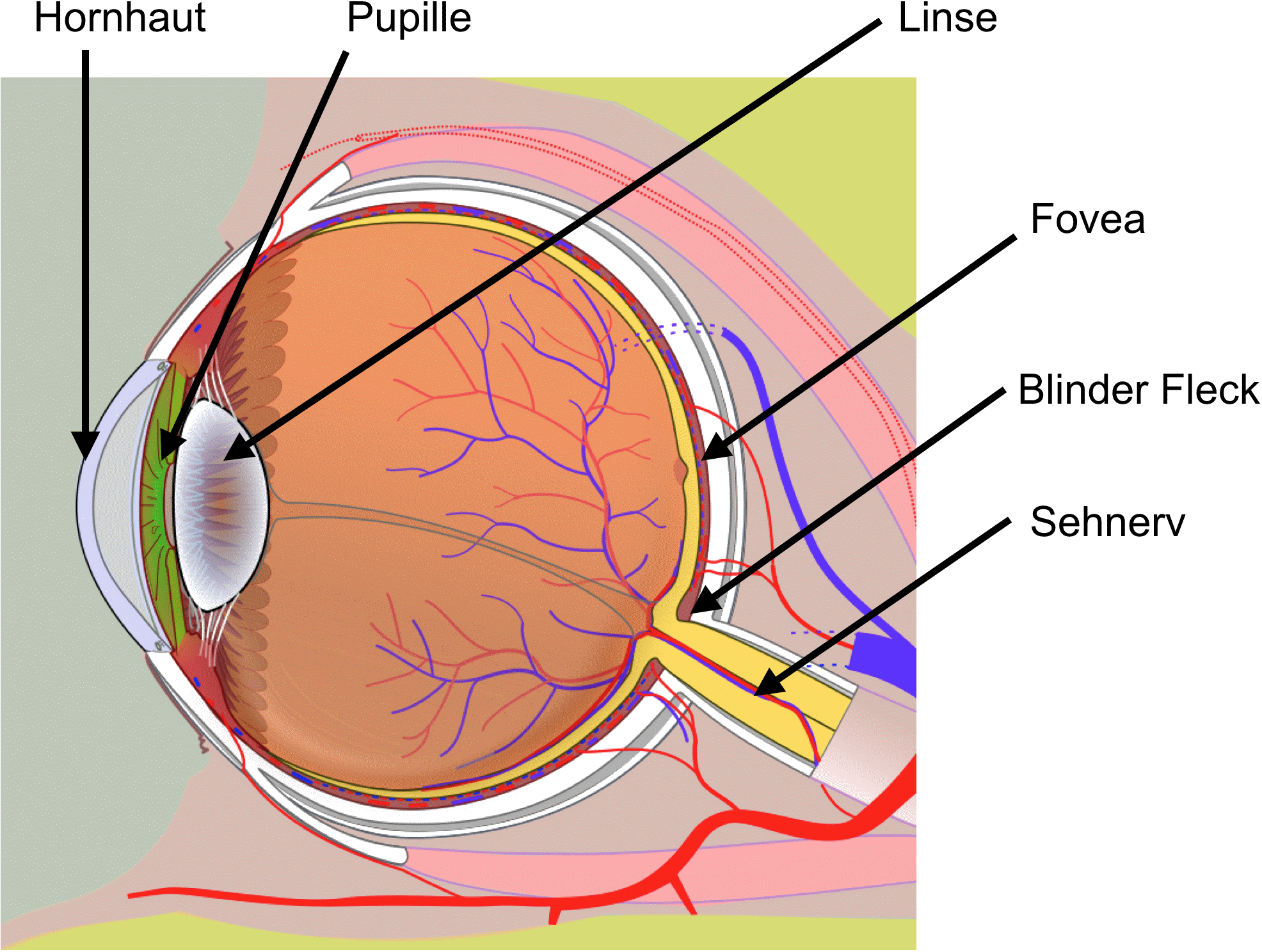

Differenzerfahrung braucht sinnliche Wahrnehmung. Wenn wir in diesem Buch von „Wahrnehmung“ sprechen, konzentrieren wir uns meist auf den Sehsinn. Das Sehen spielt nicht nur bei jeder Form von „Wissensarbeit“ eine entscheidende Rolle, sondern ist auch der wichtigste Sinneskanal bei der Gestaltung von Nutzungsschnittstellen, die trotz Siri, Alexa und Co. immer noch größtenteils visueller Natur sind und das wohl auch bleiben werden. Diesen Punkt greifen wir im Abschnitt Dialog in den Exkursen nochmals auf.

Kognition und Umwelt

Der Philosoph Ludwig Wittgenstein stellt in seinen „Philosophischen Untersuchungen“3 die Frage, ob es möglich sei, eine Annahme über eine realweltliche Gegebenheit durch pures Nachdenken und Erinnern zu bestätigen oder zu widerlegen. Wittgenstein zieht dazu unter anderem einen Fahrplan als Beispiel heran. Der leichteren Formulierbarkeit halber sei im Folgenden, wenn auch sicher nicht sehr realistisch, davon ausgegangen, dass ein Fahrplaneintrag für eine Verbindung zu einem bestimmten Zeitpunkt auch bedeutet, dass tatsächlich zu diesem Zeitpunkt ein entsprechender Zug fährt. Ein Fahrplan kann unter diesen Bedingungen herangezogen werden, um festzustellen, ob zu einem bestimmten Zeitpunkt ein Zug zu einem gewünschten Ort abfahren wird. Er kann dann insbesondere dafür genutzt werden herauszufinden, ob die Annahme einer Person tatsächlich stimmt, dass zu einem gewissen Zeitpunkt, sagen wir um 15 Uhr, ein bestimmter Zug abfährt. Dass der Fahrplan sich für eine solche Überprüfung eignet, liegt daran, dass sein Inhalt unabhängig von den jeweiligen Erwartungen einer bestimmten Person fixiert ist. Man kann, wie Wittgenstein es formuliert, „an eine unabhängige Stelle appellieren“, nämlich an den Fahrplan, um sich Gewissheit zu verschaffen.

Die „unabhängige Stelle“ ist in diesem Fall ein physisches Objekt, der gedruckte Fahrplan. Etwas selbst Vorgestelltes kann nicht zur Überprüfung herangezogen werden, denn etwas Vorgestelltes ist keine „unabhängige Stelle“, da es nicht unabhängig von der Person ist, die es sich vorstellt. Wittgenstein macht das deutlich mit der Frage, ob denn nicht das aus der Erinnerung wieder hervorgebrachte Bild eines Fahrplans zur Überprüfung der Annahme dienen könne und bentwortet diese Frage:

Nein, denn dieser Vorgang muss nun wirklich die richtige Erinnerung hervorrufen. Wäre das Vorstellungsbild des Fahrplans nicht selbst auf seine Richtigkeit zu prüfen, wie könnte es die Richtigkeit der ersten Erinnerung bestätigen? (Als kaufte Einer mehrere Exemplare der heutigen Morgenzeitung, um sich zu vergewissern, dass sie die Wahrheit schreibt.)

In eine ähnliche Richtung argumentiert der Psychologe J.J. Gibson. Auch er verweist auf die Unmöglichkeit einer nur mental vorgenommenen Überprüfung und richtet den Fokus auf die Frage, was eine Vorstellung von der Realität unterscheidet. Der entscheidende Unterschied liegt seiner Darstellung nach darin, dass nur bei einer Untersuchung von Gegebenheiten der Realität Neues und Überraschendes gefunden werden könne. Wenn man etwas untersucht, das man sich nur vorstellt, kann das Ergebnis nicht in diesem Sinne unerwartet sein, denn dieses Ergebnis entstammt ja der eigenen Vorstellungswelt.

An imaginary object can undergo an imaginary scrutiny, no doubt, but you are not going to discover a new and surprising feature of the object this way. For it is the very features of the object that your perceptual system has already picked up that constitute your ability to visualize it. The most decisive test for reality is whether you can discover new features and details by the act of scrutiny. Can you obtain new stimulation and extract new information from it? Is the information inexhaustible? Is there more to be seen? The imaginary scrutiny of an imaginary entity cannot pass this test.4

Diese Gedankengänge machen zunächst stutzig, denn man kann sich über Gegebenheiten und Konzepte ja durchaus länger Gedanken machen, ohne andauernd „an eine unabhängige Stelle zu appellieren“, also ohne ständige Rückversicherung gegen etwas außerhalb des Kopfes. Bei solchen mentalen Prozessen kann auch etwas aufscheinen, das einem vorher nicht bewusst war. Es gibt jedoch eine gewichtige Einschränkung dieses „Denkens im Kopf“. Auch wenn nicht jeder einzelne Denkvorgang einer Wahrnehmung der Außenwelt bedarf, ist nämlich nach einer gewissen Zeit die Rückversicherung zur Realität unerlässlich5.

Nun könnten Sie einwenden, dass man sich sogar vieles vorstellen und manches bedenken kann, das es in der Realität nicht gibt. Literarische Werke leben davon. Wenn ein Utopist eine Gesellschaft entwirft oder ein Kinderbuchautor über einen rosa Elefanten auf Rollschuhen schreibt, dann halten diese Gedanken, obwohl es sie in unserer Vorstellungswelt gibt, einer Überprüfung in der realen Welt nicht stand. Trotzdem stellen sie vielfältige Bezüge zu dieser Welt her. Die Welt der Utopie ist nicht real und höchstwahrscheinlich finden sich auch keine rosa Elefanten auf Rollschuhen in unserer Umwelt, aber die Versatzstücke, aus denen die jeweilige Vorstellung zusammengesetzt ist, existieren eben doch. Dies könnten etwa bestimmte Gesellschaftsformen oder technische Entwicklungen sein oder Elefanten und Rollschuhe bei der Kindergeschichte. Wären diese nie der Wahrnehmung zugänglich, dann wären sie auch dem Denken nicht zugänglich gewesen. Es gibt sie als Phantasiegebilde und man kann an sie glauben, aber solange sie nicht mittels Differenzerfahrung mit der Umwelt abgeglichen werden können, verkörpern sie kein Wissen über unsere Umwelt.

Ein Denken rein im Kopf ist mit einem Tauchgang vergleichbar. Taucher können die Luft für eine gewisse Zeit anhalten. Mit Übung oder einem Tauchgerät können sie die Zeit bis zum notwendigen Auftauchen zwar verlängern, aber sie müssen irgendwann wieder auftauchen, um zu atmen. Das Atmen entspricht der Differenzerfahrung, denn ohne fortwährenden Abgleich von Vorgestelltem und sinnlich Wahrgenommenem gibt es kein Wissen und keine Gewissheit. Wir gehen deshalb von der Annahme aus, dass Denken letztendlich nicht ohne Wahrnehmung stattfinden kann: „Das Denken findet nicht im Kopf, sondern mit dem Kopf statt!“.

Zusammengefasst: Differenzerfahrung bezeichnet den Prozess der kognitiven Anpassung des Menschen an seine Umwelt. Sie ermöglicht es, über ein Phänomen, einen Sachverhalt oder einen Gegenstand neue Informationen zu gewinnen und darüber Erwartungen zu bestätigen oder zu widerlegen. Essenziell dafür ist, dass die sinnlich wahrgenommenen Eigenschaften oder Veränderungen unabhängig von den eigenen Erwartungen sind. Differenzerfahrungen passieren unablässig – gewissermaßen ein kognitives Atmen –, um Vorstellungswelt und Realität abzugleichen. Wichtig für das Verständnis des Konzepts ist, dass der Begriff der Differenz auch die Bestätigung von Annahmen und nicht nur Unterschiede oder Abweichungen umfasst. Differenzerfahrung beschreibt also den Vorgang und die Notwendigkeit des Abgleichs, nicht sein Ergebnis.

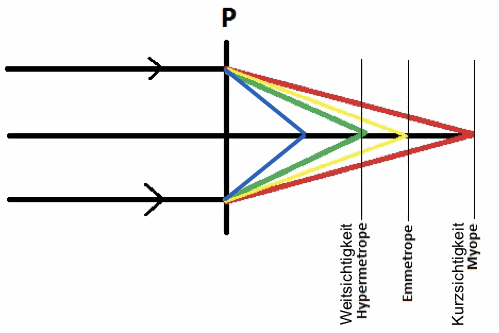

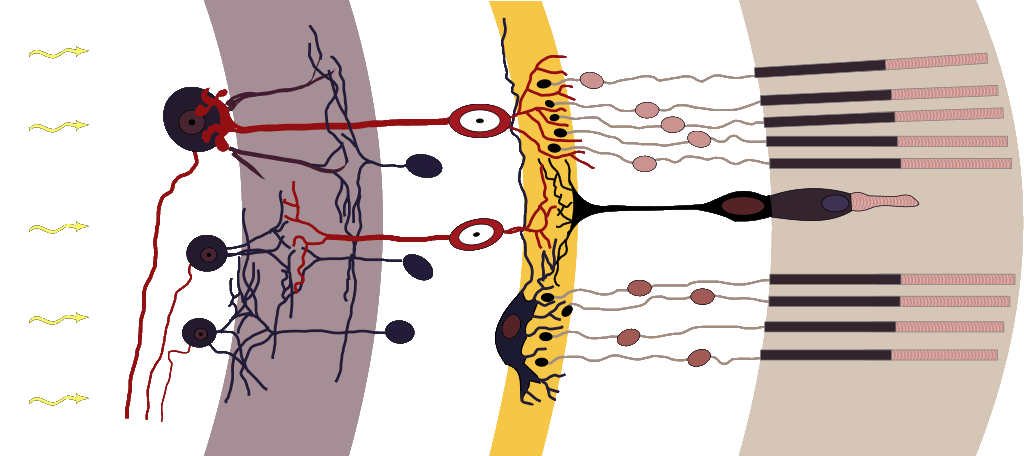

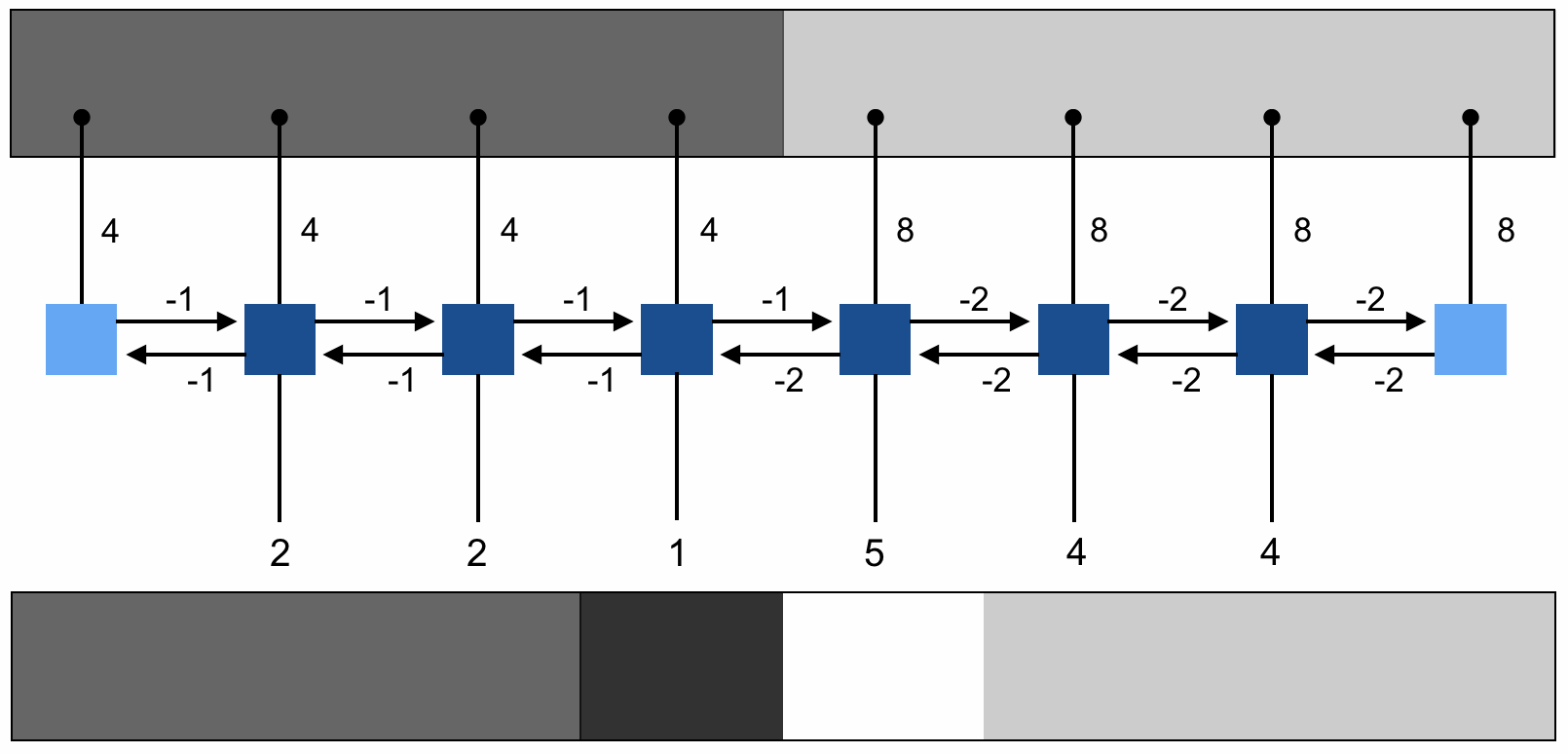

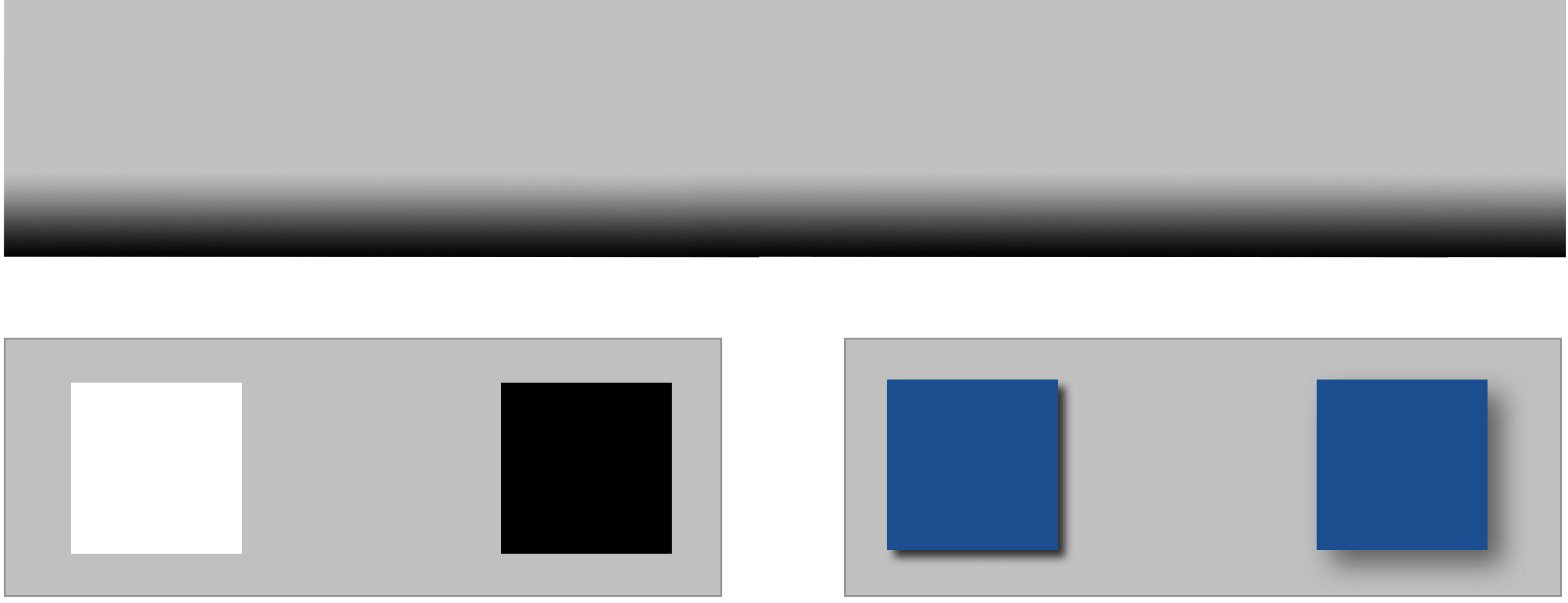

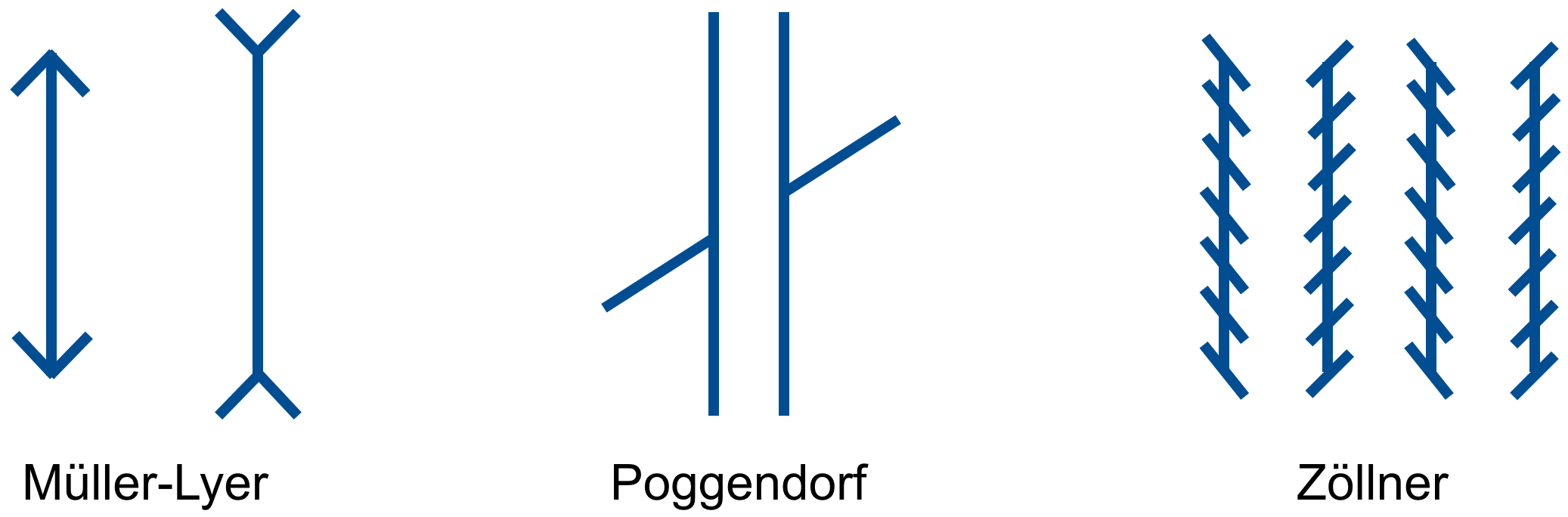

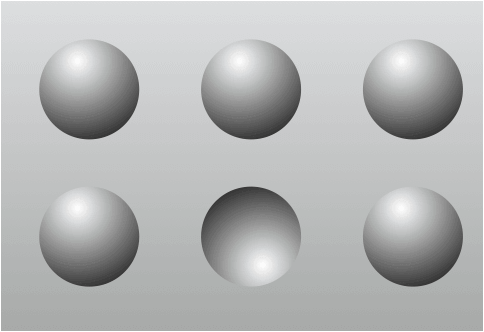

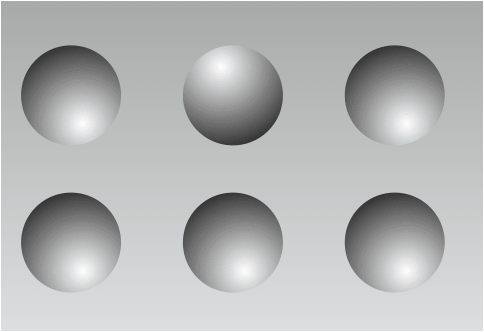

Der Kern von Differenzerfahrung, Hypothesen aufzustellen und diese mit der Realität abzugleichen, ist, wie wir im Kapitel Architektur der Wahrnehmung sehen werden, auch die Grundlage der menschlichen Wahrnehmung, denn das Wahrnehmungssystem kann nicht alle sensorischen Reize und Reizkombinationen auswerten, sondern ist auf Hypothesen angewiesen, die dann gezielt an einzelnen Punkten überprüft werden. Die auf diese Art gewonnene Schnelligkeit wird jedoch mit einem Verlust an Informationen bezahlt. Damit das nicht zu Unsicherheiten führt, ob denn auch die jeweils relevanten Wahrnehmungsreize aus der Umwelt aufgenommen wurden, muss diese Informationsreduktion sich in allen möglichen Wahrnehmungssituationen als verlässlich erweisen. Wahrnehmung ist kein statischer und passiver Prozess, sondern erfordert die Verschränkung kontinuierlichen Hypothesenbildens und aktiven motorischen Handelns. Im nächsten Abschnitt wollen wir anhand einiger einfacher Experimente verdeutlichen, wie eingeschränkt unsere Möglichkeiten zur Differenzerfahrung ohne mentale und physische Bewegung sind.

Persistente Objektarrangements

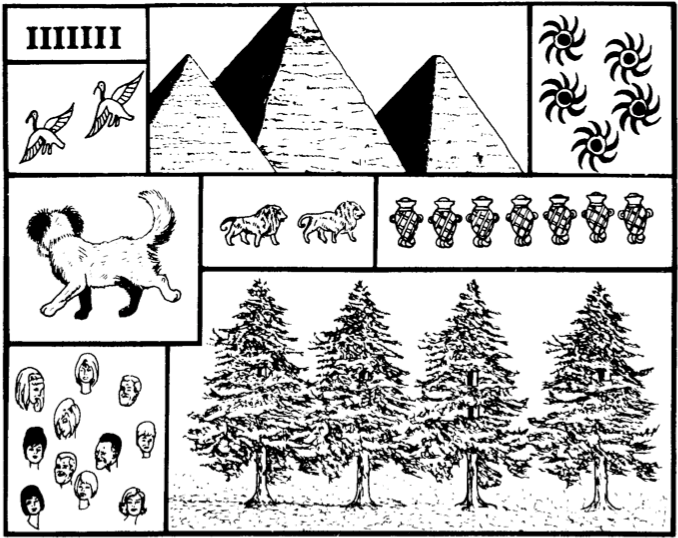

Für viele Differenzerfahrungen ist es notwendig, mehrere Objekte gleichzeitig ins Wahrnehmungsfeld zu bringen, um sie in Beziehung setzen zu können. Das gilt für einfache Vergleichsoperationen ebenso wie für das Zählen oder Ordnen. Zum Abgleich zwischen Vorstellung und Realität ist zudem meist ein stabiles und beständiges Umfeld erforderlich. Wir sprechen in einem solchen Fall von „Persistenz“. So mögen etwa Tiere, die auf der Weide wild durcheinanderlaufen, zwar stets zusammen im Wahrnehmungsfeld präsent sein, doch ist eine solche Herde kaum zählbar. Da die Tiere fortwährend ihren Platz wechseln, kann nicht ohne Weiteres verlässlich festgestellt werden, ob ein bestimmtes Tier schon gezählt worden ist oder nicht.6

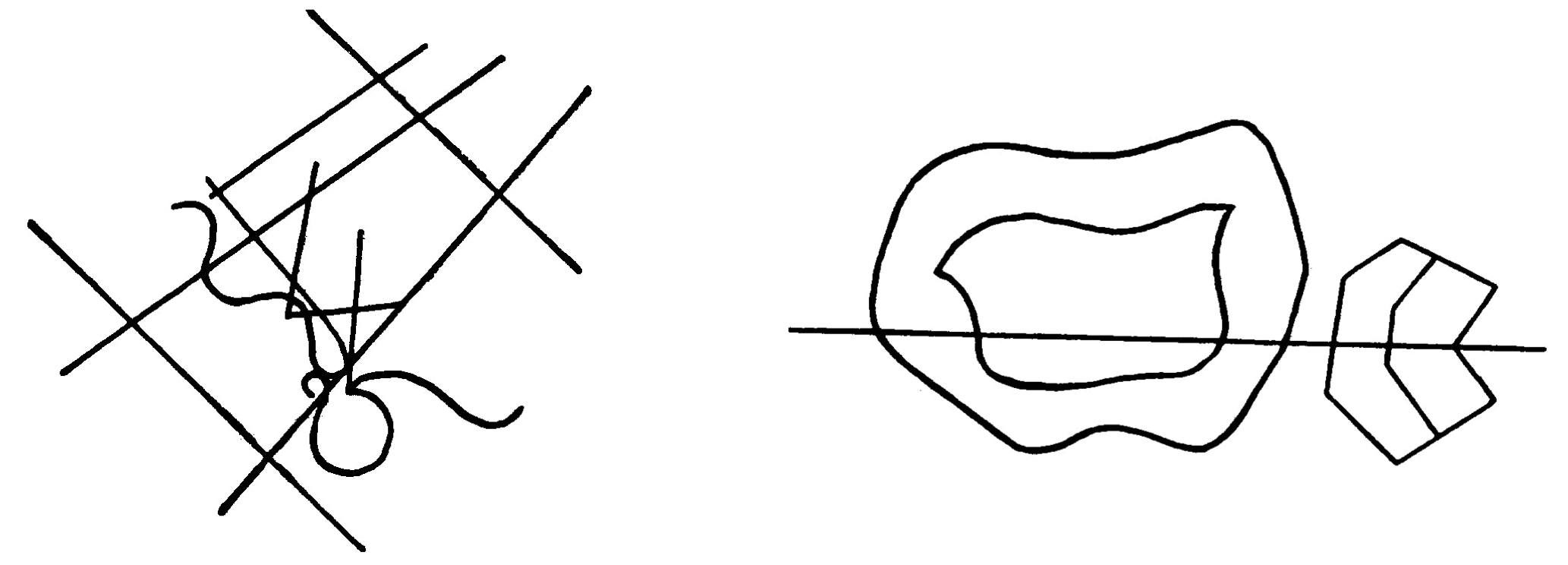

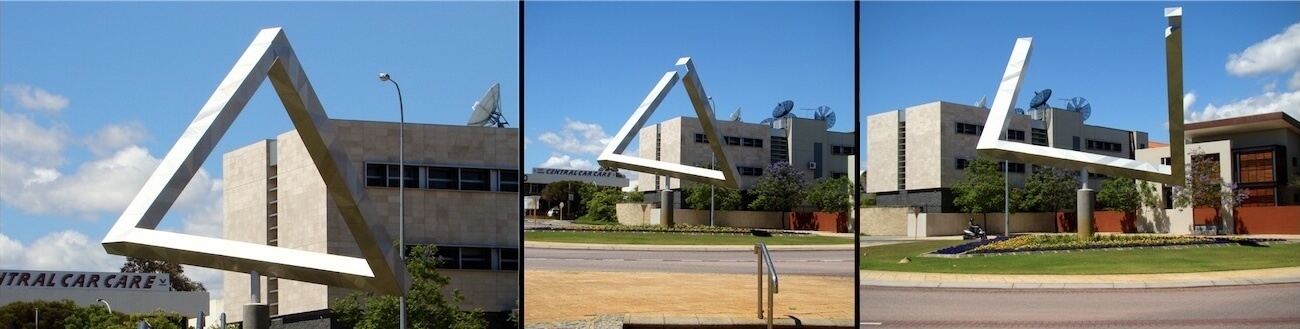

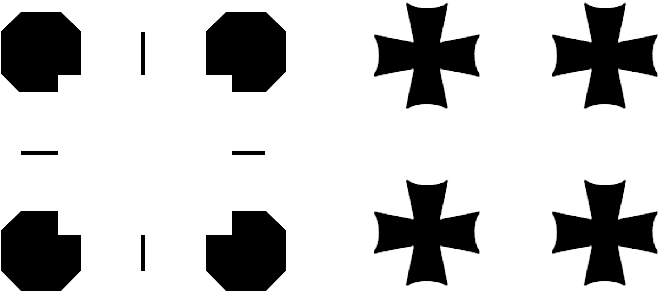

Eine Beschränkung unseres Wahrnehmungsapparates lässt sich gut anhand des Bildes oben veranschaulichen: Der Hund, die zwei Löwen, die vier Bäume sowie die drei Pyramiden sind hinsichtlich ihrer Anzahl schnell zu erfassen. Bei sehr kleinen Mengen reicht dafür ein kurzer Blick. Allerdings müssen dazu die Objekte beieinanderstehen. Wären die Bäume verteilt, wären sie je nach Anordnung bzw. Abstand voneinander schwieriger zu zählen. Die Anzahl der Karaffen zu ermitteln ist schon erheblich aufwändiger. Statt eines kurzen Blicks muss ein bewusster Prozess des Abzählens erfolgen. Die Konsequenz ist, dass die Objekte so lange stabil sichtbar sein müssen, bis der Abzählprozess beendet ist. Würden sie zwischendurch erscheinen oder verschwinden oder sich während des Zählvorgangs bewegen, müsste man sich zusätzlich zum jeweiligen Zählstand auch noch merken, welche Objekte schon gezählt worden sind. In diesem Fall hätten wir es mit mehreren kognitiven Prozessen zu tun: Wir müssten individuelle Merkmale für jedes Objekt ermitteln, uns merken, welche Objekte wir schon gezählt haben, und gleichzeitig das Zählen selbst vornehmen. Das überfordert uns in den meisten Fällen. Bei gleich aussehenden Objekten hätten wir noch ein weiteres Problem, das wir nur durch die Hinzunahme von Denkzeugen wie z. B. individuelle Markierungen oder den Aufbau eines Zählgatters lösen könnten. Wenn man sich jedoch die Anzahl der individuell gezeichneten Köpfe ansieht, stellt man fest, dass die Identifikation einen erheblich größeren Aufwand an Zeit und Konzentration erfordert als das Zählen. Sie können sich das plausibel machen, indem Sie sich selbst beim Zählen der Köpfe beobachten. Sie werden nicht ermitteln, wie viele unterschiedliche Köpfe es gibt und was den jeweiligen Unterschied ausmacht, sondern Sie werden zum Abzählen in aller Regel die Köpfe entlang eines Pfades einen nach dem anderen abwandern und sie dabei zählen. Als einzige zusätzliche Information müssen Sie sich in diesem Fall nur die jeweilige Position im Prozess merken. Allerdings kann die Position schnell zu einem komplexen Gebilde werden, denn wenn die Anzahl größer wird und die Objekte sich nicht mehr auf einer gradlinigen Trajektorie befinden, müssten wir uns zusätzlich auch noch entsprechende Richtungsänderungen merken. Wenn sich jetzt auch noch die Objekte laufend verändern würden, müssten wir weitere zusätzliche Informationen als Zwischenergebnisse oder Zwischenzustände beim Zählen erfassen und bearbeiten.

Entscheidend ist die Stabilität des Wahrnehmungsfeldes bzw. der Objekte in ihm, die durch die Forderung nach Persistenz erfüllt werden kann. Bei unserem Bildbeispiel ist dies gegeben, denn das Bild verändert sich während des Betrachtens bzw. Zählens nicht. Würden wir das Bild aber immer nur für etwa eine Sekunde zeigen, würde Ihnen das Zählen der Karaffen, Köpfe oder der Striche kaum gelingen. Das Gleiche gilt, wenn wir die Elemente animieren würden. Persistenz ist eine essentielle Forderung, doch reicht sie allein nicht aus. Je größer oder ungeordneter die jeweiligen Mengen präsentiert werden, desto schwieriger ist ein Abzählen. Um die elf Köpfe zu zählen, liegt es bereits nahe, ein Hilfsmittel zu nutzen, denn die Differenzerfahrung wird erheblich einfacher und sicherer, wenn man z. B. die Köpfe einzeln ausstreicht.

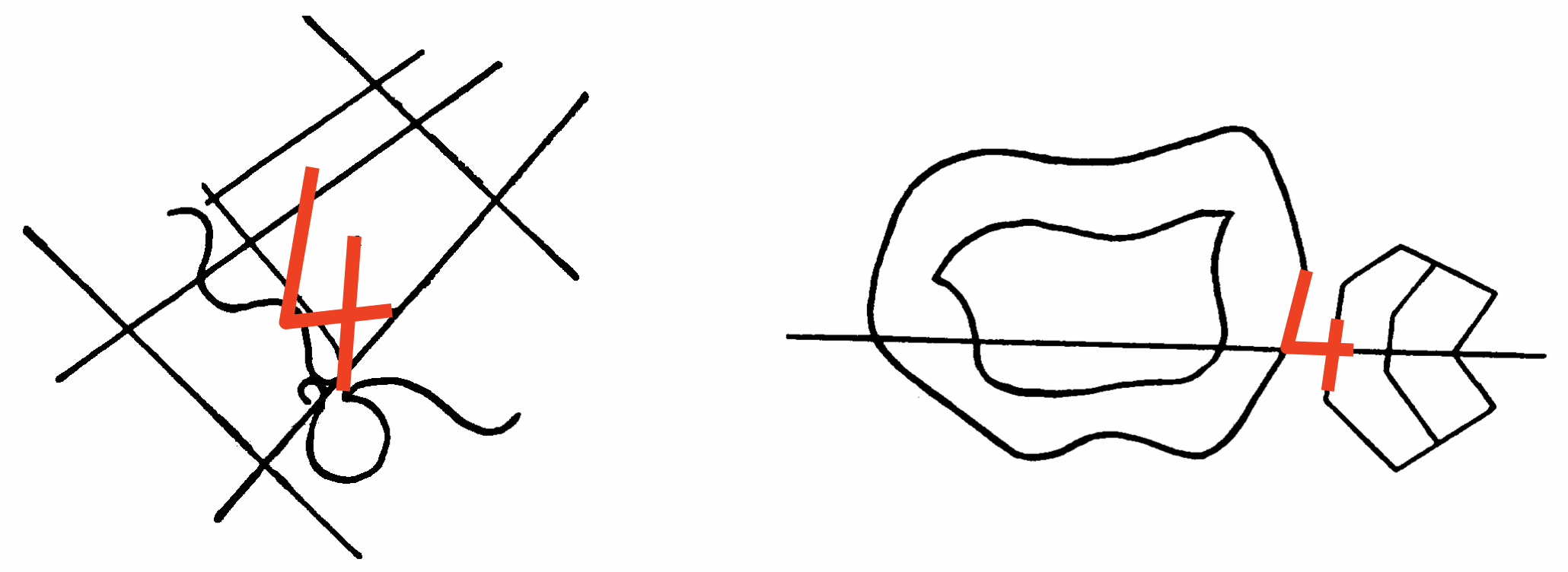

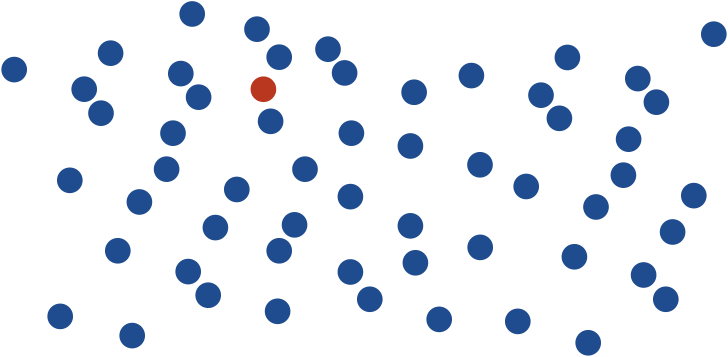

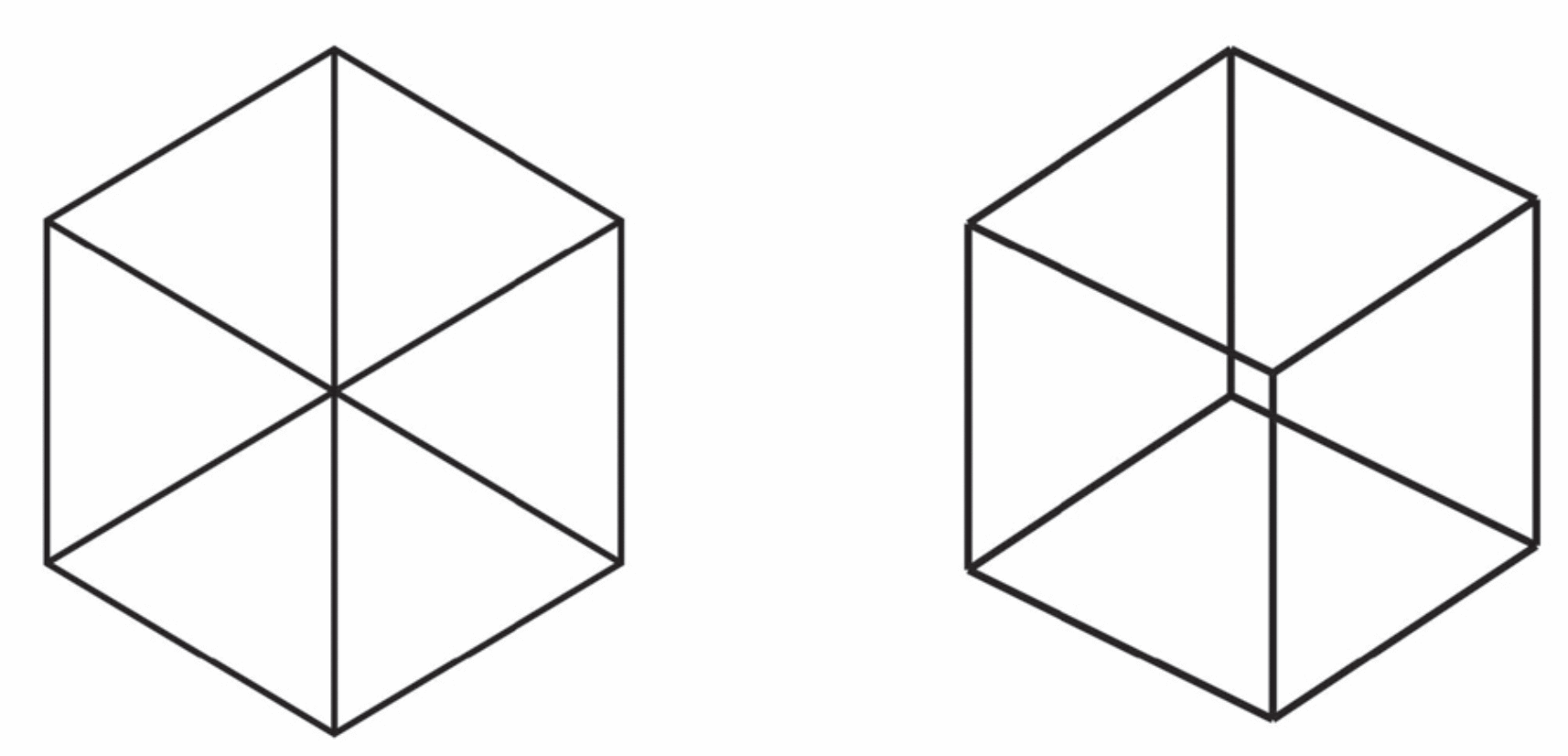

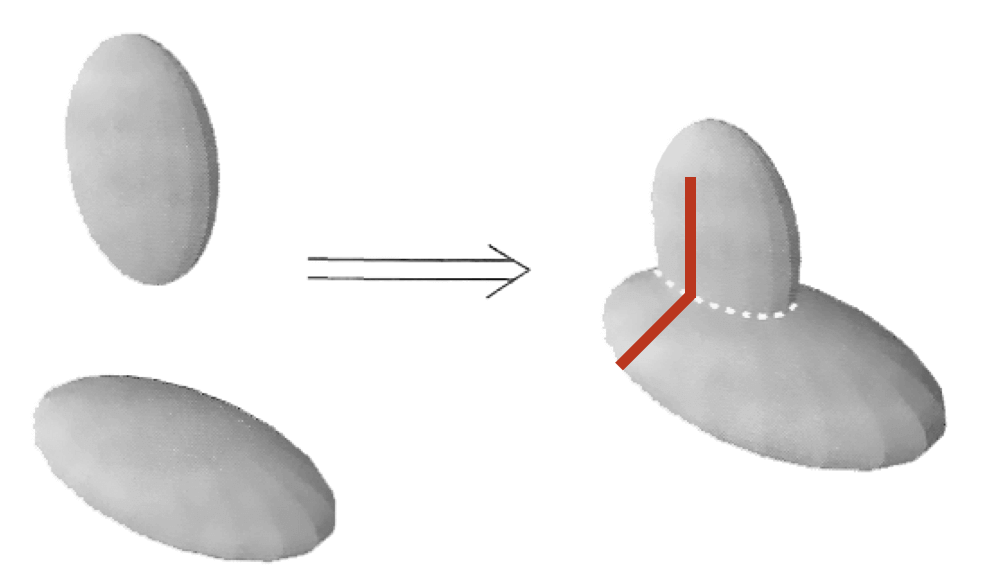

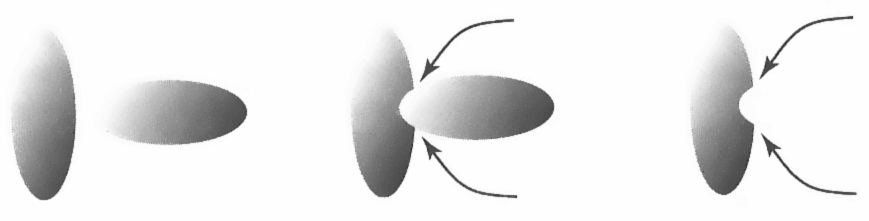

Ob mit Hilfsmitteln oder nicht, entscheidend für den Erfolg beim Zählen der Objekte ist das persistente räumliche Arrangement. Es spielt aber nicht nur beim Zählen eine entscheidende Rolle: Nehmen wir als Beispiel zwei Gegenstände wie die unten abgebildeten Stifte. Diese sollen hinsichtlich ihrer Länge verglichen werden. Selbst wenn das Arrangement der Gegenstände persistent bleibt, ist es schwer, die entsprechende Differenzerfahrung zu machen. Vergleiche bezüglich der Dicke, der Form und der Farbe sind leicht zu machen, aber für die Länge ist der Vergleich in dieser Situation schwierig.

Im linken Bild kann man bei der gegebenen Perspektive auf die Stifte und aufgrund ihrer Anordnung zueinander nicht entscheiden, welcher der beiden Stifte der längere ist. Eine Änderung der Betrachtungsposition würde nicht helfen, denn die Stifte liegen so weit auseinander, dass man sie dann nur nacheinander anschauen könnte. Außerdem würde sich ihr ungünstiger Winkel zueinander in keinem Falle ändern. Wenn man die Stifte jedoch so arrangiert, dass sie sich stabil in unmittelbarer Nähe in paralleler Ausrichtung befinden wie im rechten Bild, ist die Einschätzung der relativen Längen unmittelbar ersichtlich.

Wahrnehmung und Handeln

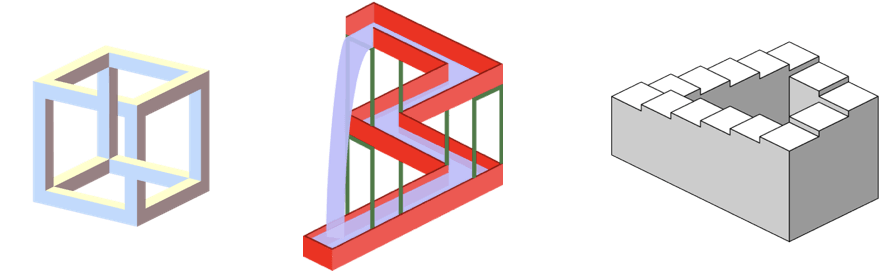

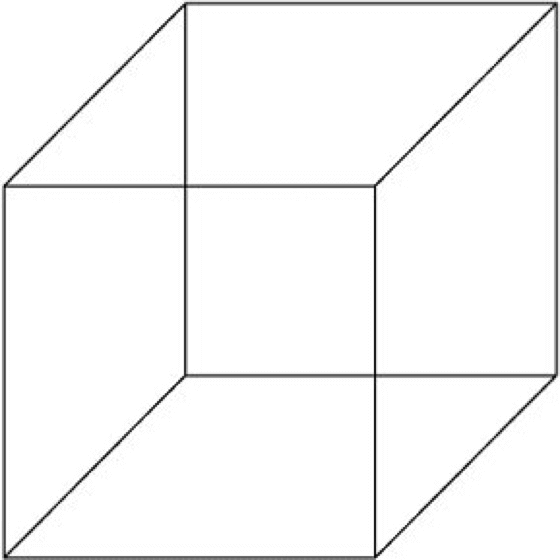

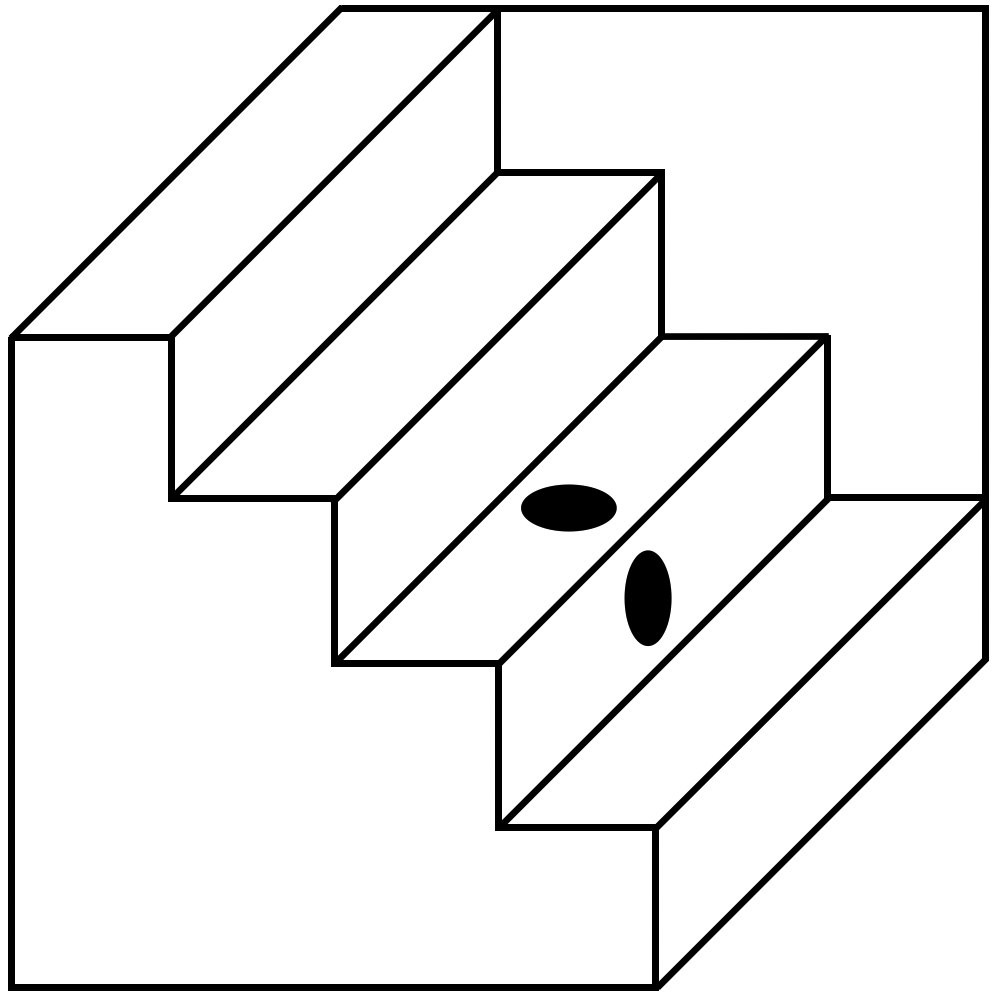

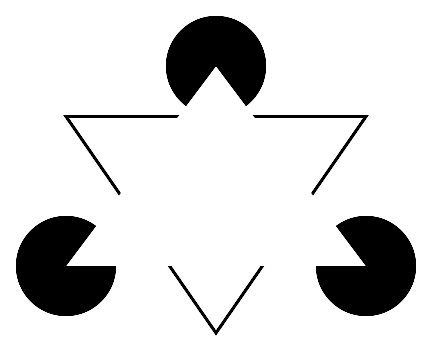

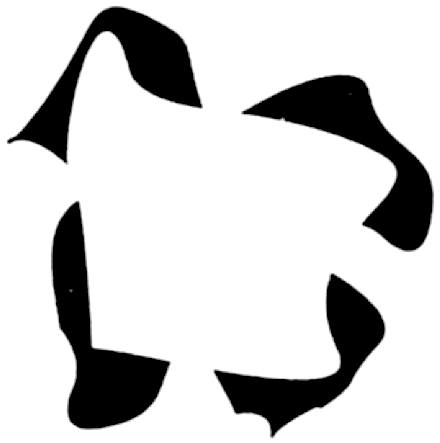

Um Differenzerfahrung machen zu können, ist es also oft notwendig, die zu überprüfenden Phänomene oder zu untersuchenden Gegenstände mit ihren Eigenschaften möglichst persistent im Wahrnehmungsfeld zu halten oder sie dorthin zu bringen. Ein einzelner visueller Schnappschuss ist grundsätzlich mehrdeutig, weil es beim Interpretieren der zweidimensionalen Netzhautbilder immer mehrere Möglichkeiten gibt, daraus ein dreidimensionales Modell der Umwelt zu erstellen. Dabei muss man sich verdeutlichen, dass ein Wahrnehmungsereignis immer im Zusammenhang mit anderen Ereignissen steht und darüber unser Gehirn „Verrechnungen“ vornimmt, um einen stimmigen Gesamteindruck zu erzeugen. Die Interpretation des Wahrgenommenen ist eine Konstruktion auf Basis der „sensorischen Daten“. Um die damit verbundenen Hypothesen zu überprüfen, was unser Wahrnehmungssystem übrigens ohne unser bewusstes Zutun dauerhaft anstellt, ist aktives Handeln nötig.

Als Beispiel diene der Teller in der folgenden Abbildung, der aus einem schrägen Blickwinkel fotografiert worden ist. Auf der Netzhaut des Auges bildet sich die Form einer Ellipse ab. Ob sich beim Betrachter nun der Eindruck eines runden oder eines elliptischen Tellers einstellt, hängt von individuellen Erfahrungen ab. Will man auf Grundlage des ersten Eindrucks überprüfen, ob es sich in der Tat um einen kreisrunden oder um einen elliptischen Teller handelt, ist es unumgänglich, den Kopf in eine andere Position zu bringen oder den Teller hochzunehmen und zu kippen. Erst durch Erreichen einer lotrechten Perspektive, also etwa direkt von oben, kann die Hypothese, dass es sich um einen kreisrunden Teller handelt, bestätigt oder verworfen werden.

Zur Differenzerfahrung bezüglich der Tellerform ist eine Perspektivenveränderung und damit eine Interaktion mit der Umwelt notwendig. Diese Notwendigkeit besteht für alle Formen der Differenzerfahrung, bei der wir Hypothesen über die Beschaffenheit von Gegenständen anstellen, beispielsweise „Wie setzt sich der Körper in der Tiefe fort?“ oder „Wie ist seine Rückseite beschaffen?“. Angenommen unsere Hypothese lautet, die Unterseite dieses Tellers besitze die gleiche Oberflächenbeschaffenheit wie die Oberseite, dann müssten wir die Unterseite unseres Tellers ins Blickfeld bringen, indem wir uns selbst, den Gegenstand oder beides bewegen. Differenzerfahrung erfordert also neben einer Umwelt, deren Verhalten unabhängig von den Erwartungen oder Annahmen des Wahrnehmenden ist, ein handelndes Subjekt, das Wahrnehmen und Handeln in einer spezifischen Art und Weise miteinander verknüpft. Um Differenzerfahrungen zu ermöglichen bzw. zu unterstützen, gilt es, Handlung und Wahrnehmung sowohl zeitlich als auch räumlich eng zu koppeln. Je größer die Zeitspanne zwischen den Wahrnehmungsereignissen ist, die miteinander in Beziehung gesetzt werden müssen, desto schwieriger ist es, verlässliches Wissen über die Umwelt zu erlangen. Liegen Handlungsort und Wahrnehmungsort räumlich weit auseinander, führt das zwangsläufig auch dazu, dass die Zeitspanne zwischen Handlung und Wahrnehmung größer wird, denn beide können erst zeitlich versetzt zum Gegenstand der Aufmerksamkeit werden. Die daraus resultierende Forderung, einen engen zeitlichen und räumlichen Zusammenhang von Handlung und Wahrnehmung herzustellen, bezeichnen wir als „Kopplung von Handlungs- und Wahrnehmungsraum“.

Fassen wir zusammen: Mithilfe des Konzepts der Differenzerfahrung haben wir verdeutlicht, dass Denken nicht im Kopf, sondern mit dem Kopf stattfindet, denn wie die Beispiele zeigen, ist es erst durch den Abgleich von Erwartungen und Vorstellungen mit der Umwelt möglich, Wissen zu schöpfen und überprüfbare Einsichten zu entwickeln. Doch nicht alle interessanten Aspekte sind so offensichtlich und unmittelbar einsichtig wie die Beispiele mit den Stiften und dem Teller. Hier setzt unser Konzept der Denkzeuge an, mit dessen Hilfe wir aufzeigen, wie wir die sensorischen und kognitiven Beschränkungen unseres Körpers erweitern und so zu neuen Einsichten gelangen können. Wir erweitern damit die Möglichkeiten für neue Differenzerfahrungen.

Denkzeuge

Differenzerfahrungen durch Perspektivenwechsel, Arrangieren oder durch das Bereitstellen einer persistenten Anordnung sind relativ passiv. Zwar wird dann und wann mal ein Objekt bewegt, aber im Großen und Ganzen wird die Umwelt so belassen, wie sie ist. In vielen Fällen muss der Aufwand für Differenzerfahrung über diese recht statische Beobachtung hinaus gehen. Was würde man in obigem Beispiel mit den Stiften machen, wenn man sie, aus welchem Grund auch immer, nicht gemeinsam ins Wahrnehmungsfeld bringen könnte? Nehmen wir an, es wären nicht zwei Stifte, sondern zwei Felsen, die in ihrem Umfang verglichen werden sollen. Wir gehen davon aus, dass es nicht möglich ist, die Felsen für einen Abgleich zu versetzen. Was kann man nun tun, um an die gesuchten Erkenntnisse zu kommen? Ein zusätzliches Hilfsmittel, das sich besser handhaben lässt, wird benötigt, um die Felsen mit diesem Dritten zu vergleichen. Mit anderen Worten: Man würde den Umfang der Felsen mit einem Messgerät erfassen. Als Messgerät nehmen wir der Einfachheit halber eine Schnur, die um den ersten Felsen gelegt wird und dann in der Länge des Umfangs markiert wird. Beim Ausmessen des zweiten Felsens kann man durch Vergleich der Markierungen auf der Schnur dann ablesen, welcher Felsen größer ist oder ob beide gleich groß sind. Es ist nun ein drittes physisches Objekt an der Differenzerfahrung beteiligt, das für den Zweck des Vergleichens hergestellt bzw. für diesen Zweck angepasst worden ist. Generell bezeichnen wir ein künstlich (ars, artis), also vom Menschen hergestelltes (factum) und wahrnehmbares Objekt als Artefakt, um sie z. B. gegen Vorstellungsobjekte abzugrenzen. Da jedoch unter einem Artefakt in verschiedenen Wissenschaftsdisziplinen und in der Umgangssprache etwas sehr Verschiedenes verstanden wird und auch die Informatik unterschiedliche Ausprägungen dieses Begriffs kennt, reicht für unsere Zwecke eine einfache Definition:

Ein Artefakt ist ein von Menschen hergestellter, persistenter Gegenstand.

Für Artefakte, die zum Zweck der Differenzerfahrung hergestellt bzw. eingesetzt werden, benutzen wir den Begriff Denkzeug. Die Schnur, die Stifte und auch der Schreibtisch, auf dem die Stifte liegen, sind solche Denkzeuge, wenn sie zum Zweck der Differenzerfahrung eingesetzt werden. Auch Zeichen auf einem Blatt Papier (Inschrift) werden wir, genau wie das Blatt selbst, als Artefakt bezeichnen. Dasselbe gilt für ein Zeichen oder eine Grafik an einem Bildschirm. Nun mag man dazu neigen, eine Inschrift als persistent und dauerhaft zu betrachten, eine Bildschirmanzeige jedoch nicht. Der entscheidende Punkt ist nicht die absolute physische Dauerhaftigkeit, sondern unter dem Blickwinkel des Denkzeugs die Tatsache, dass das Artefakt mindestens so lange präsent bleibt, bis die jeweilige Differenzerfahrung abgeschlossen ist. Wir betrachten Persistenz deshalb nicht als unabhängige physische Eigenschaft, sondern unter dem Blickwinkel, dass die jeweiligen Denkzeuge den unmittelbaren Akt des Erzeugens und Nutzens bis zum jeweiligen Handlungsabschluss überdauern. Alle Artefakte haben das Potenzial, als Denkzeug zu fungieren; sie bereichern unsere Umwelt und damit das Reich für mögliche Differenzerfahrungen. Ob und welche Differenzerfahrungen das sind, hängt von der jeweiligen Art und Weise ihrer Verwendung ab. Die Schnur beispielsweise ermöglicht den Vergleich des Umfangs verschiedener Felsen, wenn man sie wie erläutert verwendet. Die Art und Weise, wie Artefakte zu erzeugen und zu manipulieren sind, bezeichnen wir als Technik. Beispielsweise ist im obigen Beispiel das Arrangieren, bei dem die Stifte an einem Ende ausgerichtet werden, eine Technik, um Differenzerfahrung zu ermöglichen.

Ob ein Artefakt oder eine Technik ein Mittel zur Differenzerfahrung ist, liegt nicht im Artefakt oder in der Handlung an sich, sondern hängt vom Einsatzzweck ab. Ein geradezu sprichwörtliches Beispiel ist der Knoten in einem Taschentuch mit dem Zweck, sich an etwas zu erinnern.

Taschentücher sind von Menschen hergestellte Objekte, also Artefakte. Sie sind aber zunächst einmal nicht als Mittel zur Differenzerfahrung gedacht, denn wir benutzen Taschentücher nicht, um Hypothesen zu überprüfen, sondern um uns die Nase zu putzen oder etwas wegzuwischen. Ein Taschentuch mit einem Knoten kann – muss aber nicht – als Denkzeug fungieren. Erst wenn der Knoten für diesen Zweck gezielt hergestellt worden ist, kann er als Denkzeug fungieren, da er unabhängig von der Vergesslichkeit der jeweiligen Person persistent ist und so eine Differenzerfahrung über die Zeit ermöglicht. Hat man jedoch vergessen, an was der Knoten erinnern soll, oder ist er zum passenden Moment nicht im Wahrnehmungsfeld präsent, scheitert die Differenzerfahrung. Das Taschentuch, ebenso wie alle anderen Denkzeuge, bietet nur das Potenzial für mögliche Differenzerfahrungen, nötigt sie aber weder auf noch erzwingt es sie. Der Begriff „Denkzeug“ charakterisiert also unabhängig von den spezifischen physischen Eigenschaften die Funktion von Artefakten, Unterschiede in der Umwelt zum Anlass für Differenzerfahrungen zu machen.

Für die Erfüllung dieser Funktion ist entscheidend, dass sie das Ergebnis der Differenzerfahrung nicht verfälschen dürfen. Ein Problem, dass die Wissenschaften seit der Begründung der experimentellen Naturwissenschaft durch Galileo bis hin zu den digitalen Geisteswissenschaften intensiv beschäftigt.

Beispiel: Fernrohr

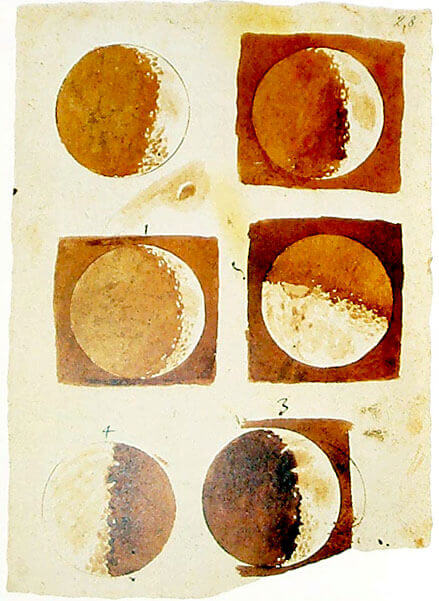

Ein klassisches Beispiel für ein Artefakt als Mittel zur Differenzerfahrung ist der Einsatz eines Fernrohrs. Ein Fernrohr zählen wir zu den Instrumenten. Instrumente offenbaren Objekt- oder Prozesseigenschaften, die mit dem menschlichen Wahrnehmungsapparat allein nicht wahrnehmbar wären. Betrachten wir das an einem historischen Beispiel: Galileo Galilei ging der Frage nach, ob die sichtbaren Flecken auf dem Mond Farb- oder Höhenunterschiede sind. Mit bloßem Auge ist eine Unterscheidung hier nicht möglich, denn für die erforderliche Differenzerfahrung ist das Auflösungsvermögen des Auges nicht ausreichend bzw. der Mond am Himmel zu klein. Mit Galileos Fernrohr konnte nun die Wahrnehmungsgranularität geändert werden, indem etwas weit Entferntes gewissermaßen „herangeholt“ wurde.

Mithilfe des Fernrohrs konnte Galilei dann erkennen, dass zum einen immer ein ganzer Mond zu sehen ist, der dunkle Teil also immer schemenhaft erkennbar ist, und zum anderen die Grenze zwischen dem hellen und dem dunklen Teil des Mondes nicht gerade und glatt verläuft, sondern vielmehr unruhig und zackig. Diese Verlaufslinie war für ihn ein klares Indiz dafür, dass er einen Schattenwurf auf einer unebenen Oberfläche beobachtete und dass es folglich auf dem Mond Erhöhungen und Vertiefungen geben müsse.

Abgesehen von der kirchlichen Problematik, ob es denn statthaft sei, die göttliche Himmelsmechanik mit einem von Menschenhand gefertigten Gerät zu untersuchen, musste sich Galilei auch aus wissenschaftlicher Sicht zu Recht Fragen gefallen lassen. Wie zum Beispiel lässt sich beweisen, dass die Strukturen, die er beobachtet hat, tatsächlich Eigenschaften des Mondes sind und nicht etwa Eigenschaften des Fernrohrs selbst? So etwas kommt vor. Manch ein vorgeblich fotografiertes UFO entpuppte sich im Nachhinein als Reflexion innerhalb des Linsensystems. Es ist schwer, den Nachweis zu führen, dass ein Mittel zur Differenzerfahrung keine Verfälschungen oder Verzerrungen beinhaltet. Es erfordert aufwändige, organisierte Differenzerfahrungen, indem man Vergleiche mit weiteren Teleskopen anstellt, die Beobachtungen auf andere Bereiche überträgt, aus den Erfahrungen heraus Grundlagen der Optik entwickelt und all dieses durch weitergehende Beobachtungen und Aktivitäten bestätigt, wie dies beispielsweise heutzutage mithilfe der Raumfahrt und mit Satelliten möglich ist.

Der Prozess der Aufstellung von Hypothesen, ihrer Überprüfung durch Hilfsmittel, der Wiederholung der Überprüfung zu anderen Zeitpunkten durch andere Personen, der Infragestellung der Überprüfungsmethoden und des späteren Ergänzens um weitere Methoden ist eine typische Charakteristik der Naturwissenschaften7. In den Naturwissenschaften reicht eine einzelne Differenzerfahrung nie aus, denn die Naturwissenschaften systematisieren die fortwährende Verzahnung von Hypothesenbildung und (experimenteller) Überprüfung. Nur wenn etwas mehrfach an verschiedenen Orten von verschiedenen Personen und idealerweise mit verschiedenen Mitteln festgestellt und repliziert werden kann, gilt es als gesichert. Wie wir gesehen haben, gilt dies auch schon für die Wahrnehmung selbst, denn ein einziger isolierter kurzer Blick ist für eine gesicherte Erfahrung nicht ausreichend. Eine einzelne Differenzerfahrung stellt also einen Anlass für neue Hypothesen dar, die dann wiederum durch weitere Differenzerfahrungen überprüft werden müssen.

Beispiel: Wärmebildkamera

![Aufnahme einer Wärmebildkamera – Bild: Lutz Weidner [CC BY-SA 2.0 de]](/preview_site_images1/ergonomie/G1----Waermebild.png)

Auch in diesem Szenario der Überprüfung der Wanddämmung sind Handeln und Wahrnehmen miteinander verschränkt. Zeigt die Kamera ein Bild, wie auf der Abbildung zu sehen, bleibt es wahrscheinlich nicht bei diesem einen Bild, denn auf die Erkenntnis, dass ein Dämmproblem vorliegt, erfolgt ja in der Regel eine Handlung. Das Ergebnis dieser Handlung muss dann wieder auf ähnlichem Wege überprüft werden. Die Differenzerfahrung mittels eines Instruments gab also die nötigen Hinweise, die für das Einleiten einer Handlung nötig waren. Die Überprüfung ihres Erfolgs bedarf erneuter Differenzerfahrung.

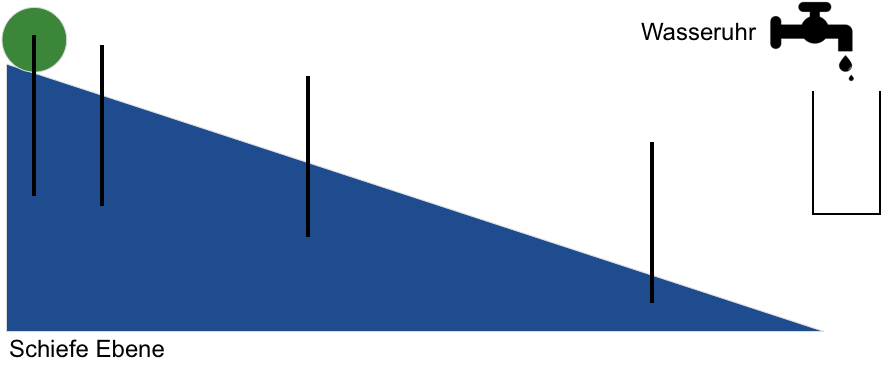

Beispiel: Schiefe Ebene

In unserem dritten Beispiel, der schiefen Ebene, handelt es sich um eine experimentelle Konstruktion. Beim experimentellen Konstruieren geht es im Vergleich zu den Instrumenten nicht um das Verstärken oder Transformieren (Visualisierung oder Sonifikation, wie etwa beim Geigerzähler) von nicht direkt wahrnehmbaren physikalischen Größen, sondern darum, eine Umgebung zu schaffen, in der Objekteigenschaften oder Naturphänomene, wie beispielsweise die Schwerkraft, einer systematischen Beobachtung zugänglich gemacht werden. „Systematisch“ bedeutet hier, ein experimentelles Arrangement zu schaffen, in dem die Beobachtung jeweils unter ausgewählten Randbedingungen wiederholt werden kann. Über die Kontrolle der Auswahlparameter kann der Geltungsbereich hypothetischer Annahmen überprüft werden. Das erfordert umfangreiche Transformationen, um das Phänomen studierbar zu machen. Dabei können zwar Störeinflüsse beseitigt werden, doch werden zugleich neue idealisierte Bedingungen geschaffen, die selbst wieder einer kritischen Überprüfung standhalten müssen.

Dies lässt sich an einem weiteren wissenschaftshistorischen Beispiel aus dem Repertoire von Galileo Galilei beschreiben, der Entdeckung der Fallgesetze. Der Legende nach hat Galilei die Fallgesetze untersucht, indem er Gegenstände vom Schiefen Turm von Pisa hat herunterfallen lassen. Dabei soll er die beschleunigte Bewegung beobachtet haben. Kann das sein? Um die Eigenschaften des Fallens, also die beschleunigte Bewegung, zu messen, müsste die Position des fallenden Objekts zu festgelegten Zeiten nach dem Fallenlassen oder die vergangene Zeit beim Passieren des Objekts an festgelegten Orten gemessen werden. Unter den Bedingungen einer Fallhöhe von 56 Metern, einer Fallzeit von nur 3,4 Sekunden und einer Geschwindigkeit von 120 km/h beim Aufprall konnte Ende des 16. Jahrhunderts aber keine solche Beobachtung angestellt werden. Dafür hätte es etwa Lichtschranken und sehr genauer Uhren bedurft. Solche Geräte standen damals nicht zur Verfügung.

Die geniale Idee Galileis war es nicht, etwas vom schiefen Turm fallen zu lassen, sondern statt des Falls eines Objekts die beschleunigte Bewegung einer Kugel auf einer schiefen Ebene zu beobachten. Auf diese Weise konnte er den Prozess derart verlangsamen, dass er mit damaligen Mitteln beobachtbar und sogar messbar wurde. Das obere Bild verdeutlicht das experimentelle Arrangement von Galilei. Da kurze Zeitspannen damals noch nicht direkt messbar waren, bediente er sich einer Wasseruhr und maß anstelle der Zeit das Gewicht des in ein Gefäß gelaufenen Wassers. Wiegen konnte man gut, denn genaues Wiegen war für den Handel wichtig. Auf der Ebene konnten an verschiedenen Stellen Barrieren angebracht werden, sodass die herabrollende Kugel unterschiedlich lange Strecken durchlief. Der Wasserzulauf wurde beim Erreichen der Barriere gestoppt und somit die vergangene Zeit für den zurückgelegten Weg gemessen. Galilei tüftelte die Positionen der Barriere so aus, dass die Zeit, die die Kugel brauchte, um die Barriere zu erreichen, sich jeweils um die initiale Zeitspanne verlängerte. Hatte er das erreicht, wurden die Abstände der Barrieren gemessen und beides miteinander in Beziehung gesetzt. Dieses Experiment wurde in verschiedenen Formen mit verschiedenen Neigungen der Ebene wiederholt. Da die Zeit für die Bewältigung des Weges zwischen zwei Barrieren immer gleich war, der Abstand sich aber zunehmend vergrößerte, konnte er aus den Ergebnissen auf eine beschleunigte Bewegung beim Fallen von Objekten schließen.

Die Konstruktion aus schiefer Ebene, Barrieren und Wasseruhr ermöglichte es, den freien Fall eines Körpers der sinnlichen Wahrnehmung zugänglich zu machen. Es handelt sich bei dieser experimentellen Anordnung aber nicht um ein Beschleunigungsmessinstrument, sondern um eine Konstruktion, mit deren Hilfe man gewissermaßen der Umwelt gezielt Fragen stellen kann, indem man die passenden Randbedingungen herstellt.

Die experimentelle Anordnung Galileis wäre heute nicht mehr unbedingt nötig, denn heute gelänge es wohl, die Beschleunigung eines fallenden Gegenstands auch direkt – zum Beispiel am Schiefen Turm von Pisa – mit Instrumenten zu messen. Es gibt aber viele Fälle, in denen die Wahrnehmung bestimmter Eigenschaften der Natur ohne eine experimentelle Konstruktion nicht möglich ist. Um zum Beispiel nachzuweisen, dass die Fallgesetze für alle Körper unabhängig von ihrer Masse gleichermaßen gelten, dass also eine schwere Bleikugel und eine leichte Feder gleich schnell fallen, ist eine Konstruktion unumgänglich. Das Fallenlassen beider Objekte von einem hohen Punkt aus würde mit noch so genauen Instrumenten nicht zur Wahrnehmung einer gleich schnellen, beschleunigten Bewegung führen. Es braucht eine Konstruktion, in der ein Vakuum erzeugt wird, in dem die Objekte dann ohne den Einfluss des störenden Luftwiderstands frei fallen können.

Die geschaffenen, idealisierten Bedingungen schaffen neue Möglichkeiten der Beobachtung. Ein reines Beobachten ist für so etwas wie das Aufstellen der Fallgesetze für sich genommen aber noch nicht ausreichend. Das In-Beziehung-Setzen von Zeit (Wasseruhr) und Fallstrecke (Abstände zwischen den Barrieren) erfordert zusätzlich Rechenprozesse (Formalismen). Auch solche formalen Transformationen wie das (schriftliche) Rechnen sind ein Mittel zur Differenzerfahrung, zumindest dann, wenn man nicht aus Spaß an der Freude rechnet, sondern wenn sich die Rechnung auf eine reale Gegebenheit bezieht, denn dann kann man mit der Berechnung etwas über die Umwelt herausfinden.

Beispiel: Rechnen

Es sind zehn Stückchen Kuchen da. Sechs Freunde sollen am Nachmittag zu Besuch kommen. Für jeden soll es mindestens zwei Stückchen Kuchen geben. Reicht der Kuchen, oder muss noch nachgekauft werden? Wie ist in diesem Fall Differenzerfahrung möglich? Man könnte es drauf ankommen lassen, sprich, man lässt die Leute kommen und jeder soll versuchen, seine zwei Stückchen Kuchen zu essen. Will man es aber vorher wissen, muss man rechnen, und wahrscheinlich haben Sie es schon im Kopf überschlagen: 6*2 = 12 > 10 – es reicht nicht. Die Technik des Rechnens hat uns als Mittel zur Differenzerfahrung gedient.

Um rechnen zu können, muss es möglich sein, das realweltliche Problem in einer formalen Art und Weise aufzuschreiben8. Wenn das der Fall ist, kann man formale Umformungsregeln, ein sogenanntes „Kalkül“, auf die Zeichen anwenden. Genau wie bei den anderen Mitteln zur Differenzerfahrung können formale Umformungen wie das schriftliche Rechnen gerade deshalb ein Mittel zur Differenzerfahrung sein, weil der Rechenprozess und damit auch sein Ergebnis völlig entkoppelt von den Hypothesen oder Erwartungen des Rechnenden sind. Die Berechnung oben und die Art und Weise, wie man sie durchführt, hat nichts mit der eigenen Einschätzung der Kuchenverhältnisse zu tun. Der Formalismus und seine Umformungsregeln sind davon unabhängig. Korrekt zu rechnen, hat nichts mit menschlicher, sinnhafter Interpretation zu tun, sondern mit dem korrekten Befolgen von Regeln, wobei diese sich nur auf die Form und Anordnung der Zeichen beziehen.

Wenn ein Sachverhalt angemessen in den Formalismus übertragen worden ist, sind durch den Formalismus die Voraussetzungen für Probehandeln und Vorhersagen gegeben, die sonst nicht möglich wären. Formale Operationen haben also einen konstruktiven Charakter. Wenn die monatlichen Ausgaben mit dem zu erwartenden Gehalt verrechnet werden, kann frühzeitig festgestellt werden, ob noch Spielraum für weitere Anschaffungen besteht. Die Rechnung hat etwas sichtbar gemacht, was in den Zahlen grundsätzlich schon steckte, aber nicht unmittelbar der Wahrnehmung zugänglich war.

Ob das Ergebnis einer formalen Umformung wie einer Berechnung für die Beurteilung von Gegebenheiten in der Umwelt von Belang ist, ist keine Eigenschaft der Rechenregeln, sondern ob man die richtige Modellierung und das richtige formale Transformationssystem angewandt hat. Wie eine Redensart besagt, könne man Äpfel und Birnen nicht vergleichen, aber man kann sie durchaus addieren. Drei Äpfel und zwei Birnen ergeben fünf Stücke Obst. Will man aber wissen, was passiert, wenn man 1 m³ Ammoniak und 3 m³ Luft mischt, ist ein anderes formales Modell vonnöten. Die Wissenschaft der Chemie hat hier einiges im Angebot. Ein Addieren gemäß der Rechenregeln ist zwar möglich, führt aber nicht zur gewünschten Differenzerfahrung. Das Ergebnis „1 m³ Ammoniak + 3 m³ Luft = 4 m³ Gasgemisch“ wäre zwar richtig gerechnet, aber keine gute Voraussage für den tatsächlichen Versuch, weil dieser nicht zu 4 m³ eines Gasgemisches führen würde, sondern eher zu einem zerstörten Labor.

Die bislang angestellten Überlegungen verdeutlichen bereits unsere Herangehensweise. Schon beim Beispiel mit dem Zählen haben wir den mentalen Aufwand über den Gegenstandsbereich der Wahrnehmung und der jeweils zu erledigenden Aufgabe bestimmt und gezeigt, dass schon bei einer relativ geringen Anzahl von Objekten eine Technik des bewussten Zählens erforderlich ist. Je nach Arrangement und der gewählten Vorgehensweise sind weitere Informationsverarbeitungsprozesse notwendig, die relativ schnell unsere mentale Kapazität übersteigen. Mithilfe zusätzlicher physischer Hilfsmittel wie Markierungen oder der Mess-Schnur lassen sich Komplexität und kognitiver Aufwand verringern.

Externes Gedächtnis

Denkzeuge bieten nicht nur das Potenzial für Differenzerfahrung, sondern sie können zugleich in erheblichem Umfang für mentale Entlastungen sorgen. Oft geht das eine mit dem anderen einher. Dies wird in einer Anekdote aus Georges Ifrahs Buch „Die Universalgeschichte der Zahlen“9 anschaulich beschrieben:

Stellen wir uns einen Hirten vor, der nicht ‚zählen‘ kann und der eine Hammelherde zu hüten hat, die er allabendlich in einer Höhle einschließt. Es handelt sich um 55 Hammel, aber unser Hirte ist nicht in der Lage zu begreifen, was die Zahl 55 bedeutet. Er weiß lediglich, daß er ‚viele‘ Hammel hat. Da ihm diese Aussage zu ungenau ist, möchte er doch gerne wissen, ob seine Hammel jeden Abend auch vollzählig zurückgekehrt sind. Eines Tages hat er eine Idee… Er setzt sich in den Eingang seiner Höhle und läßt seine Hammel einen nach dem anderen hinein. Jedesmal, wenn ein Hammel an ihm vorbeikommt, macht er eine Kerbe in einen Wolfsknochen. Auf diese Weise hat er mit dem Durchgang des letzten Tieres genau fünfundfünfzig Kerben geschnitzt. Nun legt er jeden Abend, wenn seine Hammel wie immer einer hinter dem anderen zurückkommen, jedesmal den Finger in eine Kerbe, von einem Ende des Knochens bis zum anderen. Und wenn sein Finger dann bei der letzten Kerbe angekommen ist, ist unser Hirte beruhigt, denn nun sind alle seine Hammel in Sicherheit.

Der Schäfer in Ifrahs Anekdote hat ein Artefakt erzeugt, mit dem ihm etwas möglich wurde, was er selbst nicht konnte, nämlich zählen. Selbst wenn er hätte zählen können, wäre die Technik praktisch, denn die Kerben im Knochen halten das Endergebnis, die Zahl 55, fest, und die gefundene Zähltechnik mit linearem Abgreifen der Kerben vermeidet die Notwendigkeit, sich Zwischenergebnisse merken zu müssen. Die Kerben-Ritz-Technik des Schäfers ist ein Mittel zur Differenzerfahrung, denn der „Zählvorgang“ hat nichts damit zu tun, was der Zählende von ihrem Ausgang erwartet. Er hängt nur von der Anzahl der Schafe und der Anzahl der Ritzen ab, die beide unabhängig vom Zählenden sind. Die vom Schäfer gewählte Technik, Kerben in einen Knochen zu ritzen, eröffnet aber weit mehr Potenziale als nur eine Zählunterstützung und Gedächtnisentlastung. Dadurch dass die Technik auf einer persistenten Einschreibung (Kerben) in ein Medium (Knochen) basiert, kommen den Zählprozessen eine Reihe von „Unabhängigkeiten“ von der aktuellen Situation zu [^Gedächtnismedien]:

- Unabhängigkeit vom Zeitpunkt: Da der Knochen persistent ist, kann die Überprüfung der Hammelzahl zu einem beliebigen anderen Zeitpunkt durchgeführt werden.

- Unabhängigkeit vom Ort: Da der Knochen kompakt ist und mitgenommen werden kann, muss der Schäfer seine Überprüfung nicht etwa immer am gleichen Ort durchführen, sondern kann dies überall dort tun, wo er die Schafe vereinzeln kann.

- Unabhängigkeit von der Person: Der Knochen kann an einen anderen Schäfer weitergegeben werden. Dieser Schäfer kann dann, ohne die ursprünglichen Einritzungen vorgenommen zu haben und ohne jemals vorher diese Herde gezählt zu haben, die Vollständigkeit der Herde überprüfen.

Die Technik, Kerben bzw. allgemeine Zeichen in einen Knochen zu ritzen, ist eine Einschreibtechnik. Beim Knochen kann man den Begriff „Einschreiben“ sehr wörtlich verstehen, denn es wird ja tatsächlich etwas in den Träger hineingeritzt. Wir nutzen das Wort „Einschreibtechnik“ hier aber etwas allgemeiner auch für alle Techniken, bei denen Zeichen auf einen Träger aufgebracht werden, indem dieser chemisch, physikalisch oder mechanisch verändert wird. In all diesen Fällen sagen wir, dass etwas in den Träger „eingeschrieben“, also untrennbar mit dem Trägermaterial verbunden ist. Mit technischen Mitteln lässt sich nur dieses Trägermaterial bearbeiten, nicht die Zeichen selbst. Einschreibtechniken sind, allgemeiner formuliert, Aufzeichnungstechniken. Technisch gesehen bedeutet Aufzeichnen, dass Prozesse Spuren in einem Artefakt hinterlassen. Dies gilt für das händische Ritzen oder Schreiben, wo die Schriftzeichen die Spur des Stifts auf dem Papier sind, oder auch für technische Aufzeichnungstechniken wie dem Einritzen von Rillen in Wachsplatten bei einer Schallplatte oder den Magnetisierungen von Metallbeschichtungen bei einer Festplatte. Die aufgezeichneten Spuren sind unabhängig vom zeitlichen und örtlichen Vollzug wiederholt bedenk- und bearbeitbar. Um eine Schallplatte, eine Musikkassette oder ein Videoband wiedergeben zu können, bedarf es aber neben dem Aufzeichnungsmedium selbst auch Kenntnisse über die Aufzeichnungs- und Wiedergabetechnik, denn aus dem Artefakt der Platte mit den Rillen oder der Festplatte mit der magnetisierten Beschichtung allein geht nicht hervor, welche Art von Aufzeichnung es ist und wie sie wiedergegeben wird, denn grundsätzlich ließe sich auch auf einer Schallplatte oder einer Musikkassette ein Bild speichern oder ein Videoband für die Aufzeichnung seismischer Aktivitäten nutzen.

Im Gegensatz zu den physisch wahrnehmbaren Spuren sind Bedeutungen und Interpretationen keine Eigenschaften der Artefakte. Die Bedeutung von Zeichen und Spuren erschließt sich Personen, die nicht mit dem Kontext der Aufzeichnungsprozesse vertraut sind, meist nicht. Bedeutungen von Zeichen sowie von sprachlichen Ausdrücken müssen immer sozial koordiniert werden. Dass Sie diesen Text lesen können, liegt an den Vereinbarungen über die Zeichen unseres Alphabets, den Regeln der deutschen Schriftsprache und den Erfahrungen und Konventionen zum Gebrauch. Kurz: Sie können diesen Text lesen, weil Sie die lateinischen Buchstaben kennen und lesen gelernt haben, weil Sie der deutschen Sprache mächtig sind und weil Sie zumindest im Groben eine Ahnung von den Dingen haben, über die wir sprechen. Auch die Nutzungsschnittstelle von Computersystemen besteht aus Zeichen und Spuren und auch deren Bedeutung erschließt sich logischerweise nicht aus sich selbst heraus. Das Erschließen eines komplexen interaktiven Systems ist daher – zumindest zu Beginn der Nutzung – mit einem hohen Lernaufwand verbunden. Dieser erfordert immer Differenzerfahrung und damit die Notwendigkeit, die zuvor besprochenen Voraussetzungen für diese Differenzerfahrungen zu schaffen.

Bei analogen Inschriften besteht ein Konflikt insofern, als dass nur das Trägermedium sowohl der technischen als auch der manuellen Bearbeitung zugänglich ist. Damit besteht auf nahezu allen Ebenen der Wissensarbeit ein Konflikt zwischen Persistenz und Manipulierbarkeit.

Objektgranularität und Räumlichkeit

Der vorhergehende Abschnitt macht deutlich, dass bei Einschreibtechniken Zeichen und andere Artefakte in ein räumliches Arrangement zu bringen sind, um effektiv Differenzerfahrungen ermöglichen zu können. Selbst bei der Zähltechnik des Hirten wurden die Kerben nicht willkürlich in den Knochen eingeritzt, sondern so, dass sie nacheinander mit dem Finger abgetastet werden konnten. Auch beim schriftlichen Rechnen spielt die Anordnung der Zeichen eine entscheidende Rolle, denn sie ist für eine korrekte Ausführung der Rechenoperationen und letztlich auch für das Aufschreiben und Lesen der Zahlen im Stellenwertsystem entscheidend.

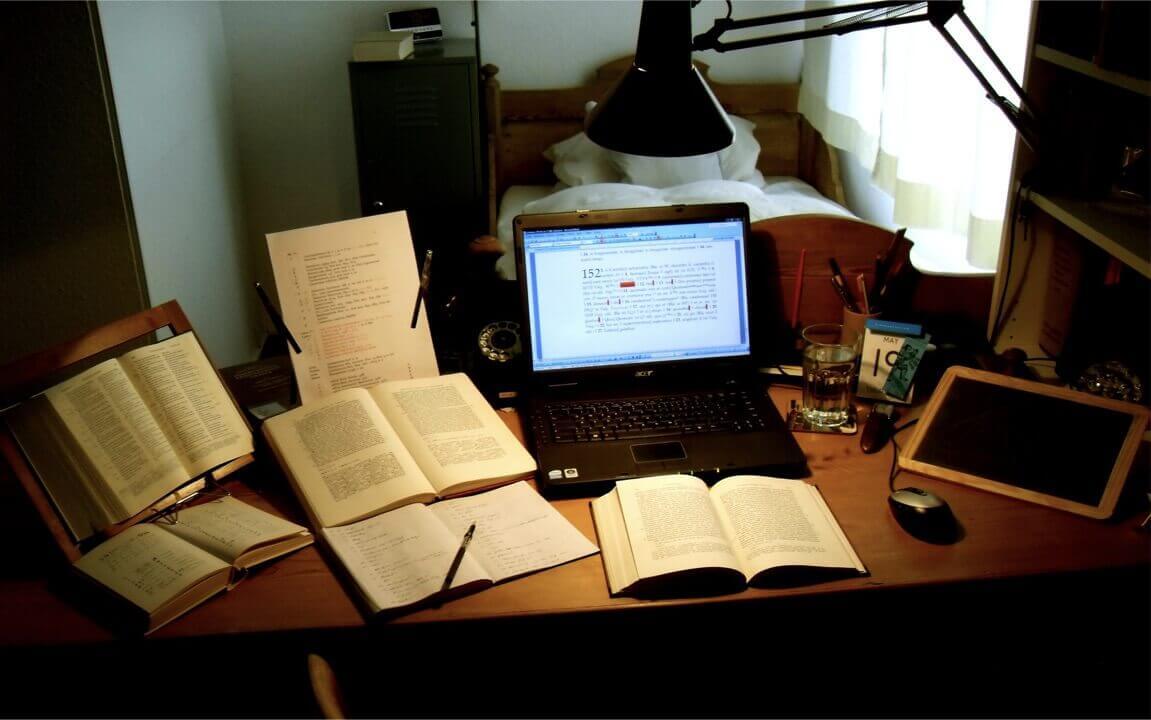

Räumliche Arrangements sind überall dort wichtig, wo im Rahmen von Wissensarbeit mehrere Artefakte berücksichtigt werden müssen. Wenn Sie Dokumente sichten, stehen diese oft nicht für sich, sondern werden in Beziehung zu anderen Dokumenten und Artefakten gesetzt. Meist ist nicht das gesamte Dokument für den jeweiligen Zweck relevant. Sie brauchen vielmehr Ausschnitte, die Sie mit anderen kombinieren, mit eigenen Notizen und Anmerkungen ergänzen, bis schließlich ein neues Dokument entstanden ist. Der Prozess der Sichtung von Dokumenten und der Annotation und der Verdichtung zu einem neuen Dokument ist ohne die Möglichkeit der räumlichen Anordnung kaum durchzuführen. Sie müssten unentwegt in Dokumenten blättern und zusammenhängende Quellen blieben genauso voneinander getrennt wie Notizen zu dem, auf das sie sich beziehen. Sie würden im wahrsten Sinne des Wortes schnell den Überblick verlieren, weil insbesondere bei längerer Arbeit der jeweilige (Zwischen-)Stand Ihrer Erkenntnisse nicht durch eine schnelle direkte Wahrnehmung erfassbar wäre.

Ein Schreibtisch, wie beispielsweise hier abgebildet, ist ein traditionelles Möbel für diese Form von Wissensarbeit. Die Schreibtischoberfläche verkörpert einen geeigneten Raum, weil sie in der Regel groß genug ist, die unterschiedlichen Schriftstücke und Notizzettel auszubreiten und sie gemeinsam ins Wahrnehmungsfeld zu bringen. Zugleich bleibt jedes einzelne Schriftstück zur Bearbeitung in Reichweite. Werden beim Arbeiten mit den Dokumenten Zusammenhänge und Abhängigkeiten festgestellt, lassen sich diese auf einem Schreibtisch durch die Anordnung räumlich abbilden. Unter anderem ist es möglich, Dokumente zu ordnen und zu gruppieren, indem sie beispielsweise auf einen gemeinsamen Stapel oder in eine definierte Reihenfolge gelegt werden. Soll ein bestimmtes Dokument besondere Aufmerksamkeit genießen, kann dies zum Beispiel durch die Position, etwa direkt am Sitzplatz des Wissensarbeiters oder aber durch eine explizite Auszeichnung ausgedrückt werden. Ein Dokument könnte etwa schief auf einen Stapel gelegt werden, es kann farblich markiert werden oder eine Ecke einer Seite kann zu einem Eselsohr umgeknickt werden. Auf diese Weise können neue Dokumente oder Notizen hinzukommen, ohne dass die bisherige Anordnung komplett geändert werden müsste. Das jeweils aktuelle Arrangement verkörpert also zu einem gewissen Grad den erreichten Stand in der Wissensarbeit und kann deshalb selbst als Denkzeug betrachtet werden.

Betrachtet man von den vielen Möglichkeiten an einem Schreibtisch die Aspekte der räumlichen Anordnung, können wir eine kleine Zahl grundlegender räumlicher Arrangieroperationen als Techniken ausmachen:

Erzeugen: Es muss möglich sein, neue Artefakte im Wahrnehmungsfeld zu erzeugen. Damit ist nicht gemeint, dass ein Dokument im Sinne seines Trägers, also das Papier selbst, erzeugt wird, sondern dass es möglich ist, Zeichen in einen Träger einzuschreiben und damit persistent verfügbar zu machen.

Einfügen: Eine grundlegende Voraussetzung für eine Arbeitsumgebung ist die Möglichkeit, weitere Artefakte zum vorhandenen Arrangement hinzuzufügen. Im Büro kann das zum Beispiel geschehen, indem ein Dokument aus einem Aktenschrank oder einem Ordner entnommen und auf den Schreibtisch gelegt wird.

Umordnen: Ein Großteil der Wissensarbeit in einer Arbeitsumgebung wie einem Schreibtisch bedeutet, Artefakte an- und umzuordnen, sie also im Wahrnehmungsfeld zu bewegen. Das Schaffen solcher Arrangements eröffnet die Möglichkeit, Artefakte zu vergleichen und aufeinander zu beziehen. Darüberhinausgehend ist es möglich, bestimmten Positionen eine Bedeutung zuzuordnen und Gruppen mit gemeinsamen Merkmalen zu bilden.

Entfernen: Genauso wie Artefakte in den Wahrnehmungsraum gebracht oder in ihm erzeugt werden können, muss es möglich sein, Artefakte aus dem Wahrnehmungsfeld zu entfernen. Das kann in diesem Zusammenhang bedeuten, ein Artefakt zu zerstören. Es kann aber, gerade beim Beispiel Schreibtisch, auch das Ablegen eines nicht mehr benötigten Dokuments bedeuten.

Mit diesen vier Operationen sind bereits viele der typischen Handlungen zum Erzeugen eines Dokument-Arrangements möglich. Eine weitere, besondere Operation ist jedoch dann nötig, wenn der interessierende Bedeutungsausschnitt nicht mit der Granularität des Trägermediums identisch ist. Das Arrangieren eines einzelnen Artefakts reicht dann nicht mehr aus. Vielmehr muss bislang Zusammenhängendes nun getrennt behandelt werden.

Rekomponieren: Rekomponieren beinhaltet die Möglichkeit, die Granularität eines Artefakts zu verändern, also Artefakte in mehrere einzelne Objekte zu zerteilen und einzeln zu bearbeiten oder auch mehrere Objekte zu einem gemeinsamen Artefakt zusammenzufassen. Ist dies flexibel möglich, kann man etwa einen Text dadurch erstellen, dass Abschnitte und Kapitel räumlich sortiert und dann zu einem gemeinsamen Objekt zusammengefügt werden.

Jeder von Ihnen, der an einem komplexen Projekt gearbeitet und dafür Dokumente auf dem Schreibtisch ausgebreitet hat, wird schon festgestellt haben, dass es schon bei umfangreicheren Artefakten an diesen wenigen Funktionen Probleme geben kann. Nehmen wir als Beispiel eine Aufgabe, bei der Sie in einem Buch nach interessanten Aspekten forschen. Sie finden einen interessanten Punkt, sagen wir mal auf Seite 20. Ein anderer damit zusammenhängender Aspekt steht auf Seite 53. Sie würden nun gerne die Seite 20 nach links hin anordnen und die Seite 53 auf den Stapel auf der rechten Seite befördern, um beide schnell in Bezug setzen zu können. Das Buch ist dafür aber nicht gemacht, denn die Seiten sind, im wahrsten Sinne des Wortes, gebunden. Sie könnten nun das Buch auseinanderreißen, um seine Teile, wie oben beschrieben, rekomponieren zu können. Alternativ könnten Sie an einen Kopierer gehen, zwei Kopien machen, die Sie interessierenden Teile ausschneiden und diese dann nach Ihren Wünschen anordnen. In beiden Fällen machen Sie jedoch einen Umweg, denn Sie beschäftigen sich für eine gewisse Zeit nicht mit Ihrer eigentlichen Recherche und den Inhalten, sondern mit dem Objekt Buch, dem Kopierer und der Schere, also den technisch-materiellen Veränderungen der jeweiligen Trägermedien.

Persistenz versus Bearbeitbarkeit

Dieses und viele ähnlich gelagerte Probleme liegen an einer Grundcharakteristik analoger Medien, nämlich der, dass Persistenz, also Beständigkeit, und Bearbeitbarkeit sich entgegenstehen. Bei vielen Formen von Wissensarbeit wie dem Prozess der Texterzeugung wird aber sowohl Persistenz als auch Bearbeitbarkeit gefordert, denn mit Artefaktunterstützung über etwas nachzudenken, heißt einerseits Artefakte zu bearbeiten, aber andererseits auch das Festhalten von Ergebnissen in persistenten Einschreibungen.

Alles, was analog eingeschrieben ist, ist persistent, und damit auf dieser Ebene der Einschreibung nicht mehr bearbeitbar. Das verdeutlicht ein Beispiel: Wenn Sie die Zahlen 1 2 3 4 5 6 auf Papier schreiben, dann sind sie persistent dort eingeschrieben. Solange der Papierträger nicht zerstört wird, bleibt die Anordnung der Zeichen erhalten. Zwar kann man einzelne Zahlen umrahmen oder unterstreichen, ihnen also etwas hinzufügen. Man kann je nach eingesetzter Technik die Zahlen sogar chemisch (Tintenkiller) oder mechanisch (Radiergummi) entfernen, aber ein Arrangieren im Sinne eines Bewegens der Zeichen selbst ist nicht möglich. Wenn man nun unter das Geschriebene einen Strich macht und die gleichen Zeichen in der Anordnung

1 2 3

6 5 4

neu aufschreibt, hat man die Zeichen nicht wirklich arrangiert, sondern ein komplett neues Arrangement bestehend aus neuen Zeichen erstellt. Damit einzelne Zeichen in der analogen Medienwelt arrangierbar sind, könnten sie jeweils in einen eigenen Medienträger eingeschrieben werden – in diesem Fall jede Ziffer auf einem eigenen Stück Papier. Diese Träger können dann auf einer Arbeitsfläche wie einem Schreibtisch arrangiert werden. Die Verwendung einer solchen Technik ist ein Trick, denn eigentlich wird das Problem nicht gelöst. Die eingeschriebenen Zeichen können nach wie vor nicht bewegt werden. Stattdessen werden nun die Medienträger selbst bewegt. Die dann entstehende Anordnung ist bearbeitbar, aber nicht mehr im gleichen Maße persistent wie die Einschreibung auf einem Blatt Papier, wie das Öffnen eines Fensters oder ein ungewollter Nieser schnell verdeutlichen können.

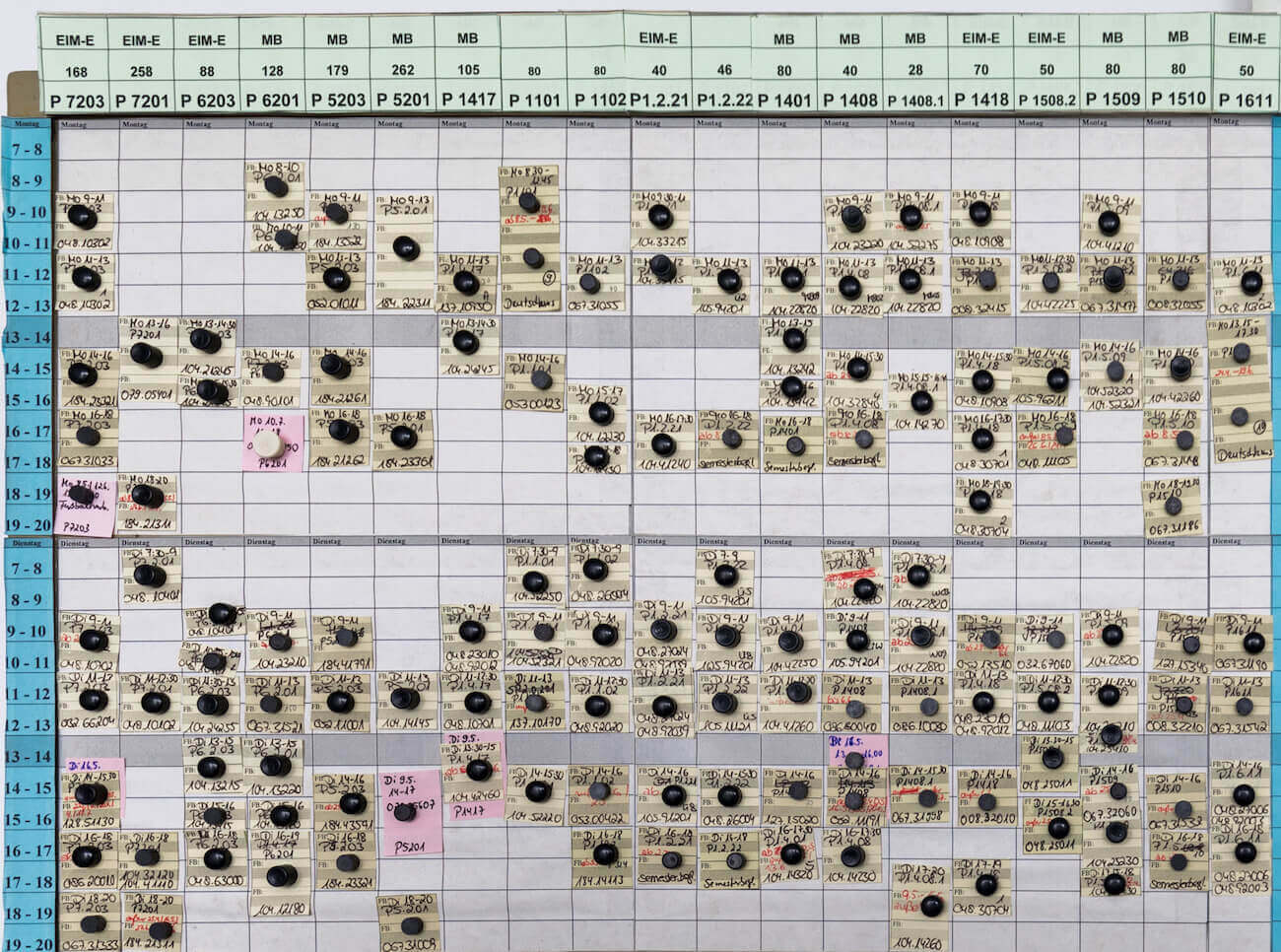

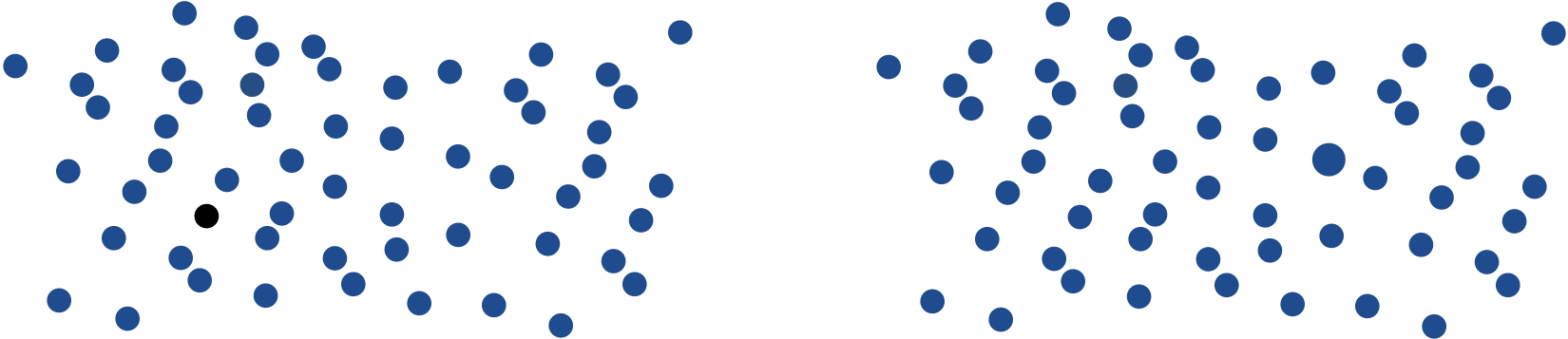

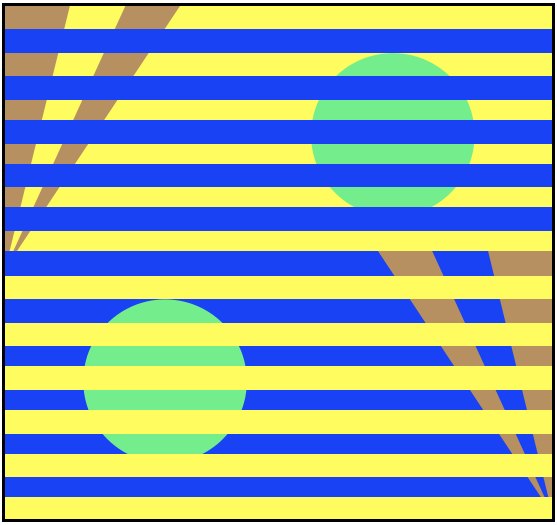

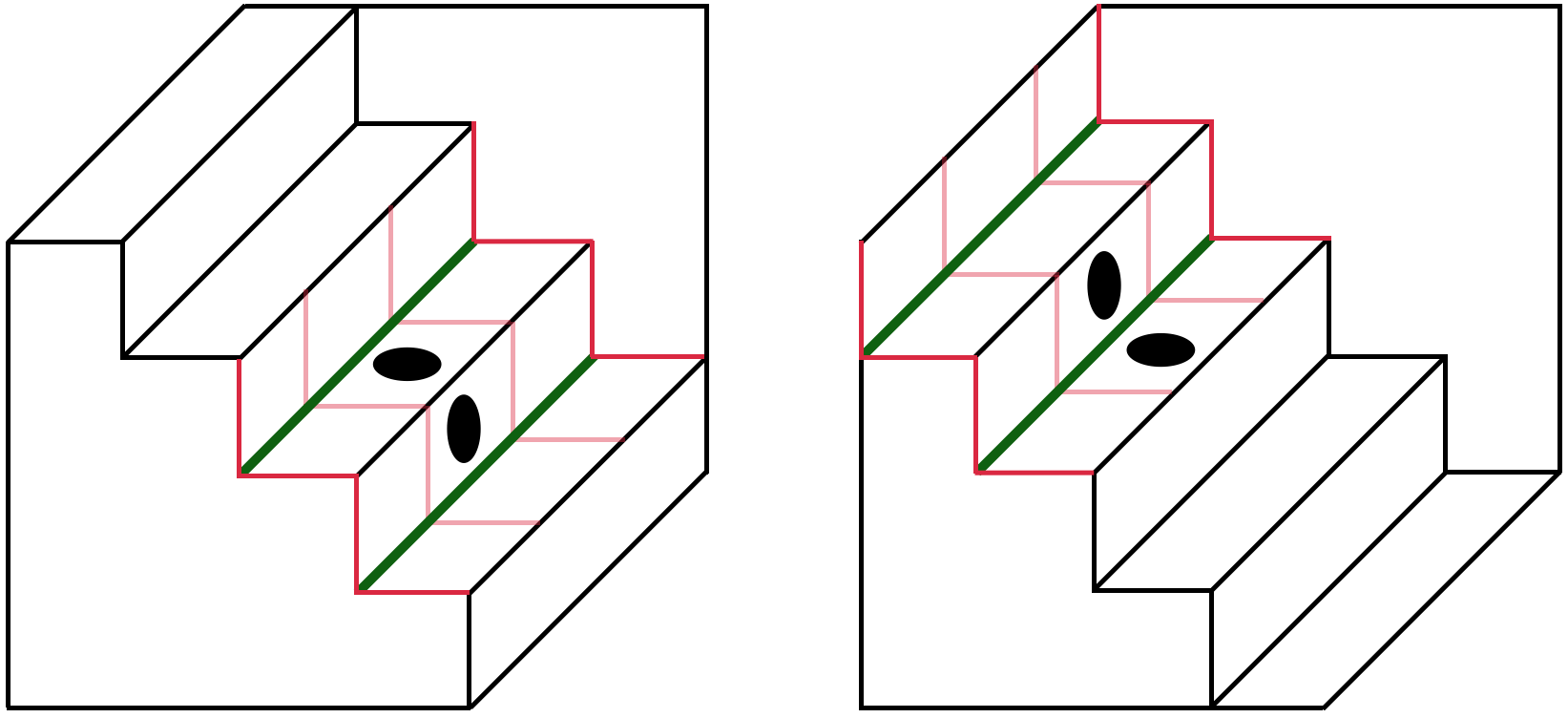

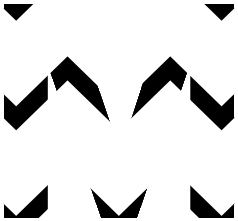

Ein komplexes Beispiel für eine Technik mit kleinen, arrangierbaren Medienträgern ist die obige in einem kleinen Ausschnitt abgebildete Raumplanung. Kleine Karten sind per Magneten an einer stundenplanartigen Struktur befestigt. Gelbe Karten symbolisieren sich wiederholende Veranstaltungen, während rote Karten individuelle Raumbuchungen darstellen. Durch die Tafeln haben die Mitarbeiter der Raumplanung immer die komplette Situation im Überblick. Sie können auf den ersten Blick freie Räume oder sich ergebende Doppelbuchungen erkennen. Durch das Verwenden der kleinen Zettel und der Magnete ist das Arrangement sehr flexibel. Dies geht jedoch stark auf Kosten der Stabilität. Das komplette Arrangement ist recht fragil und ließe sich leicht versehentlich zerstören. Würde man versuchen, das Arrangement zu transportieren, müsste beim Transport große Vorsicht an den Tag gelegt werden. Weniger problematisch in dieser Hinsicht ist der Transport durch ein Foto. Dieses bietet zwar den Vorteil eines Einschreibmediums, indem es den unfallfreien Transport und das Überdauern in der Zeit ermöglicht, hat aber den Nachteil, dass die Flexibilität für Manipulationen verloren geht.

Ergo: Das Eingeschriebene in oder auf einem Träger sorgt einerseits für eine erwünschte Persistenz, erlaubt also, etwas dauerhaft oder wiederholt ins Wahrnehmungsfeld zu bringen. Andererseits führt genau diese Einschreibung dazu, dass die Möglichkeit des Rearrangierens stark eingeschränkt ist. Diese ist nur auf der Ebene der Medienträger, nicht aber auf der Ebene der Zeichen an sich gegeben. Ein auf Papier geschriebener Text kann zerschnitten, rearrangiert und neu zusammengeklebt werden (daher Cut & Paste). Filme wurden früher auf ähnliche Weise „geschnitten“ und neu zusammengeklebt. Auch bei Tonbändern sind das Schneiden und Zusammenkleben auf diese Art möglich.

Digitale Techniken haben ein enormes Potenzial, diesen inhärenten Konflikt zwischen Persistenz und Bearbeitbarkeit neu zu gestalten. Wir werden dieses Potenzial deshalb ausführlicher in unserer Betrachtung von Interaktivität im nächsten Kapitel behandeln.

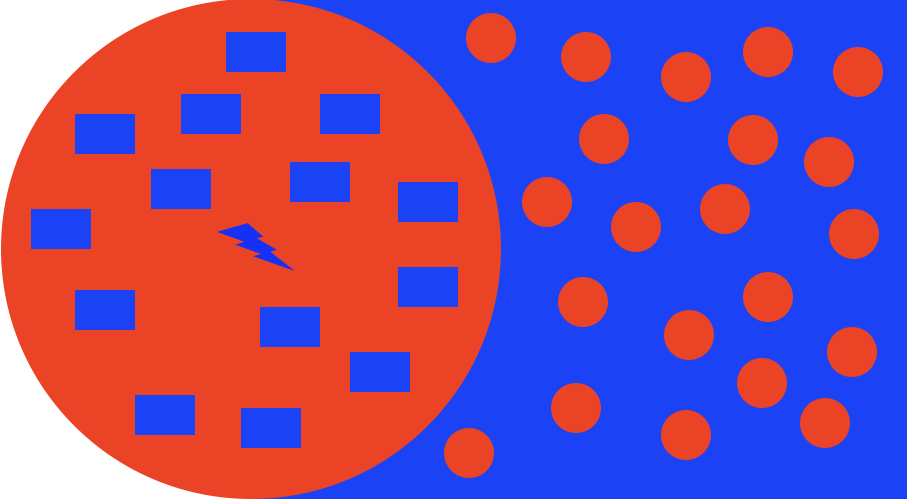

Differenzerfahrung in Nutzungsschnittstellen?

In diesem Kapitel haben wir das Konzept der Differenzerfahrung skizziert und gesehen, dass Differenzerfahrung die Voraussetzung für verlässliche Erkenntnisse über die Umwelt des Menschen ist. Der Computer ist in unserer Betrachtungsweise Teil dieser Umwelt. Bei der Gestaltung von Nutzungsschnittstellen müssen wir dafür sorgen, dass Differenzerfahrungen ermöglicht werden, indem z. B. die Nutzungsschnittstelle den relevanten Status des Systems klar anzeigt oder dadurch dass Objekte der Nutzungsschnittstelle, die sich aufeinander beziehen, auch gemeinsam dargestellt werden können. Die Mittel zur Differenzerfahrung innerhalb der Nutzungsschnittstelle sollten so gestaltet sein, dass sie Hinweise für Anschlusshandlungen liefern. Dazu müssen die Folgen einer Handlung an den virtuellen Objekten der Nutzungsschnittstelle so sichtbar gemacht werden, dass sie als auf die jeweilige Handlung zurückführbare und nachvollziehbare Reaktionen wahrnehmbar sind. Indem ein Handlungs- und Wahrnehmungsraum entworfen wird, der es ermöglicht, Objekte so zu manipulieren, dass die erforderlichen Differenzerfahrungen ermöglicht werden, lässt sich die Erschließbarkeit eines Systems ergonomisch gestalten 10.

Im Weiteren konzentrieren wir uns darauf, gemäß der vorgestellten Sichtweise die technischen Potenziale interaktiver Systeme herzuleiten. Zwar funktionieren unsere heutigen Computer vom Grundprinzip her kaum anders als die Rechenungetüme der 1950er und 1960er Jahre, doch waren die damaligen Nutzungsschnittstellen, und damit die möglichen Nutzungsformen, ganz anders als die heutigen. Im folgenden Kapitel werden wir beleuchten, wie sich Nutzungsschnittstellen entwickelt haben und welche Beweggründe es für diese Entwicklungen gab. Dabei werden wir sehen, dass technische Entwicklungen und das mit ihnen einhergehende Potenzial für Differenzerfahrung (Denkzeug) stets in einem Wechselwirkungsverhältnis stehen.

Potenziale interaktiver Nutzungsschnittstellen

Im vorhergehenden Kapitel haben wir das Konzept der Differenzerfahrung eingeführt und beschrieben, wie mithilfe von Denkzeugen der Bereich des Wahrnehmbaren und damit auch des Bedenkbaren stark erweitert werden kann. Dieses Potenzial geht in der Regel mit einer kognitiven Entlastung einher, denn diese Mittel zur Differenzerfahrung überdauern als physische Objekte meist den Prozess der Erzeugung und ermöglichen dadurch Differenzerfahrungen über verschiedene Orte hinweg (Übertragung) als auch Differenzerfahrungen über die Zeit (externes Gedächtnis). Wir wollen nun diese Ideen möglichst konstruktiv auf die Gestaltung von Nutzungsschnittstellen übertragen. Anhand einer kurzen rückblickenden Betrachtung der Entstehung heutiger Nutzungsschnittstellen werden wir die technischen Prinzipien und Konzepte verdeutlichen, bevor wir dann im Hauptteil diese Einsichten zu einem konkreten Gestaltungsansatz verdichten. Damit können wir zugleich auch den Begriff der Interaktivität aus technischer Sicht präzisieren und einige irreführende Annahmen geraderücken.

Nach unserem Verständnis umfasst eine Nutzungsschnittstelle alle wahrnehmbaren und manipulierbaren Objekte, also z. B. auch Dateien und Ordner im Explorer oder Texte und grafische Objekte in einem Präsentationsprogramm. All diese Objekte existieren nur durch die Ausführung eines Programms. Denn nur innerhalb einer Software wie PowerPoint oder Keynote gibt es beispielsweise die Elemente einer Folienpräsentation, also Grafiken und Texte, als sichtbare und manipulierbare Objekte. Unter der Nutzungsoberfläche existieren sie als Datenstruktur und darunter schließlich als Konfigurationen von Zuständen. Erst eine explizit programmierte Nutzungsschnittstelle erzeugt die Objekte auf dem Bildschirm, macht sie ansprechbar und manipulierbar. Zwingend notwendig sind in all diesen Fällen weitere Objekte wie Buttons oder Menüs, deren einziger Zweck das Zugänglichmachen von Programmfunktionen ist. Jacob Nielsen bezeichnet solche Objekte als Chrome11.

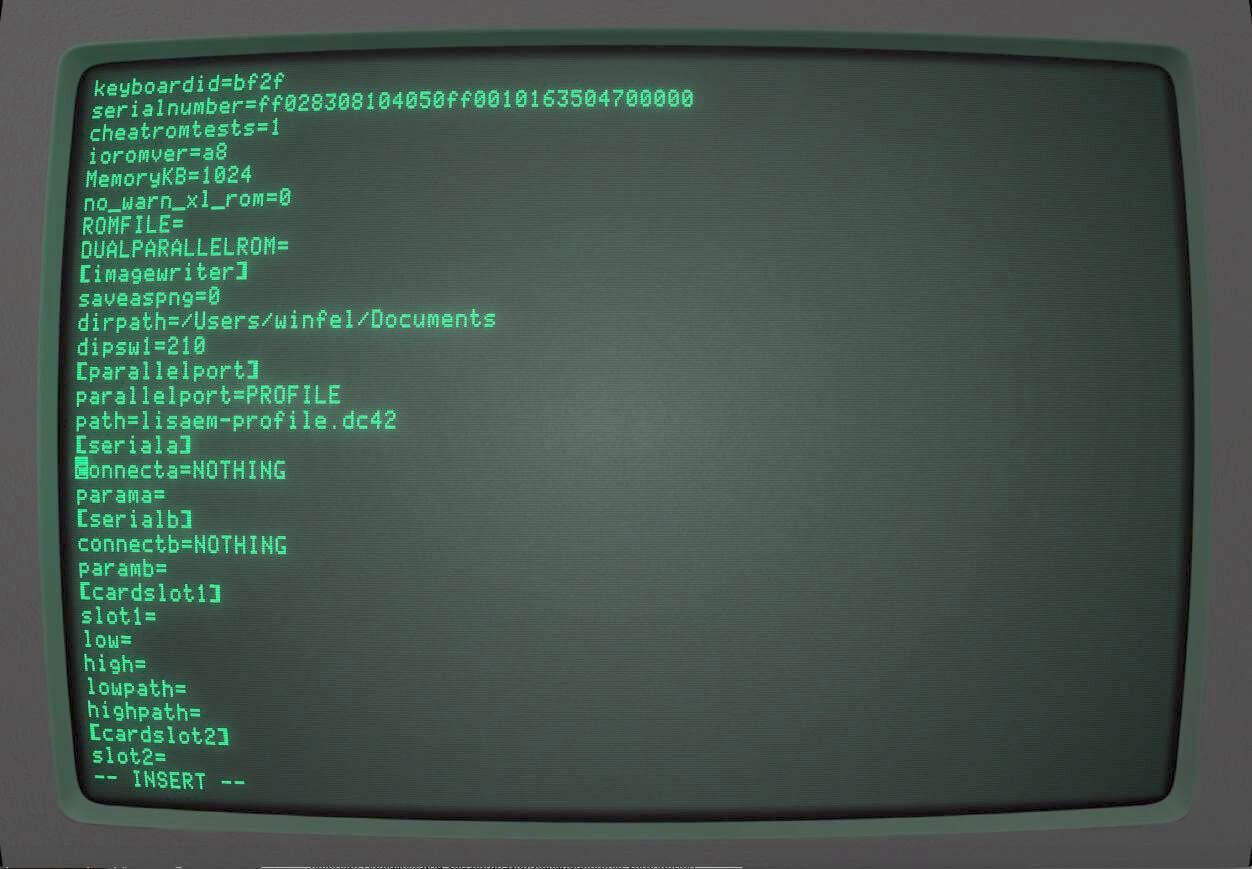

Sowohl dieses Chrome als auch die Datenobjekte entstehen durch die Programmierung der Nutzungsoberfläche. Bruce Tognazzini beschreibt in seinem Buch „Tog on Interface“12 von 1992 die Benutzungsoberfläche des Apple Macintosh als eine „fanciful illusion“, deren Charakter anders sei als das darunter liegende Betriebssystem. Tognazzini zielt mit dieser Beschreibung zwar auf die grafische Nutzungsschnittstelle des Macintosh ab, sein Gedanke trägt aber für Nutzungsschnittstellen generell, denn auch wenn auf einem Unix-System eine Datei auf der Festplatte mit den Befehlen ls gelistet und mit cat ausgegeben wird, geht das nur, weil eine programmierte Nutzungsschnittstelle die Datei als Objekt zur Verfügung stellt. Wenn Sie einen Computer zerlegen, würden Sie keine Dateien finden, selbst wenn Sie die Magnetisierungen auf einer Festplatte oder die Zustände der Bits eines Speichermediums direkt wahrnehmen könnten. Das Betriebssystem liegt als Zwischenschicht13 zwischen der Nutzung und der gerätetechnischen Umsetzung. Es sorgt dafür, dass man sich nicht mit den gerätespezifischen Aspekten der Datei und Speicherverwaltung befassen muss. Ebenso sorgt das Betriebssystem dafür, dass ein Programm nicht etwa unter Angabe einer physikalischen Adresse in den Speicher kopiert werden muss, sondern dass das Programm mit einem Bezeichner angesprochen werden kann und dann automatisch geladen wird. Gemäß dieser Kapselung der technischen Realitäten und der gleichzeitigen Bereitstellung virtueller Objekte für die Nutzung sind in unserer Sichtweise große Teile des Betriebssystems auch Teil der Nutzungsschnittstelle eines Computers.

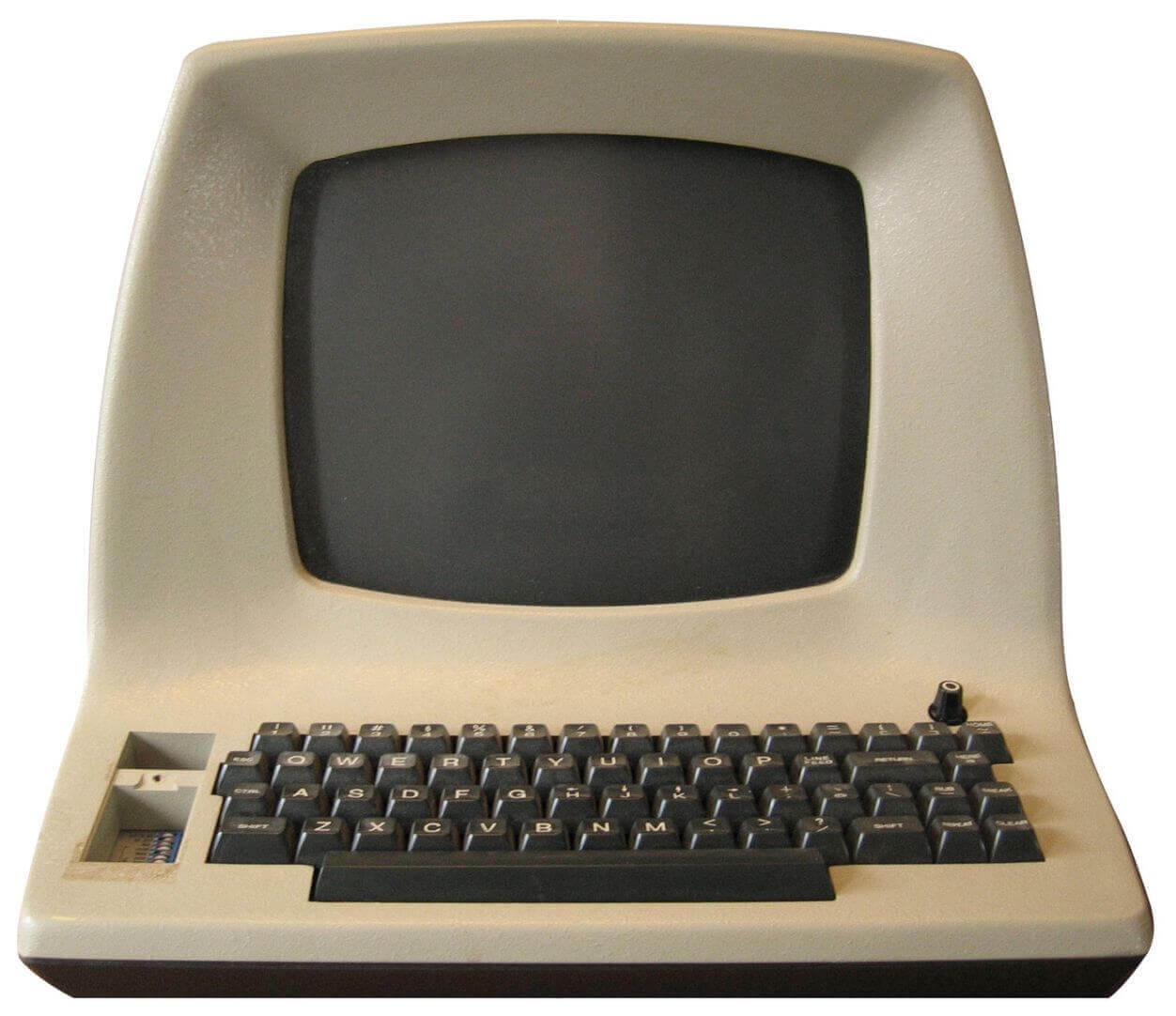

Bei den frühen Computern, die in den 1930er, 1940er und 1950er Jahren gebaut wurden, gibt es noch keine Nutzungsschnittstelle als Zwischenschicht. Die Schnittstellen des Rechners, meist große Bedienkonsolen mit vielen Knöpfen und Lämpchen, entsprachen genau den Hardwarezuständen der Maschine. Es handelte sich um Schnittstellen zur Maschinenüberwachung und -steuerung, nicht um von laufenden Programmen erzeugte virtuelle Objekte. Solche Objekte, die von einem Computer angezeigt und direkt mit dem Computer manipuliert werden können, bedürfen eines interaktiven[^interaktiv] Computers. In diesem Kapitel zeichnen wir anhand der Entwicklung interaktiver Nutzungsoberflächen nach, welche technischen Potenziale diese eröffnen und welche technischen Voraussetzungen gegeben oder entwickelt werden mussten, um sie zu verwirklichen.

Ein Hinweis zur Begriffswahl: Der Begriff „Interaktivität“ wird zwar vielfach verwendet, ist aber kaum definiert. Einen kurzen Überblick über verschiedene Definitionsversuche finden Sie in der Dissertation von Felix Winkelnkemper „Responsive Positioning – A User Interface Technique Based on Structured Space“ auf den Seiten 9 bis 14. Für unsere Zwecke ist es nicht wichtig, eine genaue Definition zu finden, sondern die Eigenschaften der Nutzungsoberflächen herauszuarbeiten, die wir interaktiv nennen. Das ist kein Selbstzweck, sondern die genauere Betrachtung der „Evolution“ der Nutzungsschnittstellen gibt uns wichtige Hinweise auf Gestaltungspotenziale. Potenziale verkörpern immer nur Möglichkeiten, keine Zwangsläufigkeiten. Sie können einen Mehrwert entfalten, müssen dies aber nicht. Manchmal ist das auch nicht gefragt oder gewollt. Oft jedoch entsteht aus dem verschenkten Potenzial ein ergonomisches Problem. Viele der Anforderungen der Kapitel Rückmeldung, Eingabeminimalität und Übergänge, die wir später behandeln werden, können beispielsweise direkt aus solchen Potenzialen abgeleitet werden.

Wir erarbeiten in diesem Kapitel die besagten Potenziale digitaler Nutzungsschnittstellen durch eine Betrachtung ihrer Entstehungsgeschichte. Das kann an dieser Stelle nur schlaglichtartig erfolgen. Es gäbe zur Computergeschichte gerade unter dem Aspekt der Entwicklung von Nutzungsschnittstellen noch viel mehr zu sagen. Wenn Sie das Thema interessiert, können wir Ihnen das Buch „Interface Evolution“14 empfehlen, welches die Thematik sehr viel umfangreicher behandelt und vor allem auch die Entwicklung der Nutzungsschnittstelle des PCs einbezieht; sie muss an dieser Stelle außen vor bleiben. Für unsere Zwecke reicht es zu skizzieren, welche Ziele und Vorteile jeweils mit der nächsten Entwicklungsstufe des Computers verbunden waren, um darüber die technischen Potenziale zu bestimmen, die wir in Gestaltungskonzepte umsetzen können. Dabei möchten wir zugleich verdeutlichen, wie durch technische Innovationen unnötige Arbeitsschritte eingespart werden können, die weder explizit gefordert werden noch zur Erledigung der jeweiligen Aufgabe erforderlich sind. Vielmehr sind sie der Wahl des jeweiligen Denkzeugs bzw. seiner Ausgestaltung geschuldet. In diesem Sinne bedeutet ergonomische Gestaltung für uns zweierlei: zum einen Belastungen zu vermeiden, zum anderen neue Handlungsmöglichkeiten zu erschließen.

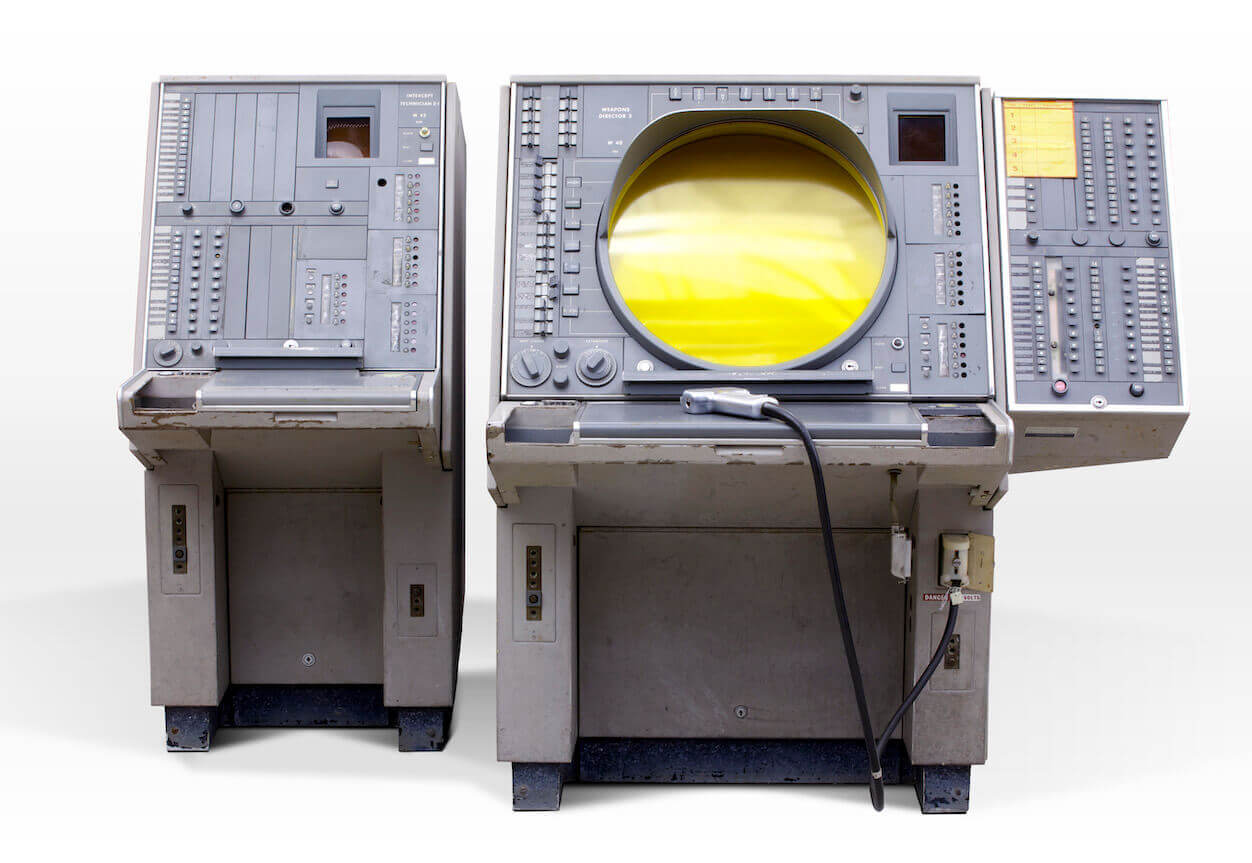

Programmierung durch Verkabelung

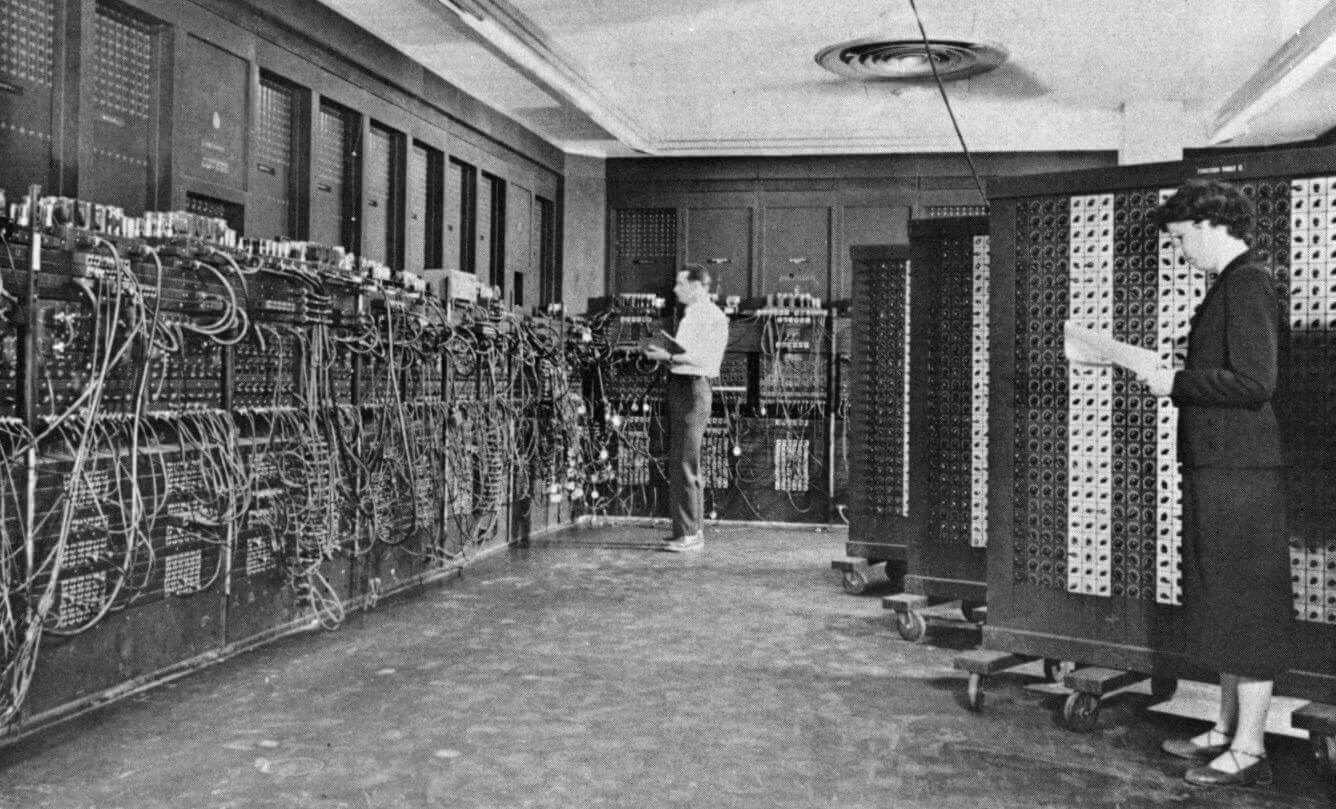

Des amerikanische ENIAC wird oft als erster digitaler Computer aufgeführt. Dieser von 1943 bis 1945 für das amerikanische Militär gebaute Rechner war dreißig Tonnen schwer, füllte eine Halle und hatte eine Leistungsaufnahme von sage und schreibe 150 kW. Er war unter anderem für komplexe Berechnungen wie etwa ballistische Flugbahnen konzipiert worden. Seine auffälligste Eigenheit war jedoch, dass er per Verkabelung programmiert wurde und dass Werte unter anderem durch das Stellen von Drehschaltern eingegeben wurden.

Das obige Bild zeigt eine typische Ansicht des ENIAC. Auf der linken Seite sehen Sie das Programm in Form der Verkabelung der Hardwaremodule des Rechners. Auf der rechten Seite sind auf fahrbaren Gestellen angebrachte Anordnungen von Drehschaltern zu sehen, mit denen Werte eingestellt werden konnten. Programmieren bedeutete beim ENIAC etwas anderes, als man es sich heute vorstellt. Der ENIAC war ohne Programm, also ohne gesteckte Kabel, einfach nur eine Sammlung von Hardwaremodulen wie einem Taktgeber, Akkumulatoren, Multiplikatoren, Dividierern, Einstellfeldern sowie Druckern, Lochkartenlesern und -stanzern für die Ein- und Ausgabe. Den ENIAC zu programmieren bedeutete, diese Module der gewünschten Berechnung entsprechend miteinander zu verbinden. Ein Programm beim ENIAC war also nicht mit dem erst etwas später eingeführten Begriff „Programm“ im heutigen Sinne zu vergleichen. Gemäß der Konzeption von John von Neuman (1945) wird unter einem Programm eine Folge von Anweisungen verstanden, die dazu dient, den Computer zu steuern. Ein Programm wird Anweisung für Anweisung abgearbeitet. Beim ENIAC kann man das nicht sagen, denn er verarbeitete kein Programm und das Programm steuerte auch nicht den ENIAC. Er verkörperte vielmehr einen Bausatz, der für jedes Programm neu zusammensetzt werden musste. Der ENIAC, der die Funktion A ausführen konnte, war also genau genommen nicht der gleiche Computer wie der, der die Funktion B ausführen konnte.

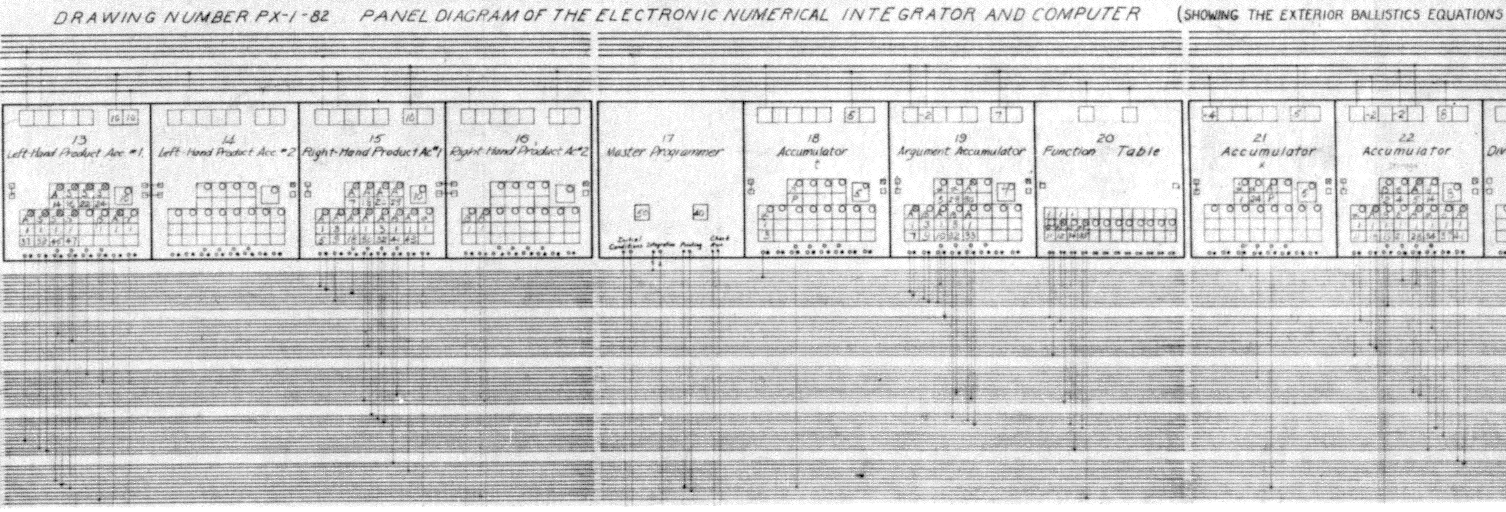

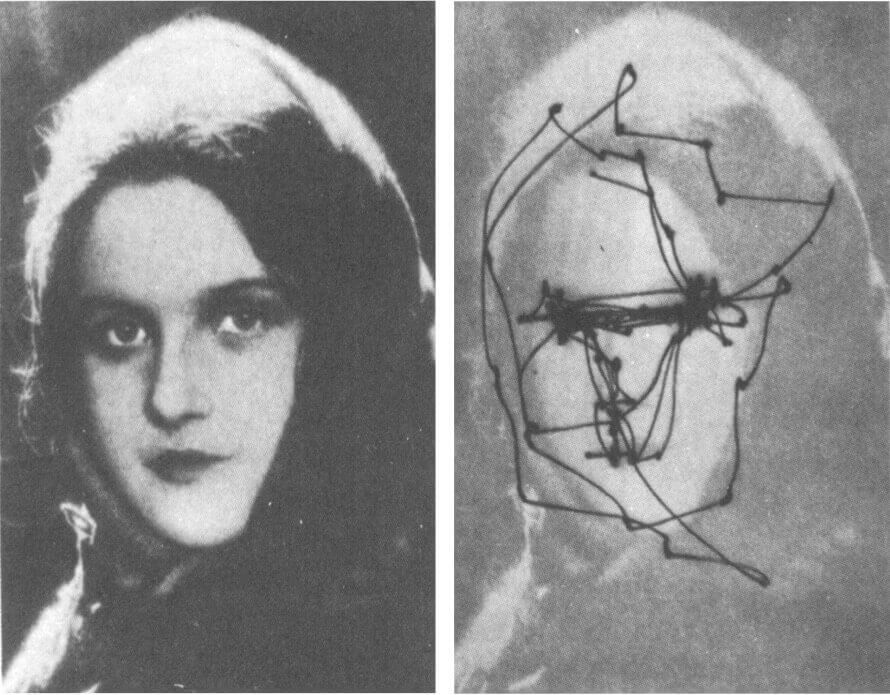

Ein Programm für den ENIAC, also seine Verkabelung zum Ausführen einer speziellen Berechnung, wurde auf Papier geplant. Oben ist ein Ausschnitt aus einem solchen „Panel Diagram“ abgebildet. Das Erstellen solcher Pläne dauerte oft Wochen, das Programmieren des Rechners durch das Stecken von Kabeln dauerte mehrere Tage. Die eigentliche Berechnung erfolgte, wenn er bestimmungsgemäß funktionierte und bei der Planung und der Verkabelung kein Fehler passiert war. Innerhalb weniger Minuten oder Stunden war eine Berechnung erledigt.

Computernutzung ohne Computerkontakt

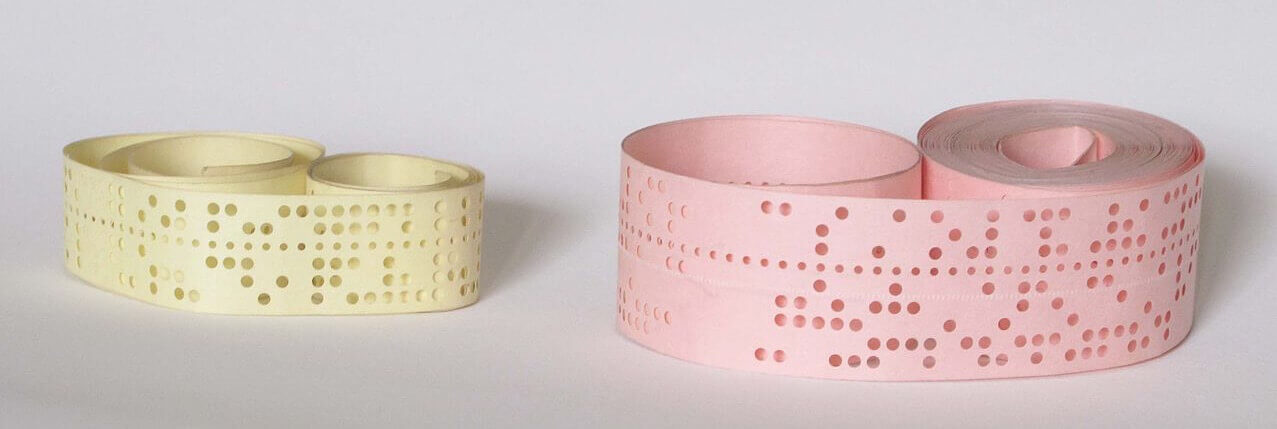

Eine Programmierung durch Konfiguration und Verkabelung von Hardware-Bausteinen war nicht komfortabel und in Bezug auf mögliche Differenzerfahrungen äußerst unzureichend. Spätere Computer (und auch manch frühere) funktionierten deshalb auch nicht mehr auf diese Art und Weise. Um sie zu programmieren, wurde nicht mehr neu verkabelt, sondern ein symbolisches Programm im modernen Sinne wurde von einem Medium eingelesen und zumeist im internen Speicher abgelegt. Typische Medien für Programme waren zunächst Lochstreifen und Lochkarten.

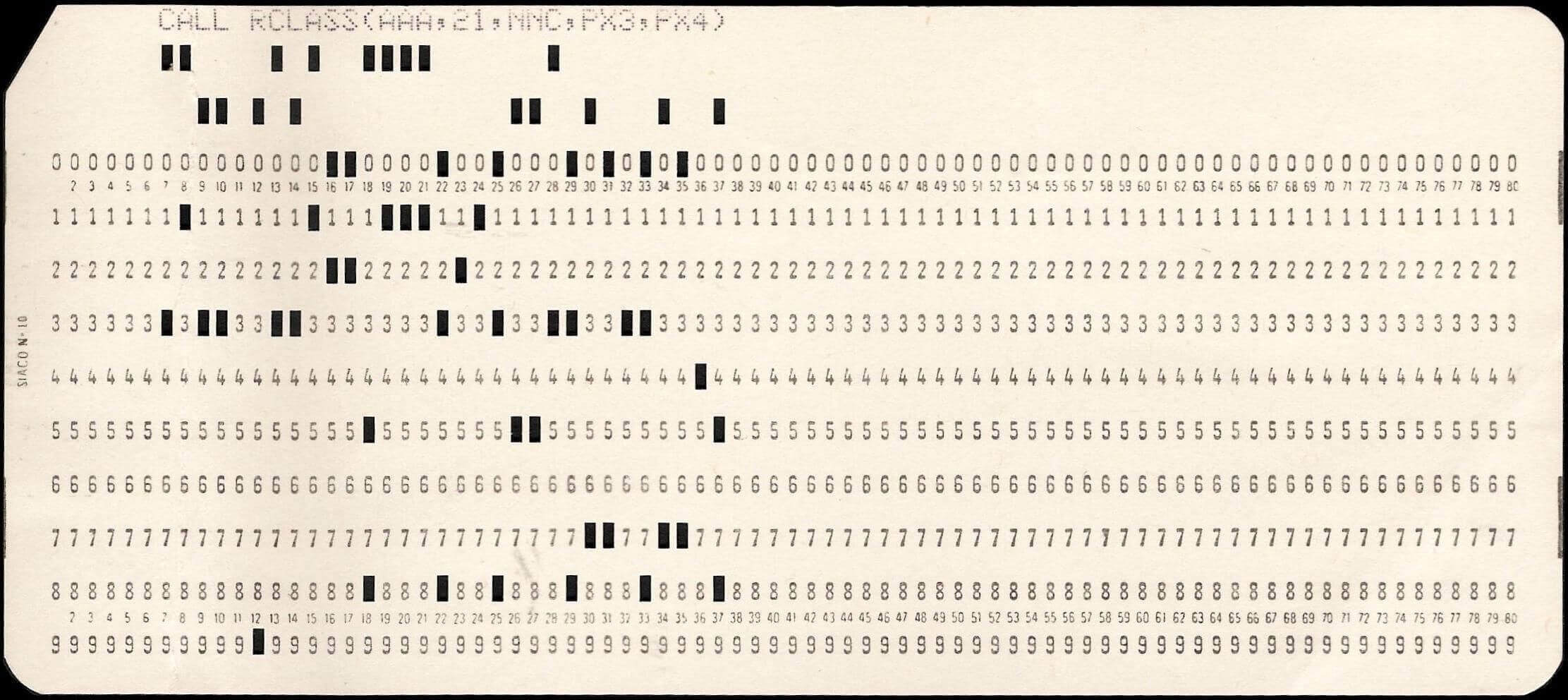

Lochstreifen sind, wie oben zu sehen ist, Papierstreifen mit einer Perforation für den Transport durch einen entsprechenden Leser oder Stanzer. Auf diesen Streifen werden Reihen von Löchern gestanzt. Eine solche Reihe ist jeweils eine binäre Codierung eines Zeichens, also eine Codierung in Ja und Nein, 1 und 0 oder wie in diesem Fall Loch und Nicht-Loch. Typische Lochstreifen ermöglichten pro Zeile 5 oder 8 Löcher je nach eingesetztem System. Die wichtigste Alternative zu Lochstreifen waren Lochkarten. Das Prinzip einer Lochkarte ist dem eines Lochstreifens grundsätzlich sehr ähnlich. Statt eines kontinuierlichen Papierstreifens wurde jedoch eine Vielzahl von Papierkarten verwendet. Ein Lochkartenleser liest einen Lochkartenstapel Karte für Karte ein. Beschrieben werden können Lochkarten mithilfe von Lochkartenstanzern. Üblicherweise entsprach eine Karte einem Datensatz oder, im Falle der Programmierung, einer einzelnen Programmzeile, so etwa auch im unten abgebildeten Beispiel, das zugleich einen weiteren Vorteil offenbart: Neben dem Stanzcode ermöglicht das Trägermedium auch die äquivalente symbolische Beschriftung (im Bild am oberen Rand). Ein weiterer wichtiger Vorteil von Lochkarten war, dass das Trägermedium nicht ein einziges (langes) Artefakt war, sondern feingranularer aufgebaut ist. Dadurch wurden nicht nur lokale Änderungen erheblich vereinfacht, sondern auch die Möglichkeiten, einzelne Karten räumlich oder zeitlich verteilt zu erstellen, sie zusammenzuführen und ihre Reihenfolge zu ändern.

Mit Ausnahme weniger früher Computer wurde bei den meisten Geräten das Programm vor der Ausführung komplett eingelesen und in den internen Speicher des Computers übertragen. Um einen solchen „Stored Program Computer“ zu nutzen, mussten sowohl das Programm als auch alle Eingabedaten vor dem Programmablauf vorliegen. Wenn ein neues Programm geschrieben wurde, geschah dies in einem umständlichen und aufwändigen Prozess:

- Das Programm wurde auf Papier in einer Assembler-Sprache sehr nah am Maschinencode ausgearbeitet. Auch höhere Programmiersprachen waren möglich. Diese kamen aber erst Anfang der 1960er Jahre auf.

- Aus dem Assembler-Code musste das Programm in die Maschinensprache umcodiert werden. Aus Befehlen, die aus kurzen Buchstabenfolgen bestanden, etwa JMP für den Sprungbefehl, wurden Zahlenwerte, die der Computer direkt verarbeiten konnte.

- Dieses Maschinensprachenprogramm musste nun auf Lochkarten oder Lochstreifen übertragen werden.

- Die Lochkarten oder Lochstreifen mit dem Programm und allen Eingabedaten wurden einem Operator übergeben. Der Operator verwaltete eine Warteschlange von Programmen, die vor dem eigenen noch abzuarbeiten waren.

- Wenn das eigene Programm an der Reihe war, ließ der Operator es einlesen, legte die Eingabedaten in den Lochstreifen- oder Lochkartenleser und startete das Programm.

- Resultate des Programms wurden auf einem Drucker ausgegeben.

- Der Operator legte das Programm, die Eingabedaten und die ausgedruckten Ausgaben des Programms in einem Ausgabefach bereit, wo sie abgeholt werden konnten.

Charakteristisch für diese Arbeitsweise ist, dass die Prozesse der Entwicklung und des Ausführens von Programmen personell und räumlich getrennt waren. Ein Programm musste korrekt in Assembler-Sprache auf Papier programmiert, ggf. fehlerfrei in Maschinencode übertragen und dann auch noch korrekt abgelocht worden sein. Auf all diesen Ebenen konnten Fehler passieren, die sich aber erst während der Ausführung offenbarten. Zudem war es bei dieser Art der Computernutzung nicht möglich, ein Programm zu schreiben, bei dem abhängig vom Programmablauf Entscheidungen getroffen wurden. Alle Entscheidungen mussten vor Beginn der Programmausführung getroffen werden. Die zugrundeliegenden Prinzipien sind unter dem Namen John von Neumanns veröffentlicht. In diesem „First Draft Report on the EDVAC“15 von 1945 wird ausgeführt:

An automatic computing system is a (usually highly composite) device, which can carry out instructions to perform calculations of a considerable order of complexity — e.g. to solve a non-linear partial differential equation in 2 or 3 independent variables numerically. The instructions which govern this operation must be given to the device in absolutely exhaustive detail. They include all numerical information which is required to solve the problem under consideration: Initial and boundary values of the dependent variables, values of fixed parameters (constants), tables of fixed functions which occur in the statement of the problem. These instructions must be given in some form which the device can sense: Punched into a system of punchcards or on teletype tape, magnetically impressed on steel tape or wire, photographically impressed on motion picture film, wired into one or more fixed or exchangeable plugboards—this list being by no means necessarily complete. All these procedures require the use of some code to express the logical and the algebraical definition of the problem under consideration, as well as the necessary numerical material.

Once these instructions are given to the device, it must be able to carry them out completely and without any need for further intelligent human intervention. At the end of the required operations the device must record the results again in one of the forms referred to above. The results are numerical data; they are a specified part of the numerical material produced by the device in the process of carrying out the instructions referred to above. (Hervorhebung nicht im Original)

Von Neumann beschreibt hier einen Computer, bei dem Programme „without any need for further intelligent human intervention“ ablaufen. Von einer Nutzungsschnittstelle spricht er an keiner Stelle. Auch Computer, wie von Neumann sie charakterisierte, brauchten einige Bedienelemente. Dazu gehörten unter anderem Knöpfe zum Ein- und Ausschalten, zum Starten und Unterbrechen der Operation und zum Einlesen des Programms und der Daten vom Lochkarten- bzw. Lochstreifenleser. In der Tat gab es aber für die eigentliche Funktion des Computers, das Programm selbst, keinerlei Nutzungsschnittstelle. Das Programm lief völlig ohne menschliche Intervention ab. Zwar wurde bei dieser Art von Computern nicht mehr neu verkabelt, um zu programmieren, doch waren Bedienelemente und Anzeigen unabhängig von der jeweiligen Anwendung. Sie zeigten die Funktion von Systemkomponenten an oder gaben direkt den Inhalt von Registern und Akkumulatoren aus und erlaubten deren Manipulation zum Zweck der Fehlerbeseitigung. Sie dienten nicht zur Steuerung des Programmablaufs oder der Eingabe zusätzlicher Daten.

Während das Personal der Rechenzentren in der Frühzeit der Computer noch mit den Datenträgern der Programme und Daten in Kontakt kam, wurden im Laufe der nächsten Jahre die Abläufe zunehmend verkürzt und vereinfacht. Computer wurden im sogenannten Batch-Modus betrieben. Ein Rechenauftrag, üblich war der Ausdruck „Job“, wurde mittels einer vorgelagerten Maschine zunächst auf Magnetbänder übertragen. Der eigentliche Hauptcomputer arbeitete diesen Stapel von Jobs, den „Batch“, nach und nach ab. Ausgaben wurden wiederum auf Magnetbänder geschrieben, die später in eine nachgelagerte Maschine eingelesen wurden, die die Daten auf Papier druckte. Auf diese Art und Weise wurde der Rechenablauf optimiert, da die teure Recheneinheit nicht mehr darauf warten musste, dass neue Lochkarten oder Lochstreifen von langsamen Lesegeräten eingelesen oder Zeichen auf langsamen Ausgabegeräten gedruckt werden mussten. Personen, die die Jobs programmierten, konnte die Optimierung der Zuführung von Programm und Daten egal sein, denn sie kamen mit dem Computer ohnehin nicht direkt in Berührung. Der komplette Programmierprozess war nach wie vor vorgelagert und fand nur mit analogen, mechanischen Mitteln statt. Programmiert wurde auf sogenannten „Codierbögen“. Dies geschah üblicherweise nicht direkt im Maschinencode des Computers, sondern zumindest in Assembler-Code, zumeist aber in einer höheren Programmiersprache wie Fortran, Algol, COBOL oder LISP.

Die große Verzögerung zwischen Programmabgabe und der Ergebnispräsentation stellte ein gravierendes Problem dar, da es kaum jemals gelingt, ein komplexes Programm auf Anhieb korrekt zu schreiben. Meist gibt es Fehler, sowohl syntaktischer als auch semantischer Art. Gerade die semantischen Fehler sind die problematischen, denn bei ihnen kann das Programm durchaus syntaktisch korrekt ausgeführt werden, es tut aber nicht, was man von ihm erwartet. Weil Fehler jedoch erst nach Stunden offenbar wurden, erforderte die Fehlerbeseitigung zusätzlichen organisatorischen und mentalen Aufwand. Heute dagegen ist es möglich, ein Programm bei einem auftretenden Fehler schnell zu korrigieren. Das heute übliche Programmieren durch schrittweises Annähern an die gesuchte Lösung hätte damals Tage bis Wochen gedauert.

Responsivität: Echtzeit-Computer