人工智慧的擔憂和風險

|

圍繞人工智慧的擔憂是嚴重的。風險是真實存在的。有時這些擔憂表達得非常激進,但當你深入探討時,人工智慧的影響有潛力造成巨大的破壞。 |

關於人工智慧的問題和擔憂有很多,足以填滿數卷書。我監控的主題詞雲如下。我肯定還漏掉了一些。

關於這些主題有很多可用的信息,我鼓勵你儘可能深入閱讀。你可能會得出風險大於收益的結論,並且你不想在個人或組織中使用人工智慧。這種決定有其自身的風險;通常是被落在後面。但這是一個個人的選擇。

如果你在谷歌上搜索“關於人工智慧風險的書籍”,你會找到一系列值得閱讀的書籍。我最近發現的一個特別令人不安的播客是Ezra Klein 與 Dario Amodei 的對話,Anthropic 的聯合創始人兼 CEO(該公司開發了 Claude.ai)。你會了解到這些公司意識到風險。Amodei 提到一個名為 A.S.L. 的內部風險分類系統,代表“人工智慧安全級別”(不是美國手語)。我們目前處於 ASL 2,“系統顯示出早期的危險能力,例如提供如何製造生物武器的指示。” 他描述 ASL 4 為“使國家級行為者大幅提高其能力……我們擔心北韓、中國或俄羅斯可能在各種軍事領域利用人工智慧大幅增強其進攻能力,從而在地緣政治層面上獲得實質性優勢。”這真是令人不寒而慄。

在這個嚴峻的背景下,我將強調對作家和出版社最相關的問題。

版權被侵犯了嗎?

|

版權問題是複雜和模糊的迷霧。顯然,有一些仍在版權保護期內的書籍被納入了一些大型語言模型的訓練中。但與一些作家擔心的情況不同,並不是他們的所有作品都被每一個大型語言模型全數吸收。 |

版權問題既具體又廣泛。眾所周知,所有的大型語言模型都是在開放網絡上訓練的——從當前網絡上的15億個網站中抓取的內容,無論是報紙文章、社交媒體帖子、網絡博客,甚至是YouTube視頻的轉錄文本。

可以證明 至少有一個大型語言模型吸收了數千本不在公共領域的書籍的實際文本。

在沒有向作者支付任何補償的情況下,將這些文本用於建立數十億美元的人工智慧公司是否合法?人工智慧公司依據合理使用來辯護;法院最終會做出裁決。即使這是合法的,這是否合乎道德或倫理?倫理問題似乎比法律考量更不複雜。你來決定。

圍繞版權的法律顯然沒有預見到人工智慧帶來的獨特挑戰,尋找法律解決方案需要時間,可能需要數年。(如果你想深入了解為什麼現行法律不適合解決這個特定問題,請閱讀A. Feder Cooper和James Grimmelmann撰寫的出色論文《文件在電腦裡:版權、記憶和生成型AI》)

版權與AI對作家的影響

|

作家面臨著有關人工智慧生成內容的版權問題。 |

美國版權局對人工智慧生成內容的版權立場表示,人工智慧本身不能擁有版權,因為它缺乏作者的法律地位。這是有道理的。但這假設100%的作品都是由人工智慧生成的。如同在其他地方討論的,很少有作家會讓人工智慧生成整本書。更可能的是5%,或10%或… 在這裡,版權局也會陷入困境(我也會)。

在最近的一次裁決中,版權局認為由人類撰寫的文本與由Midjourney人工智慧服務生成的圖像組成的圖像小說構成了可版權保護的作品,但單個圖像本身不能受到版權保護。天啊!

|

簡而言之,作家和出版社需要對多方面的版權問題保持警覺。 |

長期影響是什麼?

一些人將目前的訴訟比作Google圖書訴訟,該訴訟花了10年時間才在法律上解決。誰知道這些訴訟的上訴過程將拖延多久。與此同時,出版社應該審慎地行事,假設人工智慧公司會輸,這至少理論上會使任何授權使用或甚至使用Chat AI的人暴露在某種或有責任之下。

但這不是出版社最嚴重的問題。這是一種感知。對於許多作家,有些是知名的,有些是默默無聞的,這口井已經被毒化了。人工智慧在寫作和出版界是放射性的。任何沾上人工智慧的東西都會引起強烈的批評。

有很多例子。最近的一起事件中,致力於現代成人科幻小說、奇幻小說和WTF的英國出版商Angry Robot宣布將使用名為Storywise的人工智慧軟件來篩選預期的大批量手稿提交。公司花了僅五個小時就放棄了這個計劃並回到了“舊收件箱”。

貿易出版商在內部使用人工智慧工具時面臨的難以忍受的兩難境地:如果你的作者發現了,你將很難應對隨之而來的風暴。我相信出版商別無選擇,只能勇敢地採用(至少部分)這些工具,清楚地解釋這些工具是如何訓練和使用的,並繼續前進。

在英國,The Society of Authors 採取強硬的立場:“請你的出版商確認,其不會在與你的作品相關的任何用途上大量使用人工智慧——如校對、編輯(包括真實性閱讀和事實核查)、索引、法律審查、設計和佈局,或在未經你同意的情況下使用於其他任何用途。你可能希望禁止人工智慧進行有聲書解說、翻譯和封面設計。”

The Authors Guild 似乎接受“出版商開始探索在日常運營中使用人工智慧作為工具,包括編輯和營銷用途。”我不認為公會的許多成員都這麼理解。

將內容授權給人工智慧公司

大多數出版商和許多作者都在尋找將內容授權給人工智慧公司的方法。每個人對授權條款應該是什麼以及他們的內容價值多少都有不同的看法,但至少討論已經開始。

有幾家初創公司正在尋求與出版商(在某些情況下,與個別作者)合作。Calliope Networks 和 Created by Humans 在這方面都很有趣。

七月中旬,版權清算中心(Copyright Clearance Center),長期以來是集體版權授權領域的主要玩家,宣布在其年度版權授權(ACL)中提供“人工智慧(AI)重用權利,這是一項企業範圍的內容授權解決方案,為訂閱的企業提供數百萬作品的權利。”

Publishers Weekly 報導了這一公告,並引用了CCC總裁兼首席執行官Tracey Armstrong的話:“可以既支持人工智慧又支持版權,並將人工智慧與對創作者的尊重結合起來。”

雖然這不包括所有內容,但這可能是推動出版業與大型語言模型開發者達成某種合作的突破。

避免人工智慧已經太遲了

|

對於不希望被人工智慧玷污的作者和出版商來說,消息不妙:你今天正在使用人工智慧,並且已經使用了多年。 |

人工智慧,以不同的形式,已經集成到我們每天使用的大多數軟體工具和服務中。人們依賴於像Microsoft Word或Gmail這樣程式中的人工智慧驅動的拼寫和語法檢查。Microsoft Word和PowerPoint應用人工智慧來提供寫作建議,提供設計和佈局推薦等等。虛擬助理如Siri和Alexa使用自然語言處理來理解語音命令並回答問題。電子郵件服務利用人工智慧來過濾信息,檢測垃圾郵件並發送警報。人工智慧驅動的客服聊天機器人和基於你的購買歷史生成產品推薦。

而這些大多數是基於大型語言模型,如ChatGPT。

對於一位作者或編輯來說,說“我不希望在我的手稿上使用人工智慧”,從廣義上講,幾乎是不可能的,除非他們和他們的編輯都使用打字機和鉛筆工作。

他們可以嘗試說,“我不希望使用生成式人工智慧”在他們的書上。但這是一個難以切割的問題。語法檢查軟體最初並不是基於生成式人工智慧構建的。Grammarly 已經將其作為其產品的一部分,所有其他拼寫和語法檢查器也將如此。生成式人工智慧也是提供的營銷軟體的核心。

當作者使用人工智慧

作者使用人工智慧的另一個方面與上面討論的版權問題有相似之處。在極端情況下,我們看到100%由人工智慧生成的內容在亞馬遜上發布。大多數(全部?)質量都很差,但這並不妨礙其發布。(另見亞馬遜部分。)對於出版商來說,更令人擔憂的是人工智慧生成的投稿。是的,人工智慧提高了數量,但大型出版商已經有一個過濾數量的過濾器。這些過濾器被稱為代理。他們將是那些必須弄清楚如何處理數量問題的人,顯然他們將不得不找到一個不使用人工智慧的解決方案。

這是一個存在問題——我真的想出版一本由「機器」寫的書嗎?對於大多數出版商來說,這是一個明確的「不」。簡單明瞭。那麼,如果一本書的50%內容是在一位有能力的作者監督下由 LLM 生成的呢?嗯,我們也試試「不」。好吧,那麼25%、10%或5%呢?你在哪裡劃界限?

既然你已經進入了劃界限的行業,那麼你如何解決拼寫和 語法工具現在至少部分依賴生成式 AI 的困境呢?那麼像 Otter.ai 或 內建於 Microsoft Word 的轉錄功能 這樣的 AI 驅動的轉錄工具呢?

我找不到任何貿易出版商聲明他們不會出版含有預定數量的 AI 生成文本的作品。以下是作家公會對此話題的看法:

「如果你的手稿中包含大量 AI 生成的文本、角色或情節,你必須向你的出版商披露,並且應該也向讀者披露。我們認為,當 AI 僅用於頭腦風暴、想法生成或文案編輯時,作者不必披露生成式 AI 的使用。」

不言而喻,「顯著的」並未明確定義(牛津字典將其定義為「足夠大到可以被注意到或認為重要」),但該帖子繼續解釋說,包含超過「微不足道 的 AI 生成文本」將違反大多數出版合同。微不足道 在法律術語中沒有精確的規定,但一般來說,意味著與顯著差不多。

AI 能夠在寫作中被檢測出來嗎?

我在2024年5月主持了一場由 BISG 贊助的關於 AI 檢測的網絡研討會。重播在 YouTube 在線。Jane Friedman 在她的 Hot Sheet 電子報中提供了一篇 全面的網絡研討會寫作。

對於許多作者來說,AI 的毒性意味著將其遠離他們的文字。出版商承擔著特殊的責任——他們不創造文本,但一旦出版,他們就對文本承擔了重大義務。我們已經看到很多引爆點接近煽動性書籍,無論是關於內容的社會影響,還是對其他作家文字和想法的剽竊。現在有了 AI,我們面臨一整套新的倫理和法律問題,這些問題在出版學校中都沒有提到。

部分擔憂類似於人們對學生的擔憂,即使用 AI 是某種作弊,類似於從維基百科文章中抄襲,或者只是讓朋友幫你寫文章。

我們的網絡研討會其中一位演講者,教育家 José Bowen,分享了他給學生的披露。這並不完全適用於作者,但它展示了某種 AI 使用的「風險等級」。

學生披露協議範本

這些工作都是我自己完成的,沒有朋友、工具、技術或 AI 的幫助。

-

我完成了初稿,但請朋友/家人、AI 改寫/語法/抄襲軟件閱讀並提出建議。在這些幫助之後,我做了如下修改:

修正了拼寫和語法

改變了結構或順序

重寫了整個句子/段落

我在遇到問題時使用了詞典、字典、打電話給朋友、去幫助中心、使用 Chegg 或其他解決方案提供商。

我使用了 AI/朋友/導師來幫助我生成想法。

我使用了幫助/工具/AI 來做大綱/初稿,然後我進行了編輯。(描述你的貢獻性質。)

因此,出版商可以為他們的作者起草類似的東西。假設作者披露了最高級別:我廣泛使用了 AI,然後編輯了結果。然後怎麼辦?你會自動拒絕手稿嗎?如果是,為什麼?

同時,如果你在注意,你會發現你剛剛讀過並喜愛的手稿,作者發誓甚至沒有用 Grammarly 檢查拼寫,實際上可能有 90% 是由 AI 生成的,由一位擅長隱藏其使用的作者完成。

你被迫重新思考這個問題。問題變成了,「為什麼我如此堅定地想要檢測這個無法檢測的東西?」

部分原因是對AI生成文本的著作權性問題的警告關注。版權局不會為100%由AI生成的文本(或音樂、圖像等)提供版權保護。但如果是50%由AI生成的文本呢?好吧,我們只會涵蓋由作者生成的50%。那你怎麼知道是哪一半呢?我們會再跟你聯繫。

如果你能將每個手稿輸入某些軟體,然後告訴你是否使用了AI來創建文本,那該多好?

撇開唯一能做到這一點的方法是使用AI工具不談,更重要的問題是,這些軟體是否(足夠)準確?我能依賴它告訴我是否使用了AI來創建手稿嗎?我能依賴它不產生“假陽性”——即表示使用了AI,而實際上並沒有嗎?

現在市面上有很多軟體來解決這些挑戰。許多學術研究評估這些軟體指出其不可靠性。AI生成的文本會漏掉。更糟的是,未由AI生成的文本被錯誤標記為已被污染。

但圖書出版商將需要某種保障措施。看來,這些工具最多只能提醒你可能存在的問題,但你始終需要仔細檢查。因此,也許它可能會提醒你需要比其他文本更仔細檢查的文本?這是一種效率嗎?

真正的效率在於不再關注文本的起源,而是保持我們現有的質量標準。

失業

“你不會被AI取代。你會被懂得如何使用AI的人取代。” —匿名

AI採用可能會導致嚴重的失業。估計各不相同,但數字令人沮喪。有明顯的例子:舊金山的無人駕駛出租車消除了……出租車和共乘司機的需求。AI支援的診斷可能會減少對醫療技術人員的需求。

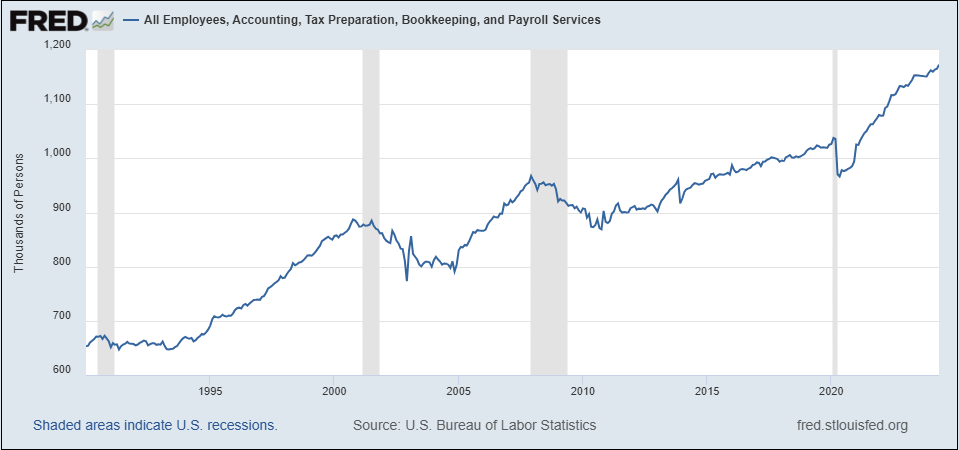

我的樂觀主義者指出了一個例子,即試算表的引入及其對就業的影響。如下面的圖表所示,從1990年以來,“會計、稅務準備、簿記和薪資服務”領域的就業幾乎翻了一番——這並不是對試算表和其他大部分自動化這些任務的技術的譴責。

Ethan Mollick與波士頓諮詢公司(BCG)的研究是一項旨在更好地了解AI對工作影響的實驗,特別是對複雜和知識密集型任務的影響。該研究涉及758名BCG顧問,隨機分配使用或不使用OpenAI的GPT-4進行兩項任務:創意產品創新和商業問題解決。該研究測量了參與者的表現、行為和態度,以及AI輸出的質量和特徵。

其中一項發現是“AI作為技能平衡器發揮作用。我們在實驗開始時評估得分最低的顧問在使用AI後,其表現提升了43%。頂尖顧問仍然有所提升,但提升的幅度較小。”完整文章揭示了更多內容,與所有Mollick的作品一樣,發人深省且易於理解。

教育

教育在AI的支持和反對辯論中一直處於前沿。AI進入教室的引入大多被視為詛咒,或至少是一個挑戰。其他教育者,如PW的主講人Ethan Mollick,則將AI作為教育者的一個非凡新工具;Mollick堅持他的學生使用ChatGPT。

關於這個話題最好的書是*Teaching with AI: A Practical Guide to a New Era of Human Learning*由José Antonio Bowen 和C. Edward Watson合著。

我不打算在這本書中深入探討教育出版——這是一個廣泛的話題,需要單獨報告。可以說,出版在教育中的重要性正在下降:AI工具是軟體,而非內容本身。

搜尋的未來

|

搜尋在AI中是一個充滿挑戰的話題。我鼓勵你訪問perplexity.ai和You.com,以瞭解未來的發展方向。下次當你考慮開始Google搜尋時,請改用Perplexity。它不會顯得大不相同——類似於Google經常在搜尋屏幕的右側或有時在搜尋結果列表頂部彈出的知識圖譜。不需要點擊鏈接,信息就直接呈現在你面前。 |

困惑度更進一步,重新措辭它從多個來源收集的信息,這樣你真的不需要點擊鏈接。它提供了來源的鏈接,但通常不需要點擊——你已經得到了你問題的答案。

這看似微小的變化對於每個公司和每個產品都有巨大的影響,這些公司和產品至少部分依賴於通過搜尋引擎被發現。如果搜索者不再被引導到你的网站,你如何吸引他們並將其轉化為客戶?簡單回答,你做不到。

Joanna Penn 在思考新技術對寫作和出版的影響方面處於前沿。她在去年12月的播客和博客中討論了這個複雜的話題。

對於AI和搜尋的轉變來說,這還是早期階段。

亞馬遜上的垃圾書籍

|

AI生成的垃圾書籍在亞馬遜上是一個問題,儘管其嚴重性可能更多是感覺上的而不是實質上的。一方面,這些書籍用低品質和抄襲的內容充斥著網上書店,有時甚至使用真實作者的名字來欺騙顧客,利用他們的名聲。這些書籍不僅對讀者來說是一個麻煩,也是對作者的一個威脅,有可能剝奪他們辛苦賺來的版稅。AI生成的書籍還會影響亞馬遜網站上真實書籍和作者的排名和可見度,因為它們在關鍵詞、類別和評論方面競爭。 |

亞馬遜現在要求作者披露他們在創作書籍過程中使用AI的詳情。毫無疑問,這可能會被濫用。

試著在亞馬遜上搜索“AI生成的書籍”。有很多結果。一些結果是關於如何使用AI創作書籍的書籍。但其他的,無所顧忌地,是AI生成的。《搞笑和可愛的貓圖片-你無法在世界上看到這樣的照片-第一部分》(原文) 被歸功於Rajasekar Kasi。在作者頁面上沒有他的(或她的?)生平詳情,但有六個其他標題被歸功於這個名字。該書於2023年8月26日出版,沒有評論也沒有銷售排名。這本電子書不合語法的標題與印刷書封面的不合語法標題不符。

但其他作者顯然在創作他們的書籍時廣泛使用AI,卻沒有披露。如上所述,檢測AI使用幾乎不可能,尤其是對於技術嫻熟的“造假者”。塗色書、日記、旅行書和食譜書正以極少的時間和精力通過AI工具生成,與傳統出版相比。

搜索“韓國素食食譜書”,你會發現第一名的標題是Joanne Lee Molinaro的書。但緊隨其後的是其他顯然是抄襲的標題。“《韓國素食食譜書:韓國美食愛好者的簡單和美味的傳統和現代食譜》”有兩條評論,其中一條指出“這不是一本素食食譜書。所有的食譜都有肉和蛋的成分。”但這本書的銷售排名是#5,869,771,而原版的排名是#2,852。

很難確定造成的損害程度。這不會有任何好處,但有多糟糕呢?

亞馬遜有政策允許它刪除任何未能“提供積極客戶體驗”的書籍。Kindle內容指導方針禁止“旨在誤導顧客或未能準確代表書籍內容的描述性內容。”他們還可以阻止“通常令顧客失望的內容。”是龐大的數量擊敗了亞馬遜的監視者?還是有其他原因?

偏見

LLMs是基於已經在線發布的內容進行培訓的。已經在線發布的內容充滿了偏見,因此LLMs反映了這些偏見。當然,不僅僅是偏見,還有仇恨,這些都反映在它的學習中,現在可能成為AI生成的文字和圖像中的潛在輸出。色情是AI在圖像方面驚人能力的另一個自然受益者,最近有令人不安的故事,講述年輕女性發現虛構的裸照,她們的男性同學可能是嫌疑人。《紐約時報》分別報導了網上兒童性虐待圖像增加的情況。

作者和出版商在使用AI工具時需要注意這些內在的限制。